Anthropicのコーディング・エージェント「Claude Code」のソースコードが流出するというインシデントが起こった。Claude CodeはAIエージェント技術で、企業秘密が世界に開示された形となった。流出したソースコードにはエージェントを構成する基軸技術が含まれており、Claude Codeの人気の秘密が詳らかになった。中国企業を含む競合企業は、この情報を参照し、エージェント機能を強化し、Anthropicをキャッチアップすることを目論む。

| 出典: Anthropic |

Claude Codeとは

「Claude Code」はコーディング・エージェントで、人間のエンジニアのように、自立してソフトウェア開発を実行する。Claude Codeは人間の指示に従って、長時間にわたりプログラミングを実行する。Claude Codeのブレインはフロンティアモデルで、ハイエンドモデル「Opus 4.6」を組み込んで利用する構成となる。

インシデントの概要

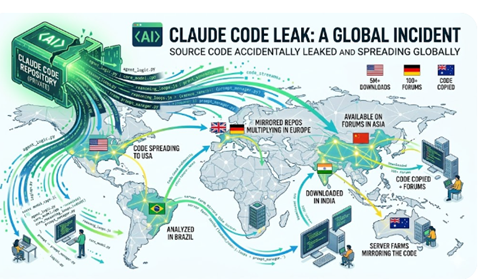

3月31日、コーディング・エージェント「Claude Code」のソースコードすべてが流出した。ソースコードが格納されているファイルを誤って、アップデートファイルとして一般に公開したことによる。これにより、1,906のファイルに格納されている512,000行のソースコードが流出した。セキュリティ研究者によりリークが指摘され、その後、流出したファイルがインターネットで拡散した。

Claude Codeの位置付け

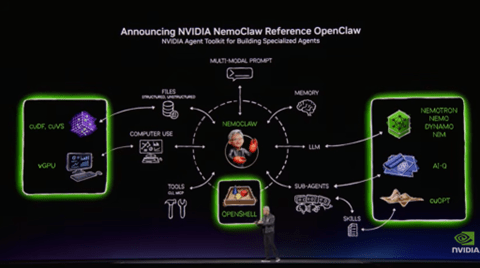

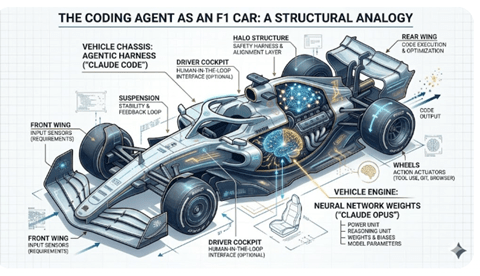

リークしたソースコードにはフロンティアモデル「Claude」の重みなどは含まれておらず、コーディング・エージェント「Claude Code」の部分に限定され、最悪の事態は避けられた。Claude CodeはAIエージェントのフレームワークで、ここにClaude OpusなどAIモデルを組み込んで使用する。クルマに例えると、Claude Codeはシャシの部分で、ここにClaude Opusなどのエンジンを搭載して使用する(下のイメージ)。流出したのはシャシの部分となる。

| 出典: Generated with Google Gemini Pro 3.1 Image |

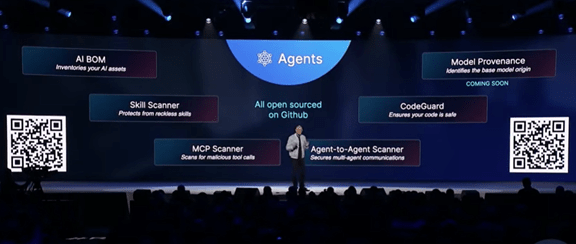

エージェントの構造が分かる

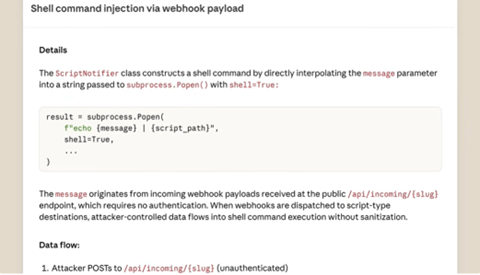

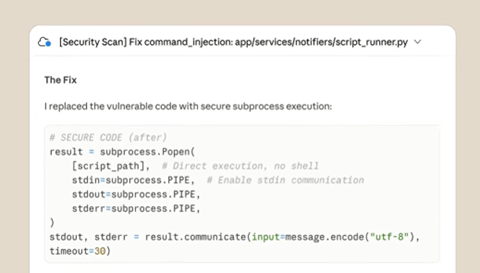

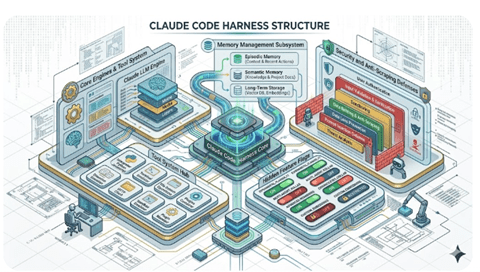

流出したソースコードにより、Claude Codeの構造が明らかになり、そこには数多くのイノベーションがあることが判明した(下のイメージ、Claude Codeの構造)。Claude Codeは核となる「コアシステム(Core System)」と「メモリ管理システム(Memory Subsystems)」で構成される。また、注目すべき点は、今までに公開されていない機能が搭載されていることだ。その代表は「KAIROS」で、システムの背後で常に動いており、エージェントを管理する。更に、「セキュリティ(Security &Defenses)」機能として、他社がClaude CodeにアクセスしてIPを盗用する「知識蒸留(Knowledge Distillation)」という攻撃をブロックする機構が搭載されている。

| 出典: Generated with Google Gemini Pro 3.1 Image |

コアシステム

Claude Codeのノウハウは「コアシステム」に実装されている。その中心は「Query Engine」と呼ばれ、エージェントを制御する司令官となる。Query Engineは、プロンプトから利用者の意図を把握し、コンテキスト・ウィンドウを管理し、タスクの流れを制御する。また、ツールを利用するためのモジュールとして「Tool System」が重要な役割を担う。Claude Codeは利用者のワークステーション(PCやMacなど)を操作する機能があり、ファイルにアクセスし、基本ソフトを操作する命令を実行する。このオペレーションを「Tool System」が管理し、安全に実行するための様々な工夫が実現されている。

今までに公開されていない機能

ソースコードのリークでClaude Codeは公開されていない機能を数多く搭載していることが判明した。その代表が「KAIROS」でバックグランド・エージェントとして機能する。KAIROSはClaude Codeの背後で常に稼働しており、運用をモニターし、必要に応じて利用者の指示なく自律的に問題を解決する。

オープンソースとなったわけでは無い

Claude Codeのソースコードが流出し、エンジニアや企業はこれを使うことができる状態となったが、法的に厳しい制約があるので注意を要す。Claude Codeのソースコードが流出したが、オープンソースとなったわけでは無い。Anthropicは流出したソースコードを利用することは許諾しておらず、個人や企業はこれを使うことはできない。ソースコードを改造したり、これを製品に組み込んで再配布することは違法行為となる。

GitHubへの要求

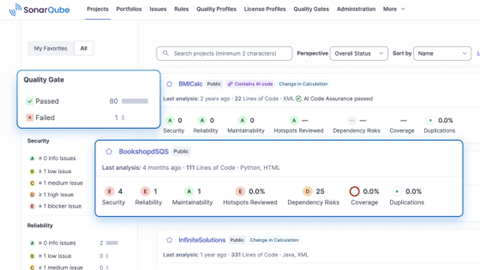

ソースコードが流出したと同時に、これらがGitHubなどのリポジトリに掲載され、自由にダウンロードできる状態となった(下のイメージ)。Anthropicは「デジタルミレニアム著作権法(Digital Millennium Copyright Act、DMCA)」を根拠に、GitHubなどのサービス・プロバイダに、これらミラーサイトやフォークサイトを閉鎖するよう求めた。ソースコードの知的財産権はAnthropicに帰属し、GitHubなどがこれらをサイトに掲載することは違法行為となる。

※今でもミラーサイトやフォークサイトにソースコードが掲載されている。これらをダウンロードするとここにウイルスなど危険なコードが含まれている可能性が高い。不審なサイトからClaude Codeのソースコードを入手するのは極めて危険!!

| 出典: Generated with Google Gemini Pro 3.1 Image |

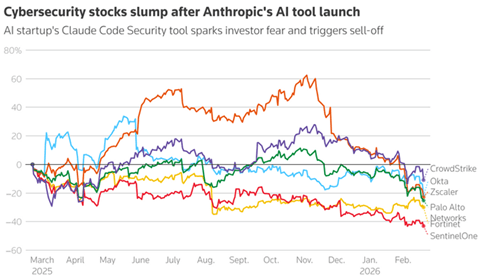

競合企業の製品開発

GitHubなど主要リポジトリでソースコードをダウンロードすることはできないが、企業や個人は既にソースコードを入手している可能性は高い。企業や個人はソースコードを改造して製品を開発することは違法行為であるが、ソースコードを解析しClaude Codeのイノベーションを理解することはその限りでない。競合企業はこれらの技法を参考に、これらを独自の手法で実装し、高機能なコーディング・エージェントを開発することができる。

中国企業がキャッチアップ

中国企業は一斉にClaude Codeのソースコードにアクセスし、Anthropicの最新技術を学習しているとされる。中国企業は知識蒸留などの手法で米国先進モデルのノウハウを吸収してきたが、ソースコードの流出で、知識を合法的に取得できる。特に、「KAIROS」など非公開の機能が明らかになり、これらがエージェント開発におけるヒントとなる。Claude Codeのソースコードの流出で米中間のAI技術格差が縮まることになる。