Baiduは2018年1月、CESで自動運転技術「Apollo」最新版を公開した。Apolloとはオープンソースの自動運転車開発基盤で、ソフトウェアやデータが公開され、メーカーはこれを使って自由に自動運転車を開発することができる。BaiduはApolloを自動運転車のAndroid位置づけ、中国企業を中心にエコシステムが広がり、Apolloを搭載した自動運転車が続々登場している。

| 出典: Baidu |

ライブデモを実施

BaiduはCES会場で、ラスベガスと中国・北京を結び、Apolloを搭載した自動運転車のデモ走行を披露した。この模様はビデオで公開された。デモ会場は北京にあるBaidu本社で、夜明け前の暗闇の中を自動運転車が隊列走行した (上の写真)。Apolloは異なる車種のクルマに搭載され、構内を自動運転で走行した。先頭のクルマはFord製の高級車種Lincoln MKZで、Apollo自動運転技術を搭載し、運転席にはドライバーの姿はなく、クルマが自動で走行した。

AI Cityを開発

Baiduは同時に、「AI City」を走行する自動運転車のデモビデオを公開した。Baiduは地方政府と共同でXiongan (河北省・雄安) に人工知能都市AI Cityを開発している。市の一部を特区 (New Area) として、次世代スマートシティーのプロトタイプを構築する。具体的には、この街をAIを活用した商業地域とし、自動運転技術 (Intelligent Transportation)、対話型AI (Conversational AI)、クラウド (Cloud Computing) を導入し、インテリジェントな近未来都市を構築する。

AI Cityで自動運転走行デモ

BaiduはAI CityでApolloを搭載した自動運転車のデモ走行を実施した。Apolloを搭載した異なるモデルの車両が市内の公道を走行した。クルマは対面通行の道路などを安全に自動走行した (下の写真)。ここは中央分離帯が無く、道幅は狭く、高度な技術が必要となる。Baiduは中国におけるGoogleとして認識されているだけでなく、今では自動運転のリーダーとして技術開発を主導する。BaiduがAI Cityで自動運転のデモを実施した最初の企業で、その実力の高さを内外に示した形となった。

| 出典: Baidu |

交差点の左折や問題への対応

クルマは信号機のある複雑な交差点を左折できることも示された。クルマのセンサーは信号機や歩行者を正しく認識し、安全な走行経路を決定する。また、交差点でUターンをすることもできる。更に、対向車がセンターラインを越えて車線に入ってきても、これを認識して安全に停止した (下の写真)。

| 出典: Baidu |

ディスプレイ

自動運転車のダッシュボードにはディスプレイが搭載され運行状態を表示する (下の写真)。自動運転機能を可視化してディスプレイに表示することで、アルゴリズムが何を見て、どのように判断したかが分かる。具体的には、 Apollo API (自動運転ライブラリ) の「Perception」という機能は、クルマ周囲のオブジェクトを把握し、その種別を特定する (下の写真、緑色の箱)。また、「Planning」という機能は、把握したオブジェクトを考慮して、安全な走行ルートを算定する (下の写真、クルマの前に示された水色の線)。アルゴリズムの演算結果をディスプレイに表示することでクルマの挙動を理解できる。更に、クルマの走行データを記録する機能もあり、アルゴリズムのデバッグなどに役立てる。

| 出典: Baidu |

ハードウェア

Apolloはソフトウェアとハードウェアから構成され、通常のクルマにこれらを搭載して自動運転車とする。センサーはLidar (レーザーセンサー)、カメラ、レーダーが使われ、これら機器を車両に搭載する (下の写真)。これが標準装備で、三種類のセンサーをAIが解析し (Sensor Fusionと呼ばれる)、自動運転を実現する。運転席には自動運転を解除するための非常ボタンが設置されている。Apollo自動運転車は北京の公道で試験走行を進めている。また、Baidu研究所があるカリフォルニア州でも走行試験が実施されている。

| 出典: Baidu |

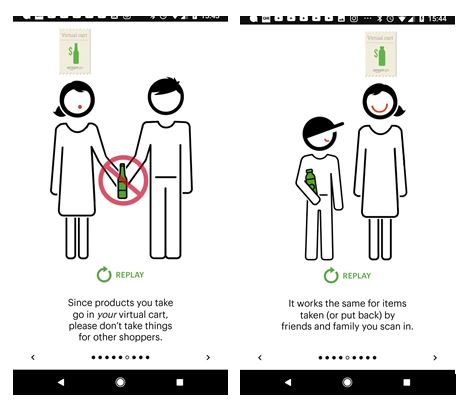

オープンソースの手法

Baiduは自社単独で自動運転技術を開発するのではなく、オープンソースの手法で技術を公開し、パートナー企業と供に製品を開発している。既に多くの企業がApolloプロジェクトに参加している。その数は90社にのぼり、中国企業が65社と大半を占めている。海外メーカーではFordやDaimlerやHyundaiが加わっている。海外サプライヤーではBosch、Continental、Delphiなどが、半導体メーカーではNvidia、Intel、NXPなどが参加している。日本からはルネサスエレクトロニクスとパイオニアが参加している。中国企業が中心であるものの、海外から大手企業が参加しており、その関心の高さが窺える。

Microsoftが参加

IT企業からはMicrosoftがパートナーに加わっている。MicrosoftはクラウドサービスAzureを提供し、自動運転車のシミュレータ「Dreamview」(下の写真) の運用を支える。自動運転車が商品として販売され、市街地で運行を始めると、Microsoftはクルマとクラウドを結ぶコネクティッドカー機能を提供することを計画。現在、Apolloは中国で展開されているが、Microsoftがプロジェクトを米国や欧州で展開することを手助けする計画もある。

| 出典: Baidu |

オープンソースの手法は上手くいくのか

Apolloソフトウェアはオープンソースの手法で開発されている。開発されたソフトウェアはGitHubに公開され、誰でも自由に利用して自動運転車を開発できる。同時に、参加企業は自社で開発したソフトウェアをApolloにフィードバックすることもできる。このプロセスを繰り返すことでApolloの完成度が向上するというシナリオを描いている。

Apolloの機能は未成熟

Apolloの機能はまだ限定的で、複雑な市街地を走行できる訳ではない。Apolloが提供している機能は、幹線道路での直進、左折・右折、Uターンなど基本操作に限られる。Apolloの機能はまだまだ未完成で、今すぐに無人タクシーとして使える訳ではない。つまり、Waymoなど先行企業はApolloに加わるインセンティブはない。

| 出典: Baidu |

自動運転技術はコモディティに向かう

しかし、新興企業にとってみると、Apolloに参加することで、短期間で自動運転車を商品化でき、新事業創設のチャンスが広がる。Fordなど大手メーカーは自社開発だけでなく、Apolloで逆転を狙うという目論みがあるのかもしれない。更に、自動運転技術は基本ソフトのように基礎技術となり、共通に利用できる方向に進むということを示唆している。誰でも手軽に自動運転車を開発できれば、差別化の要因をどこに求めるのか、新しい課題も見えてくる。

Androidモデルを踏襲

参加企業の多くは中国の自動車メーカーであり、Apolloを搭載した自動運転車が続々と開発されている (上の写真)。自動車だけでなく、Apolloを搭載したバスや道路掃除車両や配送ロボットなどが登場している。この状態はGoogleがスマホ基本ソフトAndroidを買収した2005年頃に似ている。当時、Apple iOSに比べAndroidは未成熟な基本ソフトであったが、Googleがオープンソースの手法で開発し、Androidは急速に完成度を増した。Androidが世界を席巻したように、Apolloもこの流れに乗ることができるのか、世界から注目を集めている。