Appleは2018年9月12日、特別イベント「Apple Special Event」で、iPhone XとApple Watchの新製品を発表した。第四世代となる「Apple Watch Series 4」は、ハードウェア機構が一新され、健康管理に重点を置くウエアラブルとなった。Apple Watch Series 4はECG (Electrocardiography、心電図) を計測するセンサーを搭載し、心臓の健康状態をモニターする。

| 出典: Apple |

ECGとは

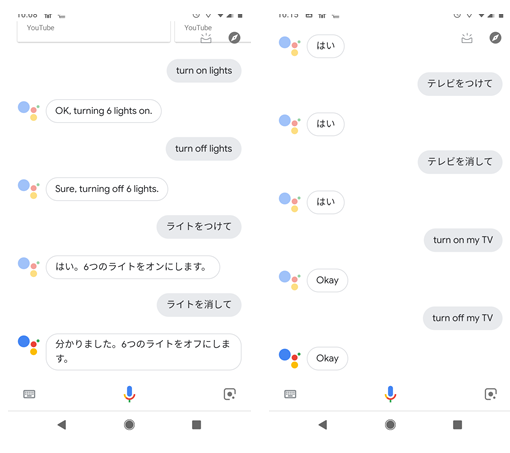

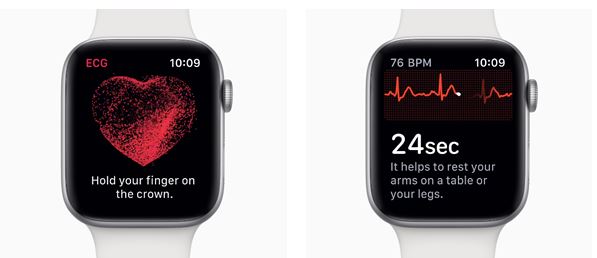

ECGとは心臓の鼓動を電気シグナルとして測定するもので、病院で心臓疾患を検査するために使われる。この機能がApple Watch Series 4に搭載され、家庭で心臓疾患を検知できるようになった。使い方はシンプルで、指をクラウン(Digital Crown)にあてると(下の写真)、アプリ「ECG」が起動し(上の写真、左側)、30秒で心電図を測定する(上の写真、右側)。測定結果は問題が無ければ「Sinus Rhythm」と表示される。もし、心房細動(不整脈の一種)が検知されると「Atrial Fibrillation」と示される。

| 出典: Apple |

Apple Healthに記録される

測定結果はAppleの健康管理アプリ「Health」に格納される(下の写真)。検査結果の判定(Classifications)だけでなく、心電図の波形(Waveform)も記録される。更に、利用者はその時の症状を入力することができる。万が一、異常が検知されると、医師に相談することになるが、その際に、Healthに格納しているECG検査結果を示し、治療判断に役立てる。

| 出典: Apple |

ECG計測のメカニズム

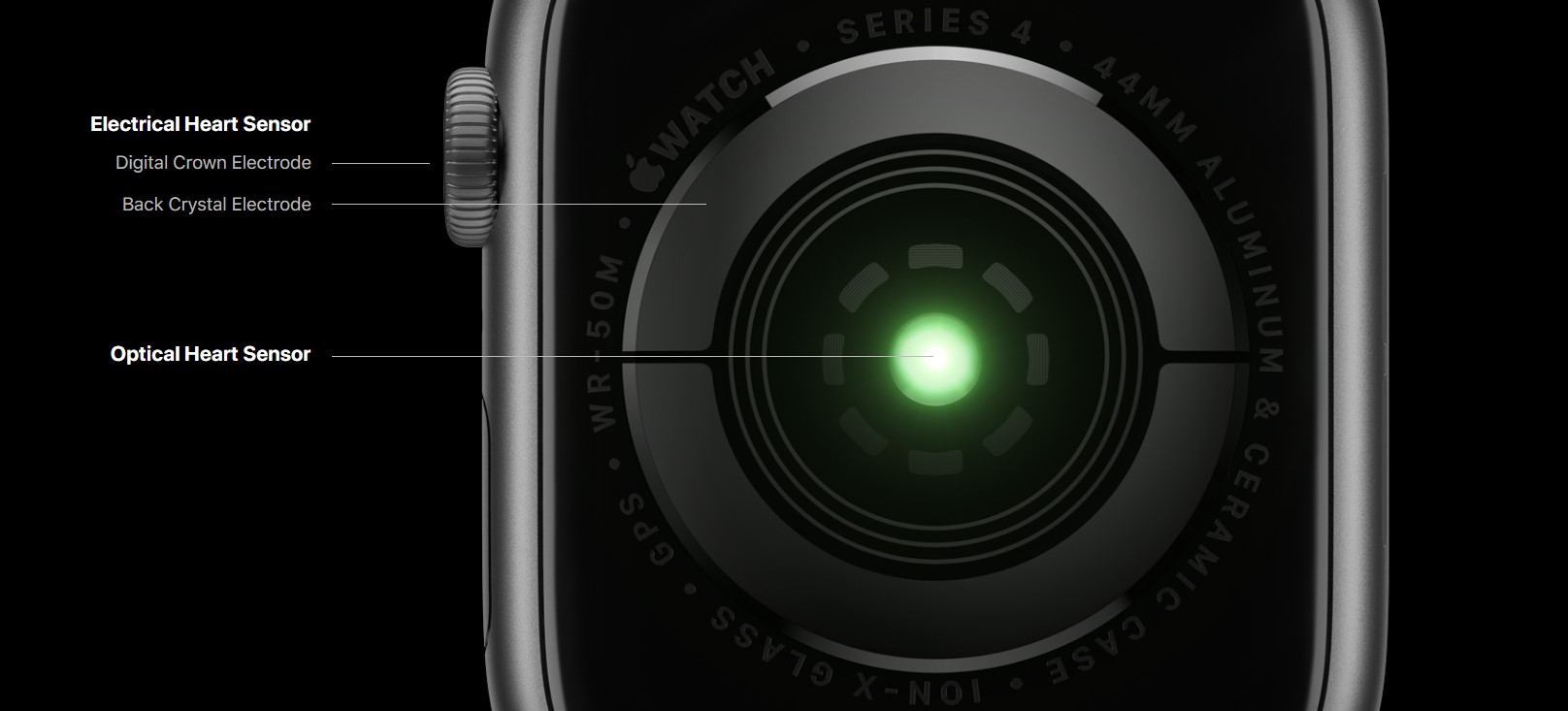

Apple Watch Series 4はECGを測定するために新しいハードウェア機構を搭載した。二つのモジュールから成り、ウォッチ背後に円形電極が付加され(下の写真、外側の円)、更に、クラウンがもう一つの電極として機能する(下の写真、左側の突起)。円形電極が皮膚に触れ、指をクラウンにあてることで、心臓を含む電気回路が作られる。この回路で心臓の鼓動の電気シグナルを計測する仕組みとなる。既にFDA(アメリカ食品医薬品局)の認可を受けており、Apple Watch Series 4を医療機器として使うことができる。

| 出典: Apple |

心拍数の計測と心臓疾患検知

Apple Watchは発売当初から心拍数を測定する機能を提供しているが(下の写真、左側)、Series 4ではセンサーが一新され(上の写真、中央部緑色の部分)、新たな機能が加わった。Apple Watch Series 4は心拍数が異常に高い時、また低い時に、警告メッセージを表示する(下の写真、右側)。更に、上記ECGに加え、心拍数から心房細動を検知するアルゴリズムが搭載され、バックグランドで心臓の健康状態をモニターする。(詳細な説明はないが、心拍シグナルをニューラルネットワークで解析し、心房細動を検知すると思われる。ECGに比べ判定精度は低いが、Apple Watch Series 4を着装している時は、連続して心臓の状態をモニターできる。) センサーは緑色のLEDライトを皮膚に照射し、血管の伸縮や容積の変化を測定する。このデータを解析することで心拍数を把握する。エクササイズ時には心拍数から消費カロリー量を算定する。

| 出典: Apple |

転倒検知機能

Apple Watch Series 4に利用者が転倒したことを検知する機能が付加された。転倒を検知するとディスプレイに緊急SOS(Emergency SOS)画面が表示され(下の写真、左側)、ボタンをスワイプすると電話が発信される(下の写真、右側)。転倒を検知して60秒間アクションが無い時は、利用者が危機的な状態にあると判断し、アプリが自動で電話を発信する。SOS電話の相手として、両親や配偶者などを事前に登録しておく。スノーボードで激しく転倒したときに、救助を求めるために使われる。また、一人暮らしの高齢者が転倒した時に、助けを求める機能としても使えそうだ。

| 出典: Apple |

AliveCor

Apple Watch Series 4がECGを搭載したが、市場には既に多くの製品が販売されている。AliveCorというベンチャー企業は「Kardia Band」というECGモジュールを開発した。これをApple Watchに着装すると(下の写真、バンドの四角のデバイス)ECGを測定できる。このデバイスに指をあててECGを測定し、結果はApple Watchのディスプレイに表示される。Kardia BandがApple WatchでECGを測定できる最初のデバイスとなり、既にFDAの認可を取得し、医療機器として使われている。

| 出典: AliveCor |

Cardiogram

Cardiogramというベンチャー企業は、Apple Watchで心臓疾患を検知するAIを開発した。カリフォルニア大学サンフランシスコ校との共同研究の成果で、Apple Watchで収集した心拍データをAIで解析し、不整脈の一種である心房細動を検知する。Apple Watch Series 4もこれと同じ方式で、心拍シグナルをAIで解析し、心房細動を検知するものと思われる。

健康管理プラットフォーム

Apple Watch Series 4に先立ち、ベンチャー企業で心臓疾患を検知する高度な技術が開発された。Appleはこれら先進技法を取り込み、消費者に使いやすいデザインで提供していることに特徴がある。更に、管理アプリHealthで健康管理をプラットフォームとして設計しており、病院など他のシステムとの連携が期待される。

Apple Watchは医療機器に Apple Watchは、コミュニケーション(通信機能)、エクササイズ(運動量把握)、ヘルスケア(健康管理)の三つの基軸機能を持っている。Apple Watch Series 4でECG機能が搭載され、ヘルスケア機能が大幅にに向上した。Apple Watchはバイオセンサーとして、身体情報をモニターする医療機器としての役割が鮮明になった。Apple Watchは血圧や血糖値を測定する機構を搭載するとのうわさが絶えず、次は何が登場するのか、スマートウォッチが大きく進化している。