中国政府はAI First Countryの政策を掲げ、2030年までにAIで世界をリードするロードマップを公表している。いま、監視カメラにAIを適用し、市民の行動を監視するプラットフォームの開発を進めている。このプロジェクトは「Sharp Eyes」と呼ばれ、国内に設置されている2000万台の監視カメラの映像を集約し、これをAIで解析する。一般市民が対象となり、プライバシー問題が懸念されている。同時に、膨大な量の教育データが集まり、中国が顔認識技術で世界をリードする。

| 出典: SenseTime |

Sharp Eyesとは

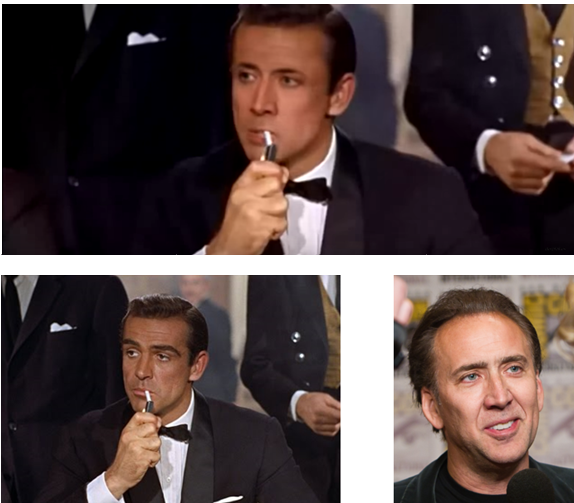

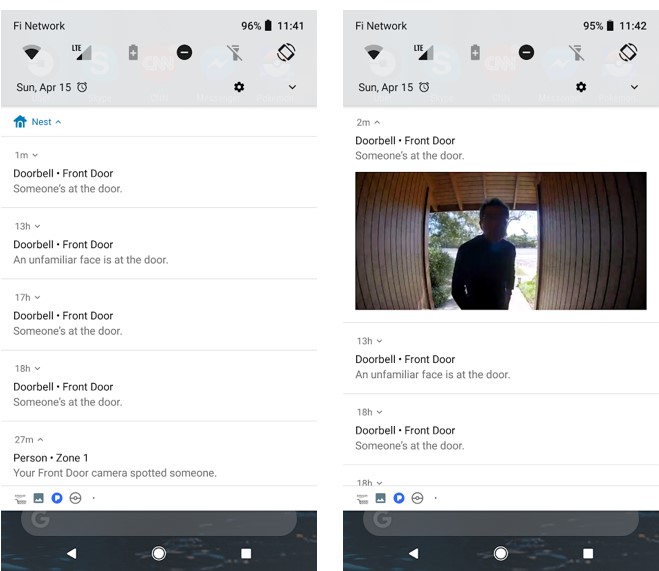

Sharp Eyesは国全体の監視システムで、政府の監視カメラと民間の監視カメラを使い、撮影される映像を統合しAIで解析する。政府の監視カメラは、道路、ショッピングモール、駅、空港などに設置されている (上の写真、人の動きを追跡する事例)。民間の監視カメラは、アパートやオフィスビルなどに設置されているが、この映像も監視プラットフォームに統合される。

治安維持と市民監視

集約した大量のビデオ映像をAIや顔認識技術で解析し、多くの情報を抽出する。例えば、容疑者を追跡し、不審な挙動を見つけ出すなど、治安維持に活用される。犯罪者だけでなく、一般市民も対象となる。個人の行動を把握し、誰と接触したかを勘案し、個人の信用度 (Credit Score) を算出する。個人の信用度とは、中国政府や関係機関が特定個人を信用できるかどうかの指標で、スコアが低いと、旅行のためのチケットを購入できないなど、日常生活の行動が制限される。

AIベンチャー企業

Sharp Eyesのシステムを支えているのが中国のAIベンチャー企業である。SenseTimeは北京に拠点を置き、Deep Learningの手法で顔認識やオブジェクト認識技術を開発している。SenseTimeはAlibabaなどから累計で10億ドルの出資を受け、企業価値は30億ドルと言われ、世界最大規模のベンチャー企業となっている。

世界トップの顔認識技術

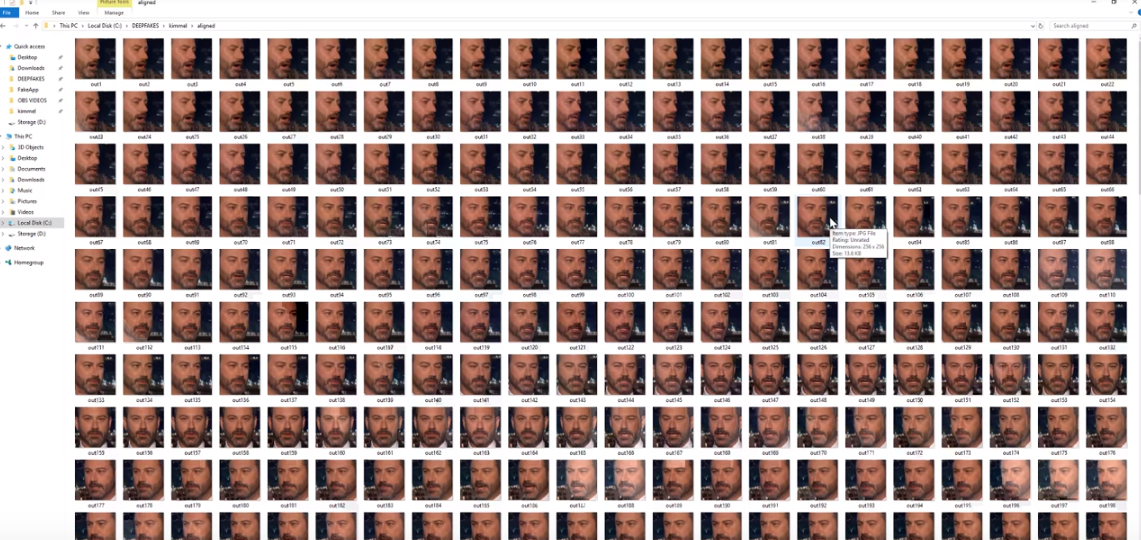

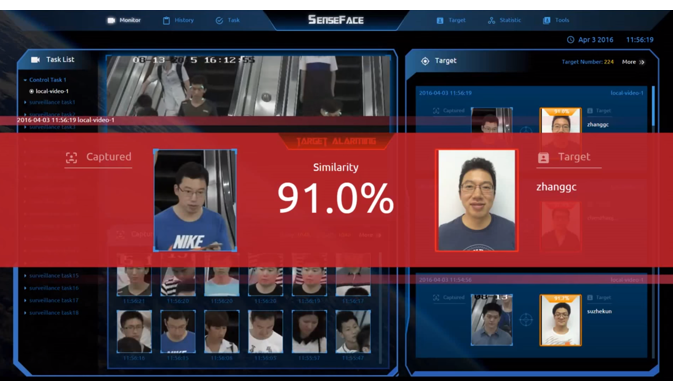

SenseTimeの顔認識技術は世界最高レベルと評価されている。この技術は「SenseFace」と呼ばれ、監視カメラの映像をDeep Learningの手法で解析する。SenseFaceはビデオに写っている数多くの人物の中から犯罪者を特定する機能を持っている。人通りの多い市街地や空港や駅などに設置された監視カメラの映像を読み込み、写っている顔を犯罪者データベースと照合し、容疑者を特定する。

犯罪者を特定する

例えば、SenseFaceはエスカレーターに乗っている人物の顔を把握し、それらを犯罪者データベースに登録されている顔と比較する (下の写真)。ある人物 (中央側) が、データベースに登録されている人物 (中央右側) と同一人物である可能性が91.0%などと判定する。この情報は近辺の警察官に送信され、容疑者のもとに駆け付ける手順となる。これはコンセプトデモであるが、実際にシステムを構築する際は、映像をクラウドに送信し判定結果を受け取るまでの遅延時間を如何に短縮するかがカギになる。SenseFaceは同時に1000台の監視カメラの映像を解析する能力があるとしている。

| 出典: SenseTime |

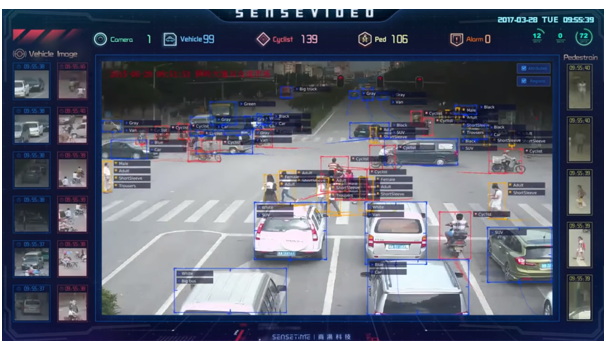

歩行者やクルマの流れを監視

交差点では歩行者やクルマの流れを監視する。この技術は「SenseVideo」と呼ばれ、Deep Learningを使ったビデオ解析システムで、映像の中の歩行者、自動車、その他の乗り物を検知し、その属性を判定する。込み合う交差点に設置されたカメラの映像を解析し、オブジェクトを特定し、その属性を判定する (下の写真)。人物では性別、年齢、服装など、10項目にわたり判定する。クルマではナンバープレート、車種、色などを判定する。SenseVideoは検索機能もあり、犯罪が発生すると録画ビデオで不審者を探し出す。

| 出典: SenseTime |

SenseTimeの実力

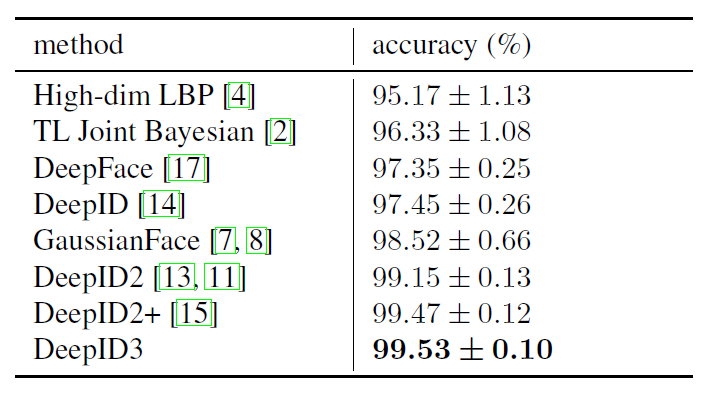

SenseTimeが開発している顔認識技術は世界のトップレベルである。顔を認識するAI技法は数多く開発されているが、SenseTimeの最新技法は「DeepID3」と呼ばれ、Chinese University of Hong Kong (香港中文大学) などと共同で開発した。基礎技術は論文「DeepID3: Face Recognition with Very Deep Neural Networks」で公開されている。

DeepID3とは

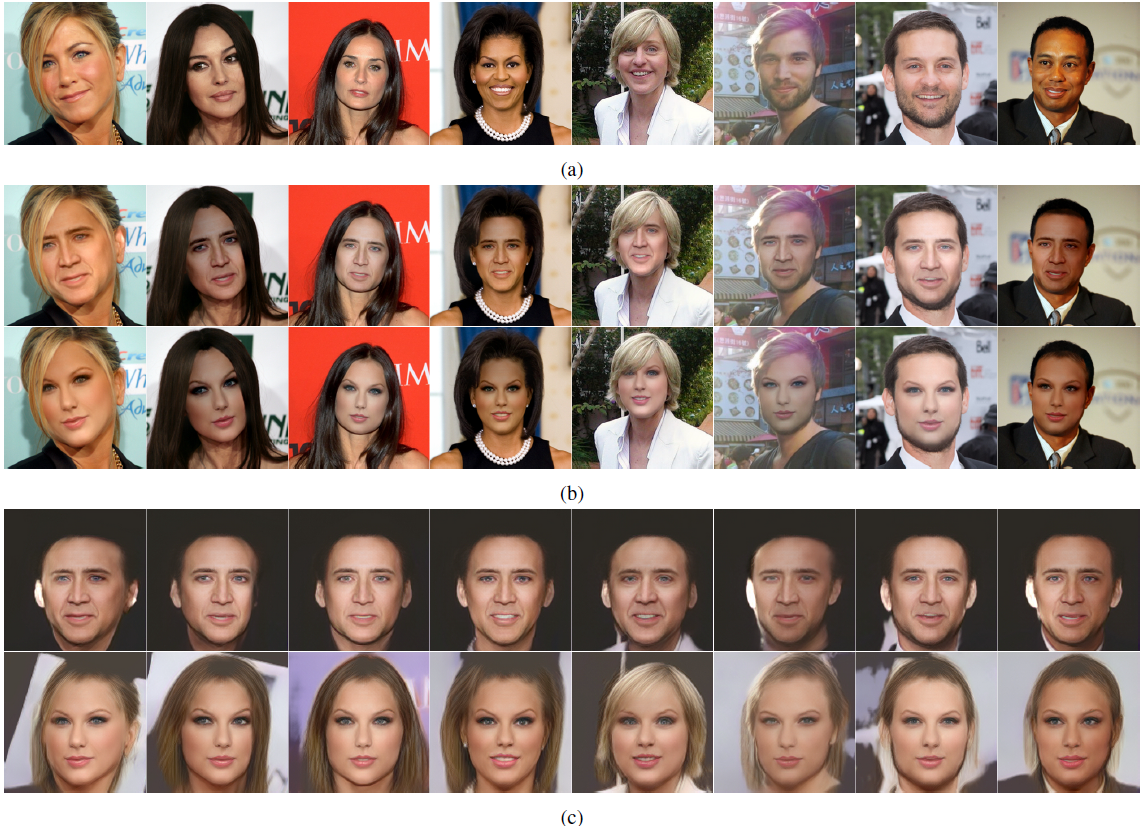

DeepID3は最新のConvolutional Neural Networksを実装したシステムで、顔から数多くの特徴量を抽出し、顔認識プロセスを実行する。DeepID3は、顔認証 (Verification、1:1比較、二つの顔が同じかどうかの判定) と顔認識 (Identification、1:N比較、データベースで同一の顔を探す処理) を一つのアルゴリズムで実現している。DeepID3の顔認証精度は99.53%で (下の写真)、人間の能力 (97.53%) を大きく上回る。

| 出典: Yi Sun et al. |

中国政府の戦略

中国政府はSharp Eyesを治安維持のために使うが、犯罪者だけでなく一般市民の行動も監視される。国民のプライバシー侵害が懸念されるが、中国では大きな反対運動は起こっていない。このため、膨大な数の顔写真データが蓄積され、AIのアルゴリズム教育に大きく寄与している。中国政府はSharp Eyesのもう一つの目的を、AIを使ったコンピュータビジョン技術の育成に置いている。監視カメラの映像を解析するAIの技術開発を支援し、世界トップを目指している。