ドライバーが搭乗しないレーシングカーによるレースが始まった。これは「Roborace」と呼ばれ、AIレーシングカーがFormula Oneのようなバトルを展開する。レーシングカーにはコックピットはなく、Deep Learningが操縦する完全自動運転車だ。アルゴリズムがLewis Hamiltonを超えるのかファンの注目を集めている。

Roboraceとは

RoboraceはEVのF1といわれる「Formula E」シリーズの一部として位置づけられる。Roboraceは10チームで構成され、各チームは二台の無人レーシングカー (上の写真) で勝負する。レーシングカーの車体は同じものが使われるが、各チームは独自にソフトウェアを開発し、レーシングカー制御と自動運転技術の戦いとなる。

EVと自動運転技術の交差点

高速で走行するレーシングカーからリアルタイムで大量のデータが収集される。これを如何に高速で処理できるかがポイントになる。これらのデータを解析し自動運転するAI技術が競われる。クルマの将来はEVと自動運転技術で、Roboraceの意義はこの構想をレースの形で世界に示すことにある。Roboraceは再生可能エネルギー技術と自動運転技術を結び付け、未来のモビリティを示している。

未来的なデザイン

Roboraceで使うレーシングカーはKinetikが開発し供給する。Kinetikとは英国のベンチャーキャピタルで、配下のRoborace社が車体の設計と製造を担う。レーシングカーのデザインはDaniel Simonが手掛けた。同氏はディズニー映画「Tron Legacy」で登場する二輪車「Light Cycle」をデザインした。RobocarはLight Cycleをほうふつさせる未来的な形状と色彩となっている。

レーシングカーの形状はシンプル

レーシングカーは無人で走行することを前提にゼロから設計された。ドライバーが搭乗しないのでコックピットはなくシンプルな形状となっている。機能面からは床面の形状でダウンフォースを得る。レーシングカー底部を高速で流れる空気を利用して車体を路面に押し付ける。このダウンフォースを利用して高速でコーナーを回ることができる。ちなみにF1ではダウンフォースを得るためにFront WingとRear Wingを車体に付けている。

多数のセンサーを搭載

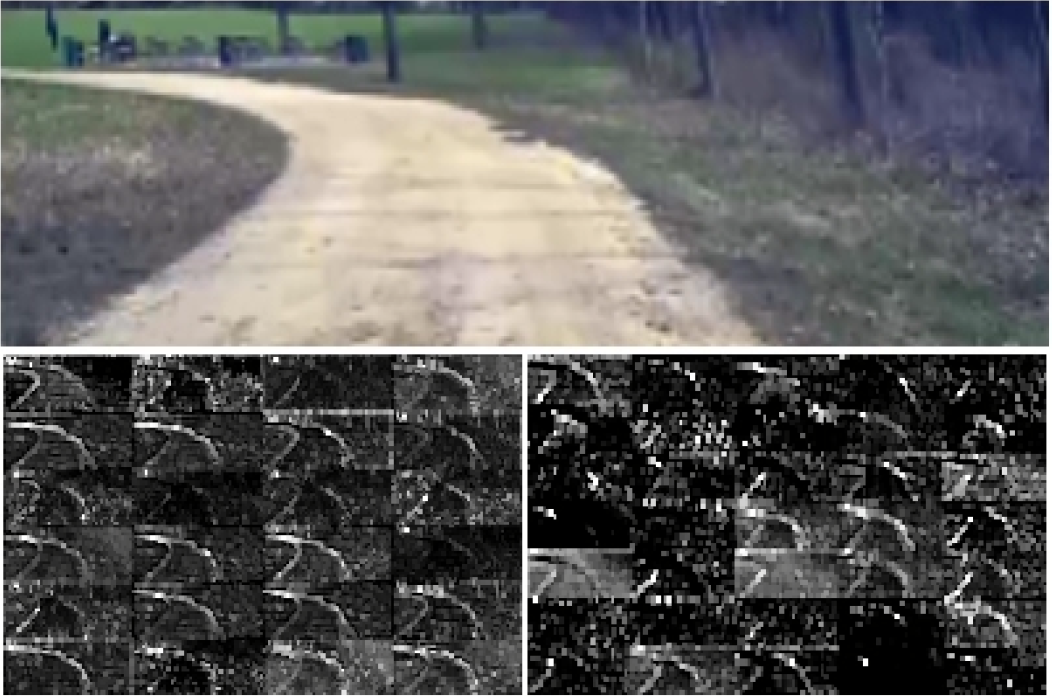

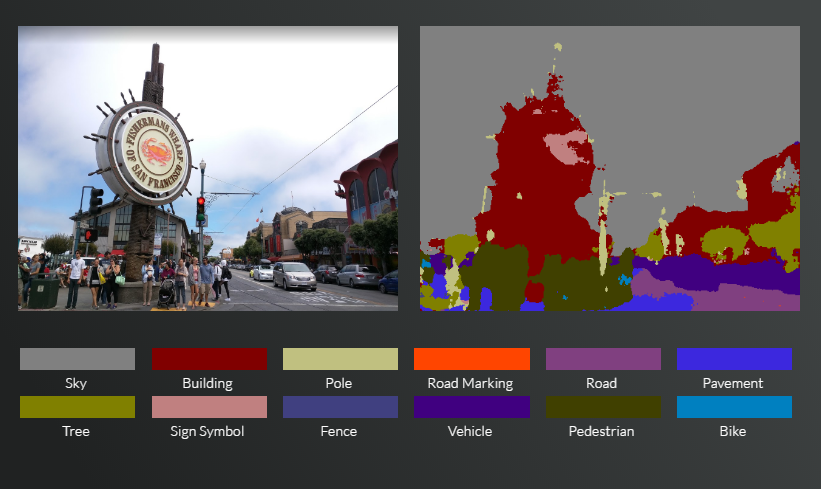

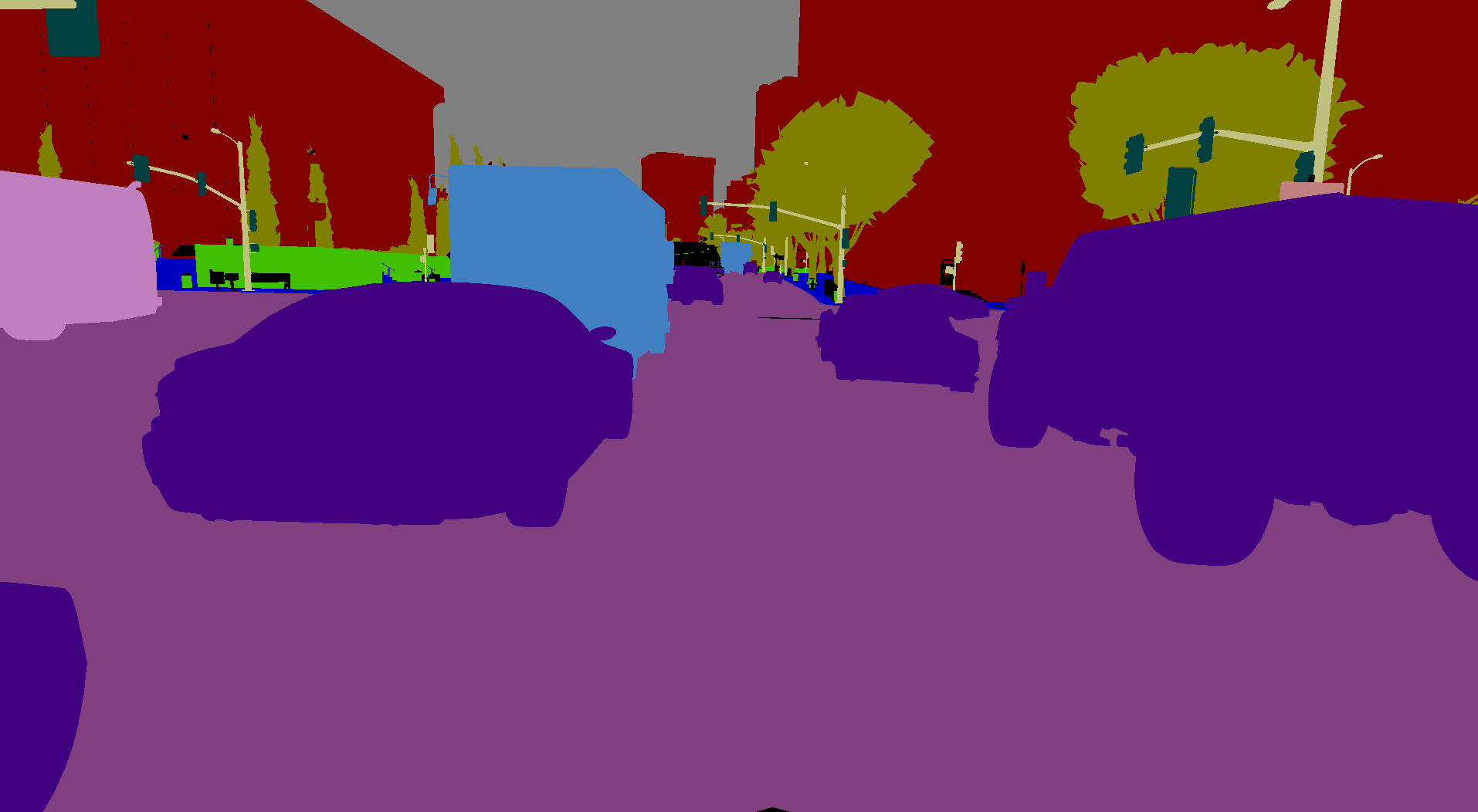

レーシングカーは自動運転のための様々なセンサーを搭載している。Lidar (レーザーレーダー) を5台搭載している。前面に二台、側面に二台、後部に一台搭載し、周囲のオブジェクトを把握する。AIカメラは前面に二台とPole (車体上部に設置されたポール) に一台設置される。名前が示すように、AIと連動しインテリジェントなセンサーとなる。この他に、レーダー、超音波センサー、GPSアンテナを搭載する。

Deep Learningを使った運転技術

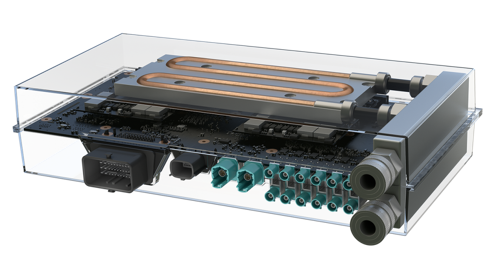

レーシングカーは処理装置としてNvidiaの車載スーパーコンピューター「Drive PX 2」を搭載している。Drive PX 2はセンサーからのデータを処理し周囲のオブジェクトを把握する。更に、Deep Learningの技法でクルマが運転技術を学ぶ。試合を重ねるにつれレーステクニックを習得し人間のドライバーに近づいていく。将来はF1ドライバーを凌駕するのではとの声も聞かれる。

香港グランプリでデビュー

Roboraceは2015年11月に計画が発表され、今シリーズからレースを始めるとしていた。実際には、10月に開催された香港グランプリでRoboraceの試験車両「DevBot」が公開された (上の写真)。試験車両はドライバーが搭乗できるコックピットが備え付けられているが自動で走行する。グランプリではそれをデモする予定であったが、バッテリーの問題で残念ながら中止となった。Roboraceは2016年をシーズンゼロと位置づけDevBotの開発を続け、来年度からRoboraceでレースが始まる。

Formula Eとは

Roboraceが属するFormula Eとは2014年に創設されたモータースポーツイベントで、バッテリーで駆動するレーシングカーが速さを競い合う。Formula EはFIA (国際自動車連盟) が管轄する。FIAはFormula OneやWorld Rallyなど世界のトップレースを運営している。3シーズン目となる2016年はスポーツファンの数が増え人気が急上昇している。

中国を舞台にシーズンがスタート

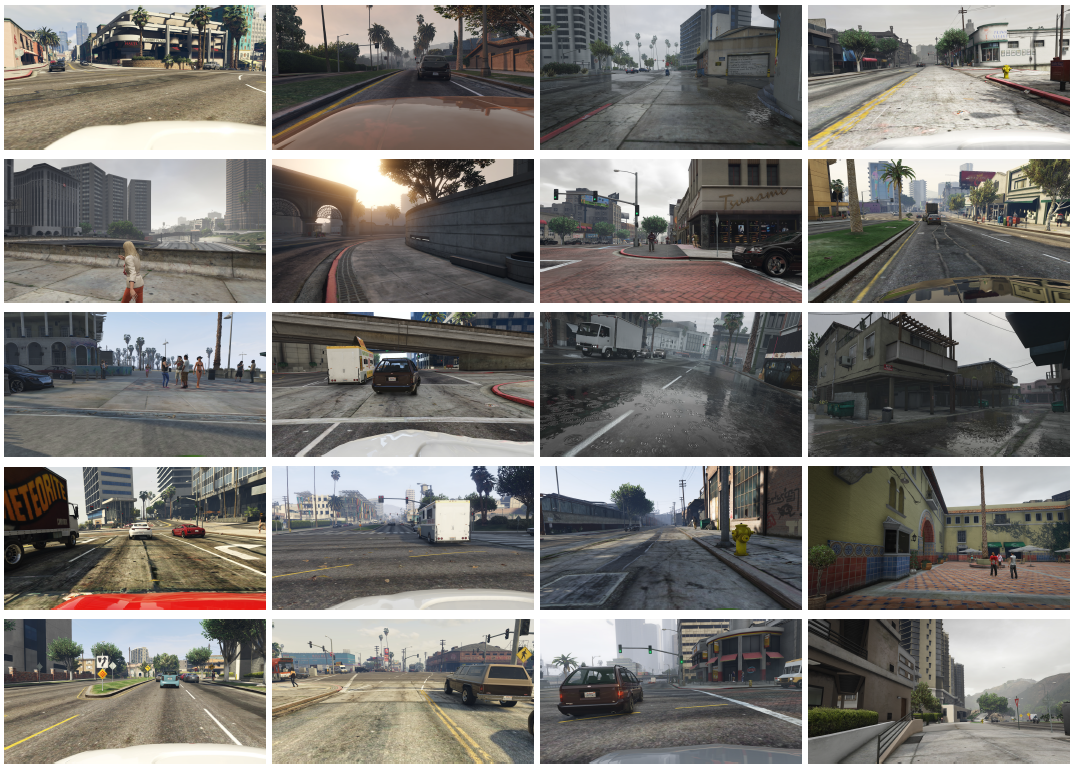

今シーズンのFormula Eは香港グランプリから始まり、2017年7月まで世界10都市で12レースを開催する。香港グランプリは市街地にレースコースが設定され10チーム20台が競った (下の写真)。レースは事故が続発する波乱の展開となり、昨年度のチャンピオンe.Dams (RenaultのFormula Eチーム) のSébastien Buemiが優勝した。昨年までは北京で開催され、毎年中国を舞台にシーズンがスタートする。

F1に性能では劣るが

Formula Eは外観はF1に似ているが電気モーターで駆動するレーシングカー。レース時間は50分で一人が二台のマシンを使って競技する。F1は燃料が少なくなるとピットインして給油するが、Formula Eは電気残量が少なくなるともう一台のマシンに乗り換えてレースを続ける。Formula Eの最高速度は時速220キロであるがF1は時速340キロと大きく上回る。最高速度や加速性能でF1が上回るが、Formula EはEV技術が高速に進化し、その将来性に期待が集まっている。

レースはバッテリーの勝負

EV技術の中心がバッテリー開発となる。Formula Eのバッテリー重量は200kgで、バスの電圧は1000Vに制限されている。更に、モーター出力は200 kW (270馬力) だが、レース中は170 kWに制限されている。バッテリーからの電力使用量は28kWhに制限される。レースはエネルギー管理の戦いでもあり、多くの制限のもとで最新技術が磨かれる。

ファン投票でエネルギーを得る

レースは速さを競うだけでなく、楽しく観戦できる仕組みが随所にみられる。ファンは応援しているドライバーに投票しマシンの出力を上げることができる。これは「FanBoost」と呼ばれ、投票数の多いドライバーは100キロジュール (100kW x 秒) を受ける。5秒間で20kWの追加エネルギーを得ることができ12%の出力アップとなる。これでライバルを追い抜くシーンが見られ、ファンはレースに参戦した気分になる。

中国企業がFormula Eに参戦

Formula Eの特徴は多くの中国企業がレースに参戦している点だ。「NextEV」は中国企業が運営するレーシングチームでFormula E創設以来参戦している。昨年度は9位の成績で不調に終わったが、今年は巻き返しを狙っている。3シーズン目にあたる今年は「Techeetah」というチームが参戦した。このチームは日本のFormula Eチーム「Team Aguri」を買収してレースに加わった。

Faraday Futureも参戦

今シーズンは「Faraday Future」がスポンサーとしてFormula Eに参戦した (下の写真)。Faraday FutureとはLos Angelesに拠点を置くEVメーカーでTeslaに対抗するEVや自動運転技術を開発している。Faraday Futureは米国籍の企業であるが、中国大手IT企業「LeEco」が出資している。Faraday Futureは米国の名門レーシングチーム「Dragon Racing」のスポンサーとなる。資金を出すだけではなくパワートレイン制御のソフトウェアを提供する。Faraday FutureがFormula Eに参戦したことで中国系企業は3社となり、EVや自動運転技術にかける中国企業の意気込みが感じられる。

Mercedes-BenzがFormula Eに参戦

Mercedes-Benzは2018年シーズンからFormula Eに参戦することを発表した。5シーズン目にあたるこの年から2チーム増え12チームでレースが展開される。このシーズンから1台のレーシングカーで最初から最後まで走り切るだけのバッテリーを搭載する。Renault、Audi、Jaguar (下の写真)、BMWなどがすでに参戦しており、Mercedesの発表でFormula Eへの流れが鮮明になった。

EVへの流れが鮮明になる

MercedesはF1でエースドライバーLewis Hamiltonを抱え、昨シーズンは総合優勝を飾り、今年もチームが連勝する勢いである。F1で破竹の勢いのMercedesが敢てFormula Eに参戦することで、EVレースが一挙に注目を集めることとなった。自動車産業の流れがEVに向かっていることを象徴する出来事となり、NissanやPorscheがこれに続くと噂されている。

F1人気が低迷している

いまF1の人気が低迷している。F1は機能が成熟し大きな技術進化が期待できないという事情がある。そのため多くの自動車メーカーはここへの投資をためらっている。技術進化が停滞しているF1からスポンサーが離れている。かつてはクルマの新技術がF1レースで開発されたが、F1はその役割を終えようとしている。

Formula EでEV技術や自動運転技術が磨かれる

これに対しFormula Eは次世代技術開発のプラットフォームとして位置づけられ、大手自動車メーカーの参戦が相次いでいる。ここが次世代モータースポーツの場であり、高度な自動運転技術を磨く場でもある。モータースポーツファンは進化が止まったF1から、次世代レーシングFormula Eに乗り換えている。Formula Eで磨かれたEV技術や自動運転技術が次世代のクルマ産業を支えることになる。