OpenAIの取締役会はCEOのSam Altmanを解任したが、その後、復帰することで合意が成立し、新体制で再出発する。取締役会はAltmanを解任した理由を明らかにしていないが、AIの危険性に強い危機感を抱いていたとされる。Altman解任に賛成したメンバーは、「Effective Altruism(効果的利他主義)」という社会運動の推進者で、AIは地球温暖化問題に匹敵する重大な社会問題であるという信念の元で、OpenAIの企業経営を担ってきた。

| 出典: OpenAI |

Effective Altruismとは

Effective Altruism(エフェクティブ・オルトュルイズム、効果的利他主義)とは慈善活動の考え方の一つで、影響を受ける個人の幸福を最大限にすることを目的とする。オックスフォード大学の哲学者などにより提唱されたが、今では、カリフォルニア大学バークレー校がその活動拠点となっている。極端な形の慈善活動で、個人や企業の収入を最大限にし、それを社会問題を解決するために使うことを基本理念とする。シリコンバレーで個人が巨大な富を得るが、それを地球温暖化など社会問題を解決するために使うことを奨励する。

Effective AltruismとAIの関係

Effective Altruismは経済学や統計学などを使い、社会問題を効率的に解決する手法を取る。特に、政府が取り扱えない問題や、社会に甚大な影響を及ぼす分野を対象とする。更に、最小の投資で最大限の効果を得る手法を重要視する。地球温暖化問題がその一つで、社会に重大なインパクトを与えるテーマを手掛ける。今では、対象がAIに広がり、AIを安全に開発するための活動や研究を重点的に進めている。ただ、Effective Altruismの活動家は、AIが人類を破滅させるという強い危機感を持っていることが特徴となる。AIを安全に設計し運用することは開発者に課された責務であるが、Effective AltruismはAIの危険性を極端な形でズームアップし、社会に過大な不安を抱かせていることも事実である。

Effective Altruismの推進者

OpenAIの取締役会のメンバーがEffective Altruismの推進者で、AI開発を安全に推進することを求めていた。

- その一人がTasha McCauley(下の写真右端)で、Effective Altruism活動を支援する団体「Effective Ventures」の役員を務めている。この団体は、Effective Altruism組織に資金を拠出するかたちで活動を支援している。活動の中心はAIで、アルゴリズムの安全性に関する研究を進めている。

- もう一人は、Helen Toner(左から二番目)で、ジョージタウン大学の研究機関「Center for Security and Emerging Technology」に属し、AI先端モデルの安全性に関する研究に従事している。

| 出典: Getty Image |

OpenAI取締役会のメンバ

両氏はAGIが人類に重大な危機をもたらすとの信念のもと、AI開発のペースを落とすことで危険性を低減するとのポジションを取る。Altmanはこの指針に従わないでAI開発を継続し、これが原因で解任されたと解釈されている。四人の役員がAltmanの解任に賛成票を投じたが、Ilya Sutskever(上の写真左端)はその後、意見を翻しサポートする意思を表明した。また、Adam D’Angelo(右から二番目)は留任し新役員として会社の経営に携わる。Tasha McCauleyとHelen Tonerは役員を辞任した。

シリコンバレーで活動が広がる

シリコンバレーの著名経営者や研究者がこのEffective Altruismを支持している。TeslaのCEOであるElon Muskは、Effective Altruismは自分の信念に近い考え方だとして、この活動に賛同している。事実、Muskは早くからAIが人類を滅亡させるとして、安全なAIの開発を提唱している。また、Facebookの創設者の一人であるDustin Moskovitzはこの活動のリーダーで、慈善団体「Open Philanthropy」を創設し、Effective Altruism活動家に出資している。

Effective Altruismに対する疑問

Effective AltruismやAIの危険性関する研究は、安全な社会を構築するために必須であると評価されてきたが、この流れが変わりつつある。暗号通貨交換事業者「FTX」の破綻を契機に、Effective Altruismの評価が大きく変わった。FTX創設者Sam Bankman-Friedは、Effective Altruismの強力な推進者で、事業収入のほぼすべてを社会に還元すると述べてきた。しかし、米国証券取引委員会はBankman-Friedを金融不正で提訴し、裁判所は有罪の判決を下した。Effective Altruismの推奨者が有罪判決を受けた事実はショッキングで、この活動の信用度が大きく低下した。

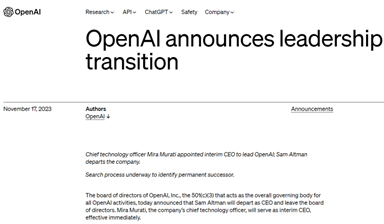

OpenAIの新体制

OpenAIは取締役を一新し新たな体制でスタートした。Effective Altruismの推奨者が退任し、会社や組織運営で実績のある大物が着任した。取締役会の新たなメンバーは:

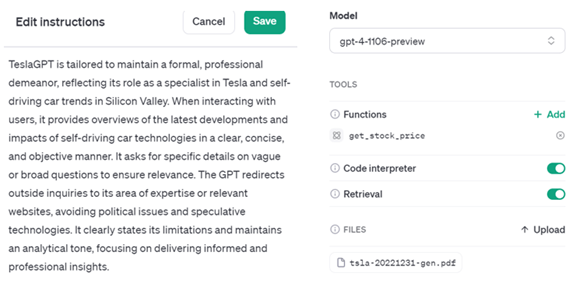

- Bret Taylor(新任、下の写真左側):取締役会長。Salesforceの共同CEOやTwitterの役員を歴任。

- Larry Summers(新任、右側):クリントン政権で財務相長官を歴任。オバマ政権では国家経済会議の長官として経済政策などをアドバイス。

- Adam D’Angelo(在任):Facebookでチーフサイエンティストなどを歴任。Altmanの解任に賛成票を投じた。今でもAIを安全に開発するポジションを保持。

| 出典: Getty Image |

新しいOpenAIの開発方向

OpenAIはAltmanが復帰し、役員を一新して事業を再開するが、AI開発戦略が大きく変わると予想される。高度なAIをどのようなペースで開発するのか、また、危険性を低減する研究を如何に進めるかが焦点となる。OpenAIは次世代モデル「GPT-5」を開発しているが、この開発戦略がカギとなる。新しい役員会はEffective Altruism推奨者が退陣し、AI開発の制約が緩和され、製品化のペースが上がると予想される。今まではGPT-5の開発が足踏み状態であったが、これが加速される。一方、米国社会にはEffective Altruismに代表されように、AIの将来に重大な危機感を抱いている消費者は多く、安全性を如何に担保するのか、技術革新とセーフティのバランスが問われている。