Googleは家庭向けのロボット「Everyday Robots」を開発しており、家庭やオフィスで人間に代わりタスクを実行する。Googleは高度な言語モデルをロボットに組み込み、人間の指示を正確に理解する機能を実現した。ロボットが実社会で人間と共棲する中で、言葉による指示を把握し、それをアクションに移す機能が必須となる。人間は複雑な内容を曖昧な表現で伝えることが多く、ロボットと人間との円滑なコミュニケーションが課題となっている。

| 出典: Everyday Robots |

Everyday Robotsとは

Everyday Robotsは家庭やオフィスで日々のタスクを実行するロボットとして開発されている。ロボットは自分で学習する機能を備え、新しいスキルを学び、日常生活で必要とする作業をすべて実行することがゴールとなる。実際、ロボットは煩雑な環境の中を自律的に動き、テーブルの掃除(上の写真)などを実行する。家庭では、家事をこなし、高齢者の介護を手掛けることが計画されている。

ロボットに搭載されるAI

Everyday Robotsは高度なAIが求められ、研究所「Google Research」と密接に開発を進めている。ロボットは、オブジェクトを掴みドアを開けるなど、基礎スキルを習得する必要があるが、この学習プロセスで、様々な種類のAIが使われている。ロボットはごみを掴み、それを分別する作業を繰り返し、正しい分別の仕方を学ぶが(下の写真)、ここでは強化学習(Reinforcement Learning)というAIが使われる。

| 出典: Everyday Robots |

また、人間が手本を示し、そのスキルをロボットが学習するが、このAIは模倣学習(Imitation Learning)と呼ばれる。更に、ロボットは現実社会を3D仮想空間に再現したデジタルツインでスキルを学ぶが、これはシミュレーション(Learning from Simulations)による学習手法となる(下の写真、オフィスのデジタルツインでごみの分別などを学習)。

| 出典: Everyday Robots |

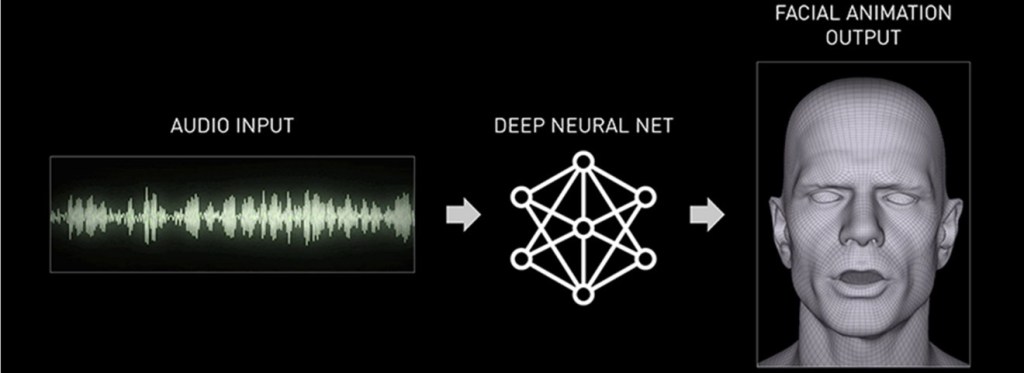

高度な言語機能を統合

これら基礎スキルに加え、ロボットが人間の指示を理解するために、言葉の意味を把握するAI「PaLM-SayCan」が組み込まれた。これによりロボットは、言葉を理解し、指示された内容を物理的なタスクに置き換えることができる。このPaLM-SayCanは、言葉による抽象的な概念を、基礎スキルに置き換え、これに従ってロボットはタスクを実行する。多くのケースで、人間の命令は複数のタスクを含んでおり(下の写真上段)、PaLM-SayCanはこれを解釈してロボットに示す(下段)。

| 出典: Everyday Robots |

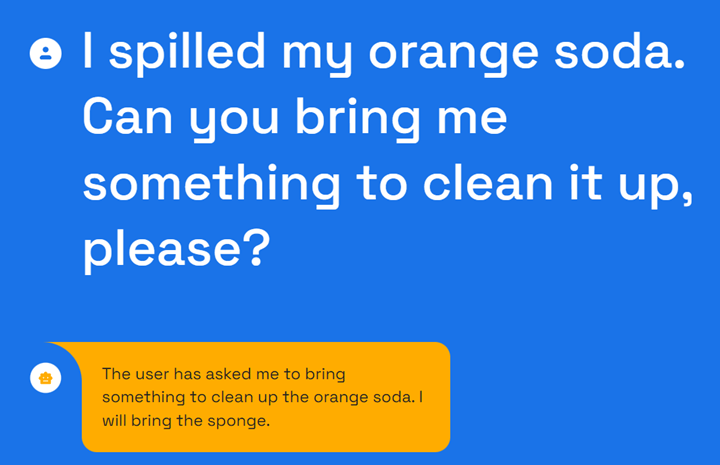

テーブルで飲み物をこぼすと

例えば、ロボットに「ソーダをこぼしてしまった。何か拭く物を持ってきて。」と指示すると(上の写真上段)、AIは「利用者はソーダをふき取るものを持ってきてほしいと要求。掃除用のスポンジを持って行くと」解釈する(下段)。これはAIにとって難解の指示で、PaLM-SayCanは命令をステップに分けて考察し、最適なアクションを見つける。

| 出典: Everyday Robots |

ロボットのアクション

ロボットはこの解釈に従って、キッチンのテーブルの上に置かれているスポンジを取り上げ(上の写真)、それを利用者のテーブルに届ける(下の写真)。これは単純な命令「スポンジを持ってきて」ではなく、ロボットは命令の意味を解釈する必要がある。ロボットは「拭き取るもの」の意味を理解し、スポンジを取り上げた。ペーパータオルで代行できるが、それはキッチンになく、スポンジを選択した。

| 出典: Everyday Robots |

AIの思考過程

つまり、対象のオブジェクトが実社会で手に入るかどうかを判断するステップが必要になる。PaLM-SayCanは、言葉の意味「Language」を理解することと、モノが手に入るかどうかの指標「Affordance」を評価し、その総合値でアクションを決定する。このケースでは「スポンジを探し」、キッチンで「スポンジを見つける確率が高い」ことから、このアクションを選択した(下のグラフ、最上段)。

| 出典: Everyday Robots |

現実社会へマッピング

多くの言語モデルが開発されているが、それらはインターネットで稼働し、人間との会話などで使われる。一方、PaLM-SayCanは、ロボットが現実社会で人間の指示を理解するために利用される。言語モデルであるが、人間の指示を理解するだけでは不十分で、理解した内容を現実社会で実行できるかを検証するステップが必要となる。上述のケースでは、スポンジを見つけることができるかが問われ、高度な判断が求められる。PaLM-SayCanは現実社会と関連を持ち、ロボットの言語機能として注目されている。