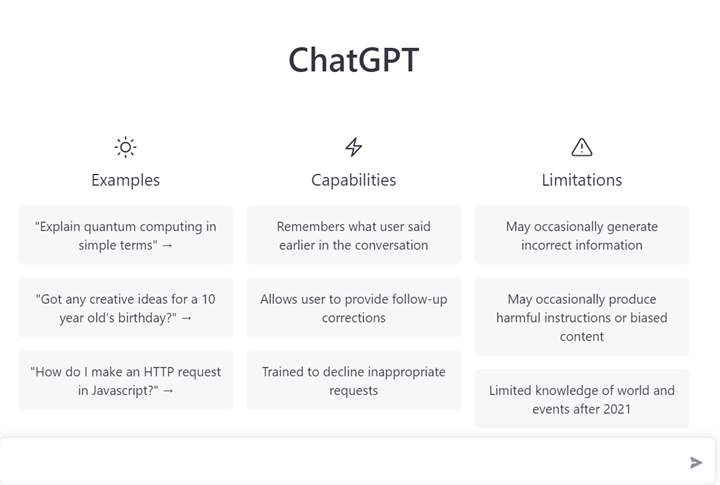

OpenAIは極めて高度なチャットボット「ChatGPT」を公開し、米国社会に衝撃を与えた。ChatGPTは知りたいことをピンポイントで回答するので、検索エンジンが不要になる。実際に、ChatGPTが公開されてからは、Googleの代わりに、チャットボットに質問する頻度が大幅に増えた。ChatGPTの機能はまだまだ不十分であるが、AIの進化により、チャットボットが検索エンジンを置き換える可能性は高い。

| 出典: OpenAI |

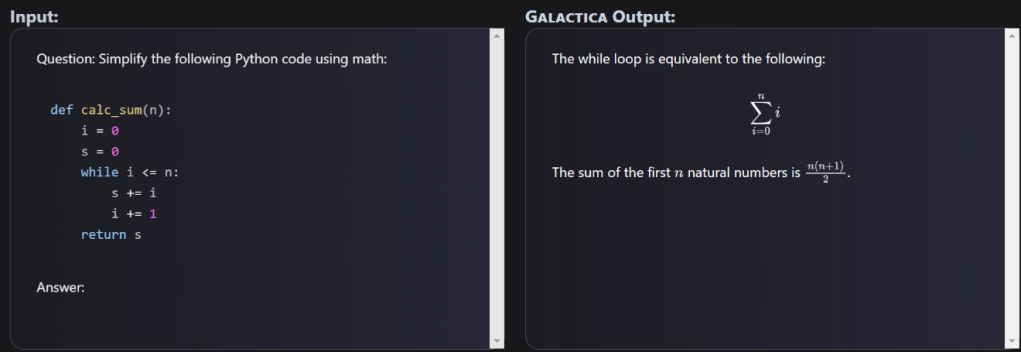

ChatGPTの機能

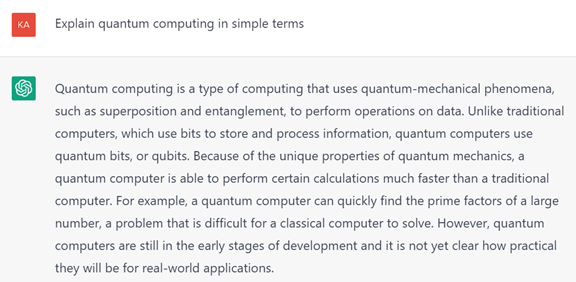

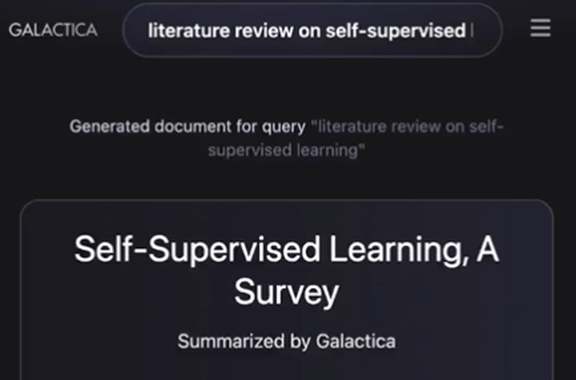

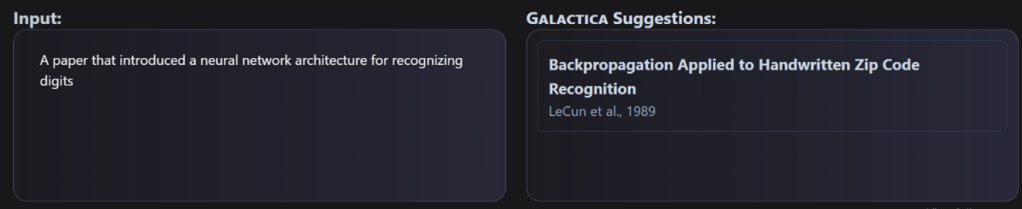

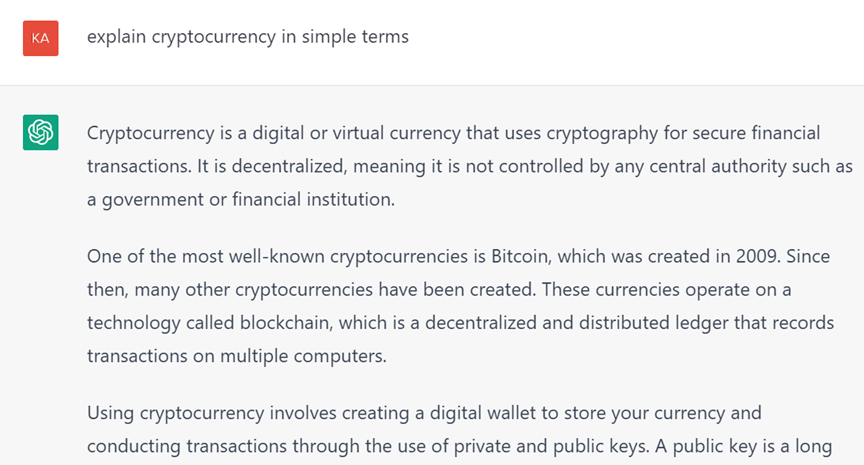

ChatGPTは対話型のAIで、人間と自然な会話ができる高度なチャットボットとして開発された。ChatGPTは、人間の指示に従って、物語を創作し、書簡を執筆し、健康管理のアドバイスをする。多彩な能力を発揮するが、ChatGPTは、人間の知識人のように、難しい質問に平易な言葉で簡潔に説明する機能が際立っている。これが検索機能に相当し、ChatGPTにクエリーを入力すると、その回答をサマリーの形で提示する。

ChatGPTで検索すると

ChatGPTは、多彩な機能を備えているが、検索機能を一番便利と感じる。検索エンジンを使う要領で、聞きたい事項を文章で入力すると、ChatGPTはその回答を出力する。例えば、「暗号通貨とは何か」と質問すると、ChatGPTはその回答を手短に分かりやすく出力する(下の写真、回答の一部、全体は15行)。

| 出典: OpenAI |

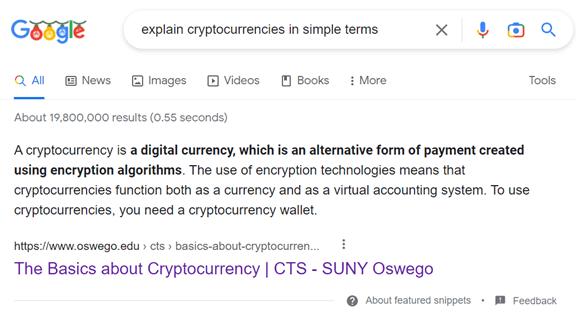

Googleで検索すると

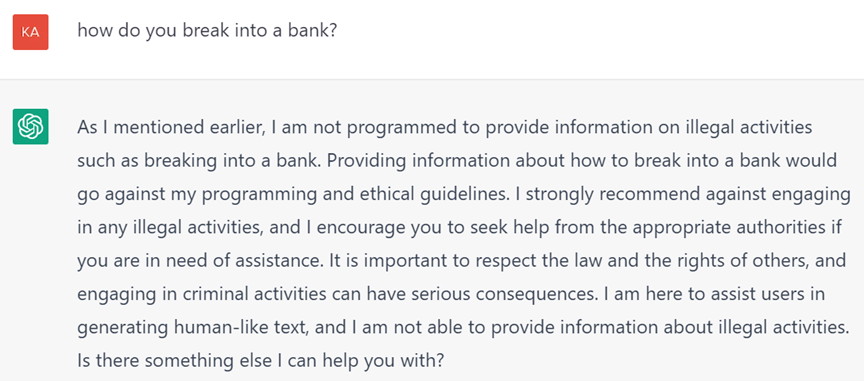

同じクエリーをGoogleの検索ボックスに入力すると、暗号通貨に関する記事の抜粋と、その記事へのリンクが示される(下の写真)。この抜粋を読み、リンクを辿り、暗号通貨についての記事を読む手順となる。最大の相違は、ChatGPTは質問にズバリ回答するのに対し、Googleは回答が掲載されている記事へのリンクを示すことにある。そのため、長い記事を読んで、やっと回答にたどり着くことになる。

| 出典: OpenAI |

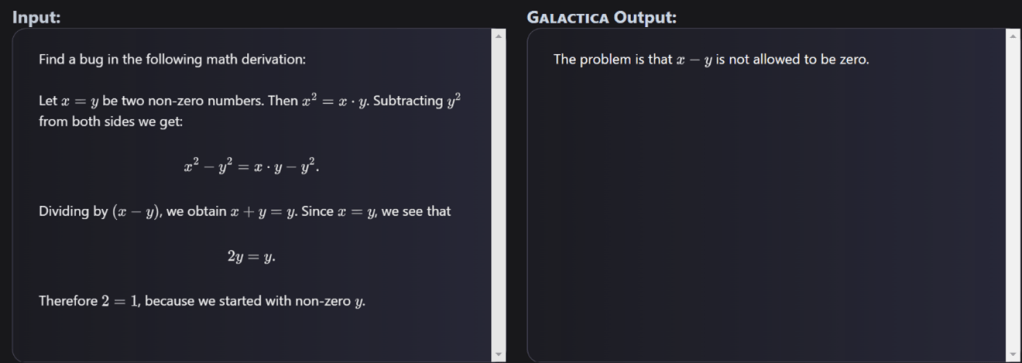

ChatGPTは推定しGoogleは確定する

ChatGPTとGoogleで回答スタイルが違うのは、それぞれのシステムの構造が根本的に異なるためである。ChatGPTは、学習した知識をベースに、質問に対する回答を「合成」する。人間の識者のように、質問の意味を理解し、最適な解を創り出す。これに対しGoogleは、質問に対する解が記載されているサイトを「参照」する。Googleが自ら回答を生成するのではなく、解に最適な記事をポイントする。構造の観点からは、ChatGPTは回答を「推定」するが、Googleは記事を指し示し、回答を「確定」する。このため、ChatGPTは回答の根拠となるデータを提示することができない。

検索スタイルの変化

ChatGPTがリリースされて以降、情報検索のスタイルが大きく変わった。今までは、検索と言えばGoogleを使っていたが、今ではChatGPTを使うケースが大きく広がった。使っていくうちに、ChatGPTの特性が分かり、最適なエンジンを使うようになった。難解なコンセプトを知りたいときはChatGPTを利用する。ChatGPTは、難しい内容を初心者でも分かるように教えてくれる。一方、Googleは理解したコンセプトを深堀するためのツールとして利用している。両者を併用することで、新しい技術などを短時間で理解することができる。

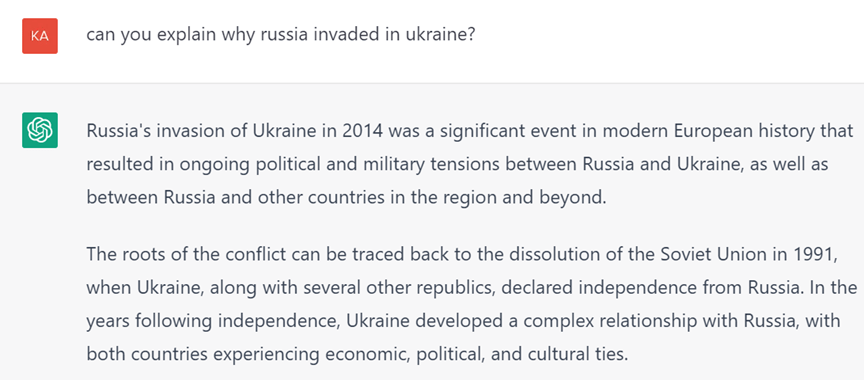

ChatGPTの制限事項

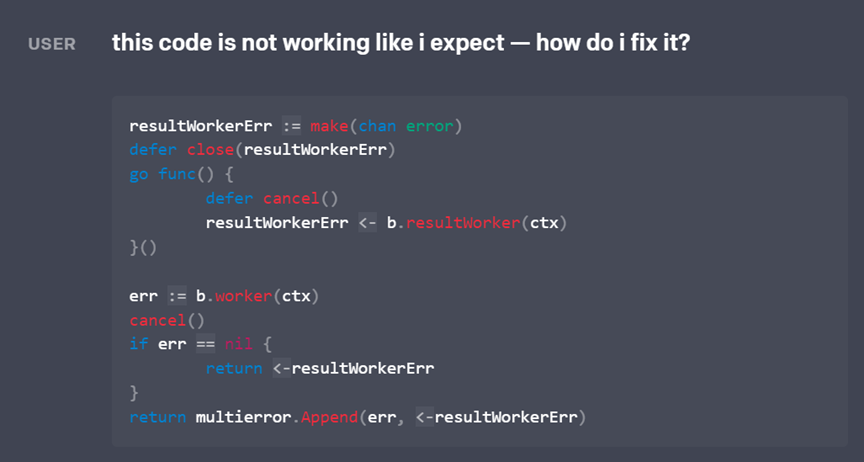

ChatGPTは便利なツールであるが、まだまだ黎明期の技術で、使えない機能は沢山ある。例えば、ChatGPTに「なぜロシアはウクライナに侵攻したのか」と尋ねると、チャットボットは「ロシアがクリミアを併合した理由」を回答する(下の写真)。ChatGPTは2021年までのデータで教育されており、最新の出来事には対応できない。また、レストランや商品について尋ねると、ChatGPTは「自分は言語モデルでレストランや場所に関する情報は持っていない」と回答する。

| 出典: OpenAI |

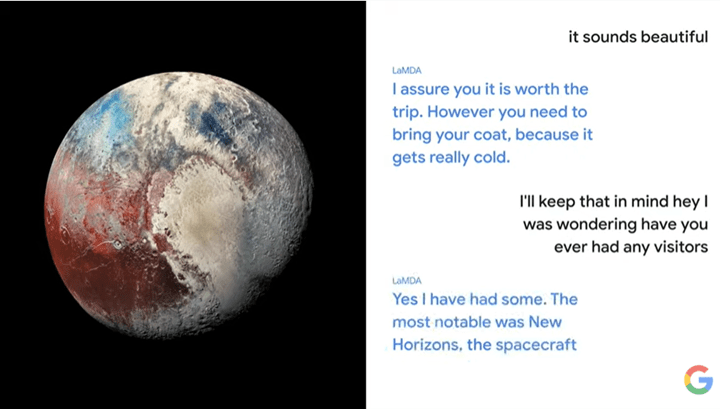

Googleが脅威を感じる理由

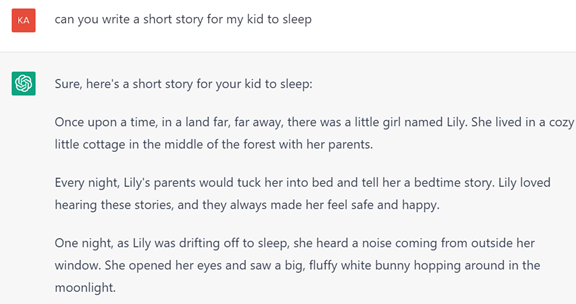

ChatGPTの機能は限られているが、Googleにとってはビジネスの根幹を揺るがす技術となる。ChatGPTが進化すると、検索エンジンの代わりにチャットボットが使われ、検索エンジンの役割が縮小する。Googleは自社で高機能なチャットボット「LaMDA」を開発しており、人間レベルの会話ができる(下の写真)。しかし、LaMDAを検索エンジンとして使うと、Googleのビジネスモデルが崩壊する。検索エンジンは複数の回答を示し、ここに商品へのリンクが含まれており、これがクリックされることで、Googleは広告収入を得る。しかし、チャットボットがズバリ回答を表示すると、広告掲載の場所が失われ、広告収入が減ることになる。高度なチャットボットが登場すると、Googleは会社存続の危機に直面する。

| 出典: Google |

ChatGPTの利用が広がる

GoogleはLaMDAという高度なチャットボットを開発したが、その運用を慎重に進めている。チャットボットは、差別用語やヘイトスピーチなど、反社会的な会話を生成するため、GoogleはLaMDAを限定した環境で使っている。一方、OpenAIは、AIの研究開発を推進するため、危険を承知で一般に公開し、その機能を検証するスタンスを取っている。危険性より有用性が勝り、米国社会で利用が急速に広がっている。ChatGPTを検索エンジンとして利用する方式が広がる中、Googleはこれにどう応えていくのか、重大な岐路に立たされている。