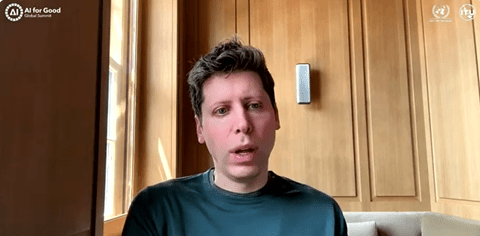

国際連合はスイス・ジュネーブでAIサミット「AI for Good Summit」を開催した(下の写真)。サミットは国際連合が提唱している「持続可能な開発目標(Sustainable Development Goals)」をテーマに、AIで貧困の撲滅や男女間の差別を根絶する手法などが議論された。また、Sam Altmanがオンラインで出席し、OpenAIのAI開発ポリシーを対談形式で説明した。AltmanはAI技術を段階的にリリースし、社会がこれを理解したうえで、政府はAIを段階ごとに規制する、共棲政策(Co-Evolve)という考え方を示した。同時に、AI開発は米国企業が安全性より利益を優先して進めている姿勢が明らかになった。

| 出典: AI for Good |

AI for Good Summitとは

AIサミット「AI for Good Summit」は国際連合(United Nations)が主催するAIサミットで、国際電気通信連合(International Telecommunication Union)がイベントを運営した。サミットはコロナの期間を除き、毎年スイス・ジュネーブで開催されており(下の写真)、今年は先週実施され、主要セッションはビデオで配信された。サミットはAIを活用してグローバルな問題を解決し、持続可能な開発目標(Sustainable Development Goals)を推進することをテーマとする。AIを活用する分野として、下記の分野が注目された:

- 医療:AIによる病気診断や新薬の開発

- 気候変動:AIによる気候モデル開発や災害の予測技術

- 性差別:AIを活用した教育で男女間の不平等を解消

| 出典: AI for Good |

Sam Altmanの基調講演

AIサミットのハイライトはOpenAIのCEOであるSam Altmanの基調講演「AI for Good Keynote interview」で、対談形式でAIの開発思想やリスク管理政策などが示された(下の写真)。対談形式で進められ、Nicholas Thompson (The AtlanticのCEO)が司会を務めた。AltmanはThompsonの質問に答える形で、OpenAIのAI開発戦略や安全対策など、広範囲にわたり意見を述べた。インタビューでは厳しい質問が相次ぎ、Altmanは回答を控える局面が多く、OpenAIはオープンな会社からクローズドな組織に移ったとの印象を与えた。OpenAIはAIのリスク管理を厳格に実行する指針を大きく緩和し、技術優先でAI開発を進めている実態も明らかになった。

| 出典: AI for Good |

AIの恩恵と危険性:サイバーセキュリティが最大の関心事

Altmanは、OpenAIが開発しているAIについて、ポジティブなインパクトについて、産業の様々な分野で生産性をあげることに貢献していると説明。ソフトウェア開発からヘルスケアまで、プロセスが効率化され、ビジネストランスフォーメーションが加速している。一方、ネガティブな側面については、サイバーセキュリティが最大の関心事であるとの考え方を示した。ロシアや中国などがOpenAIの技術を悪用してサイバー攻撃を展開している事例を挙げた。

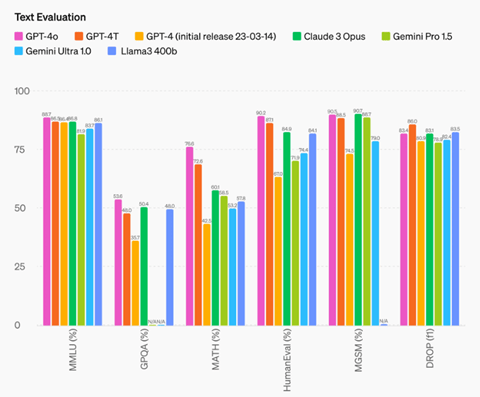

AIモデルの性能:まだ伸びる余地は大いにある

GPT-4は英語、スペイン語、フランス語を中心に教育され、他の言語が置き去りにされているとの指摘に対し、OpenAIは世界の言語の97%をカバーしていると説明。また、AIモデルの開発で、機能進化が頭打ちになっているかとの質問に対し、AIモデルは漸近線(asymptote)には達しておらず、まだまだ伸びる余裕は大いにあるとの解釈を示した。同時に、多くの研究者が性能や機能の伸びを予測しているが、OpenAIは予測ではなくこれを実際に示すことが任務であると回答。

データについて:次世代モデル開発で高品質データが必須

インターネットにはAIで生成された合成データ「Synthetic Data」が満ち溢れ、これでAIモデルを教育すると性能が劣化するとの指摘に対しては、AI教育では高品質なデータが必須となるとの考え方を示した。インターネットには言語モデルで生成した合成データだけでなく、人間が生成した品質の悪いデータが沢山掲載されている。このため、高品質なデータが次世代モデルの開発に必須で、これが信頼性の向上や効率化の促進に繋がると述べた。(OpenAIはAtlantic社の記事をAIモデルの教育で使うことで合意している。)

AGIについて:人間と互換性を持つシステム

OpenAIは人間のインテリジェンスを持つAGIを開発目標にしているが、AGIが登場すると人間と区別がつかなくなり社会が混乱するとの意見がある。これに対し、AGIを開発する理由は人間とAIのインターフェイスを劇的に改良するためであるとの考え方を示した。AGIを「human-compatible systems」と捉えており、AGIはあくまでインターフェイスで、決して人間とはならないと述べた。言語を通じて人間と互換性を確立し、使いやすいシステムを実現する。別の事例がヒューマノイドロボットで、人間と言葉で対話するが、骨格はハードウェアで人間とは全く異なる。

| 出典: AI for Good |

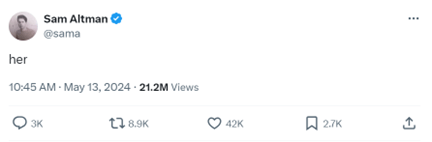

声の所有権に関して:フェイクボイスに関しノーコメント

GPT-4oが持つ声の一つが「Sky」で、これが女優スカーレット・ヨハンソン(Scarlett Johansson)の声に酷似しているとの指摘に対し、AltmanはJohanssonの声を模倣する意図は無かったと述べるに留め、問題の背景についての説明は差し控えた。OpenAIはAIの進化によるフェイクボイスの危険性を喚起しているが、自らがJohanssonと酷似する声を使っており、この釈明に苦慮している。

(問題の経緯:AltmanはJohanssonに声の使用を打診したが、Johanssonはこれを断り、OpenAIは声優を使って類似したボイスを生成した。JohanssonはGPT-4oの声が自身の声に酷似しているとして、OpenAIを提訴した。)

規制の方式:AIと社会が共に進化する「co-evolve」という考え方

AIの規制に関し、政府は選挙対応など目前の問題にフォーカスしているが、長期レンジで考える必要があるとしている。AI技術は急速に進化し、社会や市民がこのスピードに追随できず、AIを正しく理解できない。このため、高度なAIを一度に投入するのではなく、その機能を段階に分けて徐々に経てリリースする。社会や市民ががこれを理解したうえで、政府はAIの規制を段階的に進めるべきとの考えを示した。これは技術と社会が共に進化する「technology and society co-evolve」という考え方で、これをAI規制のコアとすべきと提言。

社内ガバナンス:リスク管理が形骸化しているとの指摘にノーコメント

OpenAIの取締役から退任したHelen Tonerらは、OpenAIのガバナンス体制に関しエコノミストに投稿し、この機能が全く機能していないと主張。これに対し、AltmanはOpenAIのガバナンス機能について明確に説明することなく、Tonerの主張に合意できないと述べるに留めた。また、安全技術開発の総責任者Ilya Sutskeverが退社したことについても説明は無く、OpenAIはAIの安全性の探求から、AIの機能性の開発に重点をシフトしたとの印象を与えた。

| 出典: AI for Good |

Altmanのメッセージ:AIの恩恵と危険性のバランスを考慮した規制政策

Altmanはインタビューを総括して、AIはアップサイドが大きいが、同時に、社会に危害を及ばさないよう安全性を担保することが開発企業の責務であると述べた。短期的な危険性や長期的な不確実性に捕らわれるのではなく、AIのリスクを包括的に理解することが重要としている。行政府はAIの恩恵とリスクを把握し、バランスよくAI規制を実行すべきとしている。

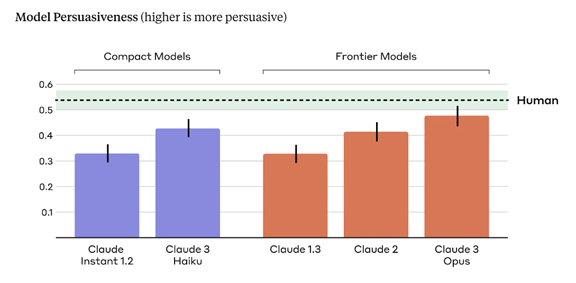

Altmanの発言を聴くと:OpenAIは利益追求会社に転身

AltmanはThompsonの厳しい質問に対して、しばしば回答に詰まり、明確なコメントを避ける場面が目立った。また、回答はコンセプトのレベルで、OpenAIの具体的な安全技術について語ることは無かった。特に、AIの説明責任技法(Explainability)について問われると、Altmanは競合企業Anthropicが開発した技法を引用し、自社の研究開発には触れることは無かった。OpenAIはAIの安全技術で業界をリードしてきたが、今では一転して、機能や性能を最優先する企業に転身したように感じた。

世界情勢:米国とグローバル社会のギャップが広がる

これはOpenAI一社の姿勢ではなく、先端AI開発で米国企業が主導権を握り、グローバル社会が求めるリスク管理より自社の利益を優先して事業を展開している事実がある。米国のAI開発政策が国連加盟国の期待とすれ違っているが、今年はそのギャップが更に広がった。