Googleは開発者会議「Google I/O」を開催し、大規模言語モデルの最新版「PaLM 2」を公表した。これは生成AIで、チャットボット「Bard」のエンジンとして使われる。また、Googleはクラウド経由でPaLM 2を公開し、企業はAPIでこれにアクセスし、独自の生成AIを開発することができる。更に、Googleは次世代の生成AIとして「Gemini」を開発していることを明らかにし、AIで市場をリードする姿勢をアピールした。

| 出典: Google |

最新の言語モデル「PaLM 2」

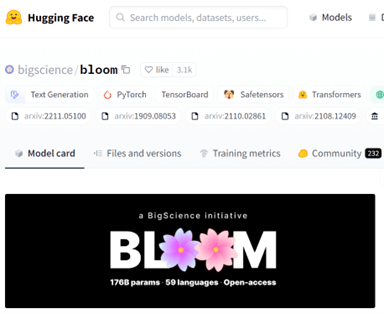

Googleは大規模言語モデルの最新版「PaLM 2」を発表した(上の写真)。PaLM 2は「PaLM」をベースとし、これを改良したもので、機能が大きく進化し、実行時の処理速度が向上した。具体的には、PaLM 2は三つの分野で際立った特性を示す:

- 多言語に対応:PaLM 2は100を超える言語を処理する機能を持つ。言語を理解する技能は人間のマスターレベルに到達。

- 推論機能が大きく向上:PaLM 2はテキストだけでなく、科学論文や数学などで教育され、その結果、論理的な思考、常識に基づく推論、数学を解く技量が大幅に向上(下のグラフィックス)。

- プログラミング技術の進化:PaLM 2はオープンソースのコードで教育され、Pythonなどでプログラムする機能を習得。この他に、PrologやFortranなど多言語に対応する。

| 出典: Google |

ファウンデーションモデル

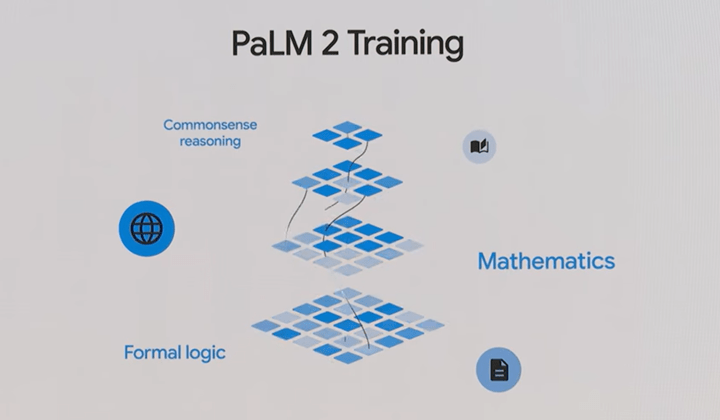

PaLM 2はAIのベースとなる「ファウンデーションモデル(Foundation Models)」として位置付けられ、ファウンデーションモデルとはAIの基本形で、様々なアプリケーションで利用される。例えば、PaLM 2はチャットボット「Bard」のエンジンとして使われ、高度な対話機能を提供する。PaLM 2はサイズ別に4つのモデルから構成される(下のグラフィックス)。これらはモデルの規模により分類され、小さいモデルから「Gecko」、「Otter」、「Bison 」、「Unicorn」と命名されている。最小モデルの「Gecko」はスマホで稼働するAIで、PaLM 2を限られた資源で実行できる。

| 出典: Google |

PaLM 2を搭載した製品

PaLM 2は既に、Googleの製品に組み込まれている。その数は25に上り、Googleの事業の骨格を担っている。PaLM 2が実装されている主な製品は:

- チャットボット「Bard」:PaLM 2を搭載したことでBardが多言語に対応する。日本語や韓国語向けのサービスを開始。また、プログラミング機能が格段に向上した。

- ワークプレイス「Workplace」:GmailやGoogle DocsなどのビジネスツールにPaLM 2が実装され、文章を生成する機能などが向上。

- ヘルスケア「Med-PaLM 2」:医療向けに最適化されたPaLM 2で、エキスパート医師のレベルの医療スキルを持つ。

- セキュリティ「Sec-PaLM」:セキュリティ向けに最適化されたPaLM 2で、サイバー攻撃の危険性などを検知するために使われる。

- クラウド「Vertex AI」:Googleは試験的にPaLMをクラウド経由で提供してきたが、PaLM 2を含めこれを一般に公開。PaLM 2のAPIで独自の生成AIを開発できる。

| 出典: Google |

Bardの最新機能

チャットボット「Bard」のエンジンがPaLMからPaLM 2にアップグレードされ、その機能が大幅に向上した。Bardは対話だけでなくプログラミングの機能があり、エンジニアの人気ツールとなっている。PaLM 2を実装することで、プログラミング機能が拡充され、また、多言語に対応できるようになった。開発しているコード入力すると、Bardがそれをデバッグする。その際に、コードにコメントを挿入する機能が登場した。(下の写真、デバッグしたコードに韓国語でコメントを挿入した事例)。

| 出典: Google |

医療向け言語モデル「Med-PaLM 2」

PaLM 2はファウンデーションモデルで、アプリケーションの基盤を構成するが、これを特定の業務ごとに最適化すると高度な機能を発揮する。GoogleはPaLM 2を医療データで再教育し、医療に特化したAIモデル「Med-PaLM 2」を開発した、Med-PaLM 2はエクスパート医師に匹敵するスキルを持ち、患者の治療で利用される。また、Med-PaLM 2はメディカルイメージングを解析する機能があり、問題点を特定するだけでなく、その理由を説明する機能がある。(下の写真、レントゲン写真を解析し、骨折の個所を特定するだけでなく、人間の医師のようにその判定理由を説明する。システムは開発中で写真はそのイメージ。)

| 出典: Google |

クラウド「PaLM API」

PaLM 2は、Googleが製品に組み込むだけでなく、一般ユーザ向けにクラウドで提供される。GoogleはPaLMを試験的にクラウドで提供してきたが、今週から、最新モデルPaLM 2を含め、一般利用者に公開した。これらはAIクラウド「Vertex AI」の新機能として実装され、PaLM APIでモデルを利用する(下の写真)。企業はこのAPIを使ってPaLM 2の機能にアクセスする。また、企業はPaLM 2を独自のデータで教育し、業務に最適なモデルを生成できる。

| 出典: Google |

次世代モデル「Gemini」

OpenAIがChatGPTを公開し米国社会でAIの普及が劇的に進んだ。MicrosoftはGPT-4を組み込んだ製品を相次いでリリースし、GoogleとのAI開発競争が始まった。GoogleはBardやPaLMを開発してきたが、その成果は一般には公開されなかった。しかし、Googleは開発者会議で、最新のAIを製品に統合し、その機能を一般にリリースする戦略を明らかにした。更に、PaLM 2の次のモデルとして「Gemini」を開発していることを公表し(下の写真)、GoogleはAI市場でトップの座を維持する姿勢を鮮明にした。

| 出典: Google |