米国著作権局(United States Copyright Office)は、AIが制作したデジタルアートを、著作物として登録することはできない、との判定を下した。AIが生成したデジタルアートは、著作権法による保護の対象にはならない、ということを意味する。判定の理由は、著作権の対象は人間が生成したコンテンツで、AIは人間ではないので、著作権法で保護されないとしている。AIが高度に進化し、人間の技量に相当するデジタルアートを創作するが、これらは著作権の保護の対象とはならない。この判決でAIアートを販売するビジネスが影響を受けることになり、米国社会に波紋が広がっている。

| 出典: Imagination Engines, Inc. |

AIアートの著作権登録を申請

発明家であるStephen Thalerは、AIで創作したデジタルアートの著作権の登録を申請した。このAIは「Creativity Machine」という名前で、アルゴリズムが人間の介在無しに、デジタルアートを生成する。ThalerはAIに代わり、アルゴリズムが生成したアート (上の写真)の登録申請を行った。この作品は「A Recent Entrance to Paradise」という題名で、人工頭脳であるニューラルネットワークが、死に直面した状態を描いたものである。

米国著作権局の判決

この申請に対し、米国著作権局の委員会は、2022年2月、AIが生成したアートは人間が創作に関与しておらず、著作権の登録はできないとの判定を下した(下の写真)。著作権で保護できる著作物は、人間が制作したものに限られる、との解釈を示した。人間以外のものが創作した著作物は、著作権の保護の対象とはならないことになる。

| 出典: United States Copyright Office |

米国の著作権

米国でも日本と同様に、著作物を創作すると著作権は自動的に発生するため、改めて登録の必要はない。一方、米国では、著作権の侵害を未然に防ぐため、著作権が存在する事実を証明するために、米国著作権局に著作権登録をするケースが少なくない。Thalerのケースは、著作物が違法に複製されるのを防ぐため、また、AIという先端技術が著作権法でどう解釈されるのかを明らかにすることを目的としている。

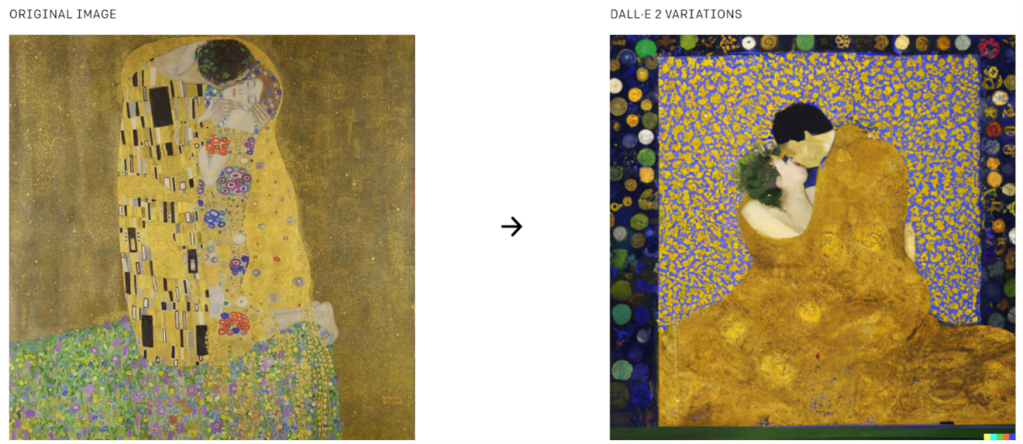

サルの自撮り写真

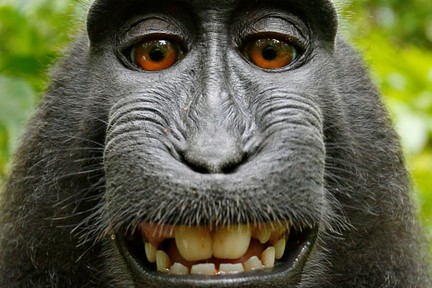

これに先立ち、サルが自撮りした写真は、著作権で保護される対象となるかが争われた。このサルは「Naruto」という名前で、写真家David Slaterのカメラを使い、自分の顔を撮影した(下の写真)。この写真がソーシャルメディアに掲載され大人気となった。Slaterは、写真集を出版し、ここに自撮りしたサルの写真を掲載した。これに対し、動物保護団体「動物の倫理的扱いを求める人々の会(People for the Ethical Treatment of Animals (PETA))」は、サルに代わり、Slaterを著作権侵害で提訴した。

| 出典: Naruto, a Sulawesi crested macaque |

裁判所の判決

これに対し、アメリカ合衆国第9巡回区控訴裁判所(United States Court of Appeals for the Ninth Circuit)は、サルの自撮り写真の著作権侵害の訴訟を棄却した。裁判所は、著作権で保護される対象は人間で、サルは保護の対象とはならないとの判決を下した。米国の裁判所は、著作権侵害で訴えることができるのは人間だけで、AIや動物は保護の対象とはならないとの解釈を示した。

ビジネスへの影響

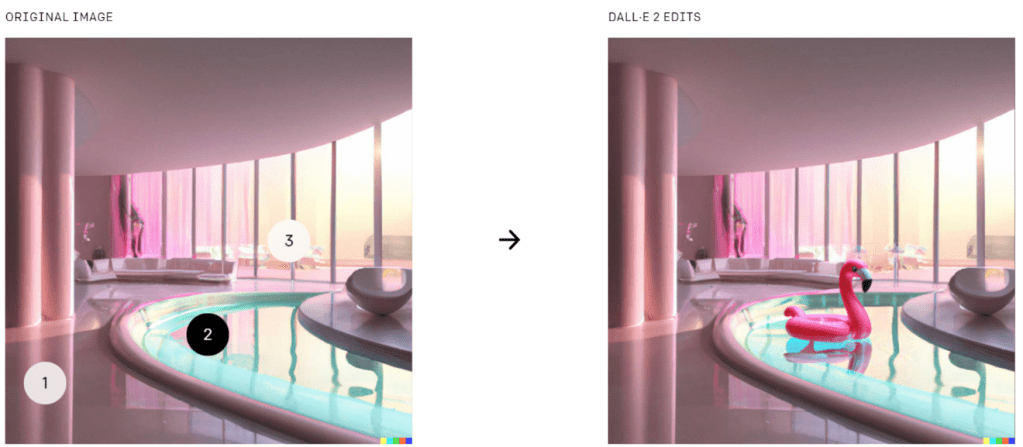

これにより、AIが創作したデジタルアートを販売しても、作品は著作権で保護されないことになる。販売されたAIデジタルアートの複製を作っても訴訟されることはない。現行の著作権法の元では、AIアートの事業は成立しないことになる。一方、デジタルアート制作の過程で人間の関与があれば、創作物は著作権で保護される対象となる。このため、人間のクリエーターが、AIというツールを使って、デジタルアートを生成すると、この作品を著作権物として登録することができる。AIアートの事業では、表向きはAIと人間の合作という看板が必要となる。

NFTとして販売

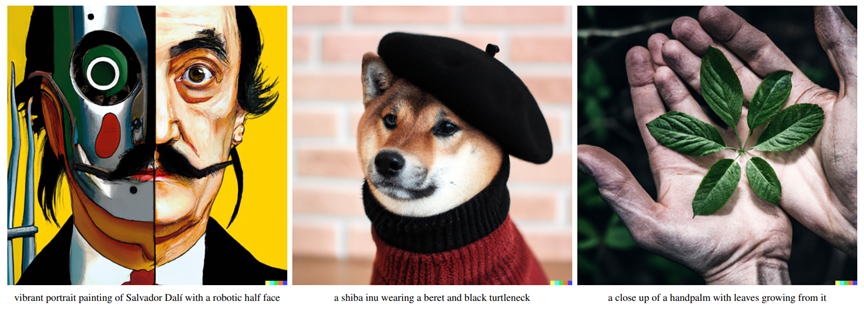

今では、AIが生成したデジタルアートはNFT(Non-Fungible Tokens)として販売されている。NFTとはブロックチェーンで構成されるトークンで、アートの所有者を証明する証文となる。NFTのマーケットプレイス「OpenSea」で様々なAIアートが売買されている。「GanStarryNight」というクリエーターは、高度なAIである「Generative Adversarial Network (GAN)」で作品を生成し販売している。GANはリアルなイメージを生成するAIで、このケースでは、ゴッホ(Vincent van Gogh)の「星月夜(The Starry Night)」をモチーフとする作品を生成した。クリエーターはそれをNFTに変換して販売している(下の写真)。一点が0.02 Ether ($60.59)ほどで、GANで生成した作品が数多く掲載されている。これらの作品はGANが自動で生成したものであるが、作品はクリエーターの名前で販売されている。

| 出典: GanStarryNight |

今では、多くの音楽はAIで作曲されている。AIミュージックの技術進歩は激しく、アルゴリズムが人間の作曲家を上回る技量を示している。これからは、トップチャートの20%から30%はAIが作曲するとの予測もある。AIミュージックに関する著作権訴訟は発生していないが、音楽でも絵画と同じ問題を内包している。著作権法はアルゴリズムによる創作は想定しておらず、AIミュージックに関しても様々な議論が起こりそうだ。