Googleはヘルスケア部門「Google Health」を設立し、医療技術開発をここに集約した。Google Healthは医療とAIを組み合わせ、高度なソリューションを開発している。Googleは次のコアビジネスとしてヘルスケアを選び、事業を大規模に展開しようとしている。

| 出典: Google |

Google Healthとは

開発者会議Google I/OでChief Health OfficeのKaren DeSalvoがGoogle Healthの最新技術を公表した(上の写真)。Google Healthはグループ内に散在していたヘルスケア部門を統合して設立された。Google Healthはコア技術であるAIを医療技術と融合し、インテリジェントな医療システムを開発する。特に、ビジョンAIでメディカルイメージングを解析することで、病院の医療プロセスを自動化する戦略を取る。

乳がん検査を自動化

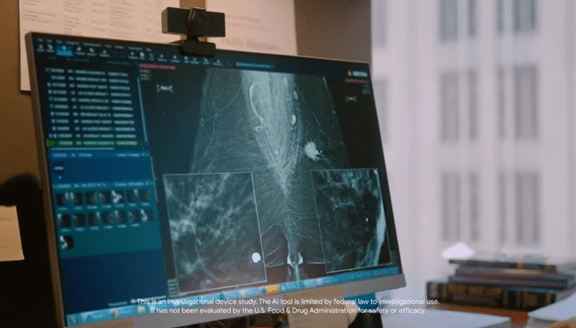

その一つが乳がん検査の自動化で、ビジョンAIががんを検知し医師の負荷を軽減する。Googleはシカゴの医療機関Northwestern Medicineと乳がんを判定するシステムの臨床試験を進めている(下の写真)。マンモグラフィー(Mammography)で撮影したイメージングから、医師が乳がんを判定するが、判定結果がでるまには時間を要す。この期間、患者は不安な日々を過ごすことになる。GoogleはこのプロセスをビジョンAIで実施し、解析時間を大幅に短縮することに成功した。

| 出典: Google |

検知システムの概要

Googleが開発したビジョンAIは医師と同程度の判定精度を持ち、メディカルイメージングからがんを特定する。AIががんを検知すると医師にアラートが送信され、追加検査など必要な措置が取られる。これにより、患者は検査結果を即時に知ることができ、精神的な負担が大きく軽減する。また、AIが医師を置き換えるのではなく、医療ツールとして機能し、最終判定は医師が下す。

眼底検査を自動化

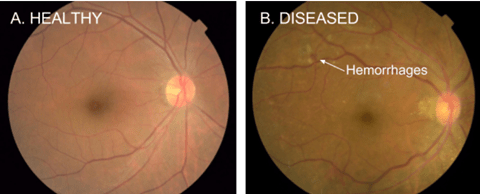

Googleは眼底の写真をAIで解析することで、糖尿病網膜症(Diabetic Retinopathy)や糖尿病黄斑浮腫(Diabetic Macular Edema)を特定することに成功した。これらは失明の原因となるが、早期に検知することでこれを防ぐことができる。AIは眼底の写真を解析し、出血を示す赤い斑点から糖尿病網膜症を判定する(下の写真左側;正常な眼底、右側;AIは糖尿病網膜症と判定)。

| 出典: Lily Peng et al. |

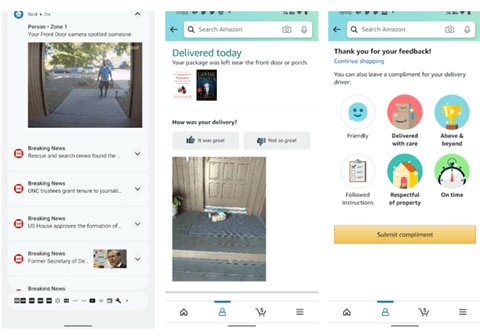

インドで臨床試験

インドでは眼科医が少なく患者の多くが、糖尿病が原因で失明に至っている。この判定をAIで実施することで、多くの人が眼底検査を受けることができる。このアルゴリズムはGoogleとVerilyで開発され、インドのAravind Eye Hospitalで試験が実施された(下の写真)。患者は特殊なカメラ(Fundus Camera)で眼底の写真を撮影し、AIはイメージングから糖尿病網膜症と糖尿病黄斑浮腫を自動で検出する。

| 出典: Google |

皮膚がんを検知

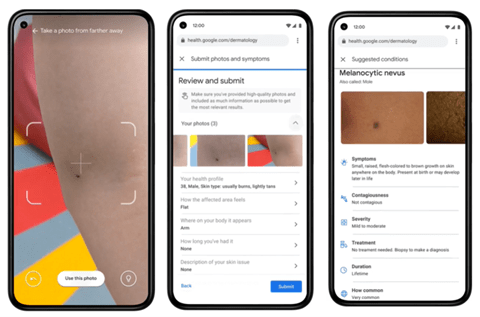

GoogleはビジョンAIを使って皮膚の状態を検査する技術を開発した。世界で20億人が皮膚や髪や爪に関する問題を抱えているが、皮膚科の医師の数は十分でない。多くの人がGoogleの検索エンジンで医学文献を探し、自分の皮膚の状態を調べている。しかし、文献を読み下すのは容易ではなく、Googleは皮膚病を判定するツールを開発した。

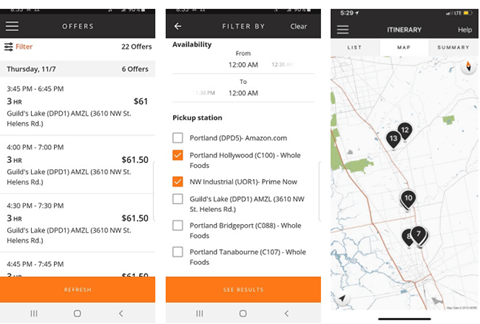

スマホアプリとして実装

これはスマホアプリとして提供され、皮膚の黒点を撮影し、AIはそれががんであるかどうかを判定する。被験者はスマホカメラで患部を撮影し(下の写真左側)、身体情報(年齢や性別や幹部の位置など)を入力し(中央)、これらをアップロードする。AIは写真イメージから、黒点ががんかどうかを判定する(右側)。皮膚がんの種類は288に及ぶが、AIはこれを正確に判定する。これは消費者向けのアプリとして提供され、問題があれば医師に相談する手順となる。

| 出典: Google |

消費者向けヘルスケア技術開発

一方、消費者向けのヘルスケア技術はFitbit部門で開発している。Googleは人気のウエアラブルFitbitの買収を完了し、スマートウォッチなどの開発を進めている。スマートウォッチは運動量や心拍数など身体データを収集し、これをAIで解析することで健康管理に関する知見を得ることができる。Fitbitはハードウェア部門Nestに属し、ここで消費者向けのヘルスケア技術を開発している。スマートウォッチはバイオセンサーとして機能し、Apple Watchを中心に、消費者向け健康管理のウエアラブルとして市場が急拡大している。