Googleは2017年5月、開発者会議「Google I/O 2017」を開催し (下の写真) AIの最新技術を公表した。GoogleはAI First企業として全社でAI化戦略「Google.ai」を進めていることを明らかにした。CEOであるSundar Pichaiが基調講演で明らかにし、その後研究詳細がリリースされた。

| 出典: Google |

Google.aiは三つの軸から成る

Google.aiはGoogleの社内プロジェクトで、高度なAIを開発しこれを全ての製品の基盤技術とする開発戦略を指す。Google.aiは「基礎研究」、「ツール」、「応用技術」の三つの分野で構成されプロジェクトが進んでいる。基礎研究とは高度なAI技法の開発で、ツールとはAIを実行するプロセッサなどを指し、AIデータセンタとして提供される。応用技術ではAIでGoogleサービスを機能強化した事例が紹介された。

AIがAIを生成する技術

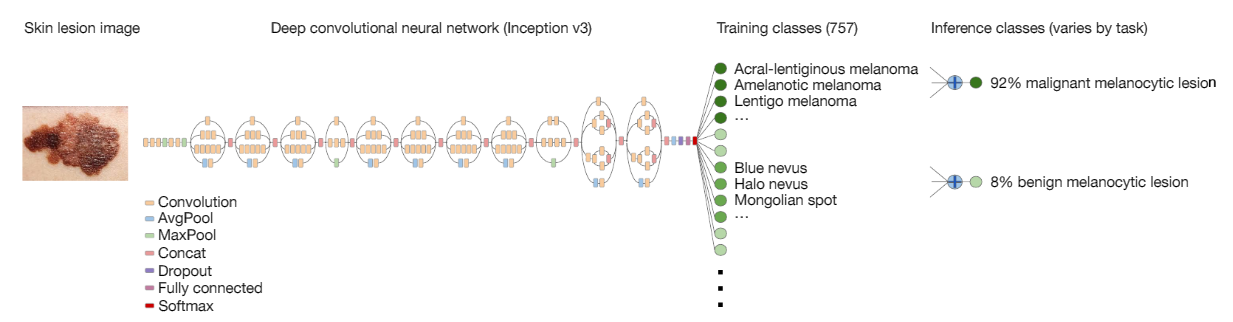

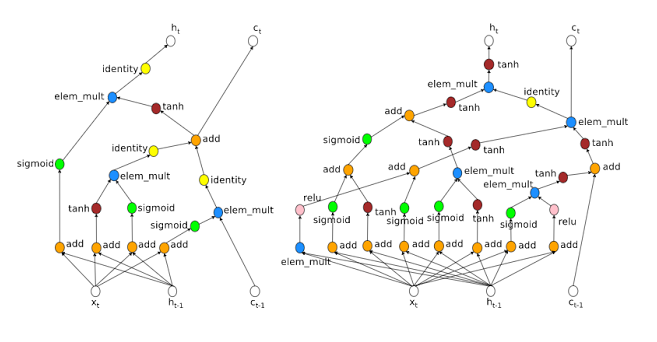

「基礎研究」でGoogleが注目しているテーマは「AutoML」である。これはMachine Learningを自動生成する研究で、アルゴリズムが別のアルゴリズムを生成する技法の開発を進めている。AIがAIを生成する技術を意味する。下の写真がその事例でAIが生成したDeep Learningアルゴリズム (右側) を示している。これはRecurrent構造 (処理結果を次のステップにループさせる構造) のネットワークで時間に依存する言語処理などで使われる。このケースではネットワークに言葉を入力すると次の言葉を予測する。

| 出典: Google |

アルゴリズム生成方式

アルゴリズム開発は研究者の経験と勘が大きく寄与する。確立されている手法をベースに改良が加えられ新しいモデルを生成する。一方、AIは数多くのアルゴリズムを生成し、これらを実際に教育し実行し精度を把握する。これらのフィードバックをもとに、精度の高いアルゴリズムの作り方を学習する。人間は定石を積み重ねるが、AIは時として常識を覆す方式を生成する。因みにこのケースではAIが生成したアルゴリズム (上の写真右側) が人間が開発したアルゴリズム(同左側)の精度を上回った。

AIがAI研究者となる

AutoMLはGoogle Brainが研究しているテーマで、AIが最適なネットワーク構成を自動で設計することを目指す。つまりDeep Learningアルゴリズム設計に携わる研究者をAIが置き換えることを意味する。AI研究者自身もAIの進化で職を失うことになる。しかし、現実はAI研究者の数は決定的に不足しており、これをAutoMLで補う構造となる。GoogleとしてはAIに置き換えられた研究者をクラウド開発に振り向け事業を強化するとしている。

AI専用プロセッサ

二番目の区分「ツール」に関しては「Cloud TPU」が発表された (下の写真)。Cloud TPUは二代目のTPU (Tensor Processing Unit、Machine Learning計算専用プロセッサ) で大規模計算用にスケーラビリティを重視した設計になっている。Cloud TPUの性能は180Tflopsで64GBの高速メモリを搭載する。

| 出典: Google |

AI First Datacenter

Cloud TPUは64個がボードに搭載され「TPU Pods」を構成する。ボードの最大性能は11.5 Petaflopsとスパコン並みの性能となる。TPU Podはラックに搭載され (下の写真)「Google Compute Engine」として提供される。Cloud TPUでAI処理専用のデータセンタを構築し、Googleはこれを「AI First Datacenter」と呼んでいる。同時に、Googleは「TensorFlow Research Cloud」を発表した。これは研究者向けのクラウドでCloud TPUを1000個連結し、先進AI技術開発のために無償で提供される。

| 出典: Google |

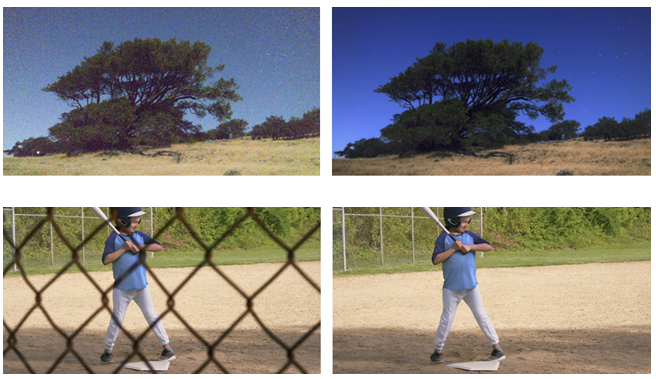

三番目の区分「応用技術」については、GoogleはAIをカメラに応用した「Google Lens」を発表した。これはカメラのレンズをAIで構成するもので、カメラの機能と性能はソフトウェアが決定する。写真撮影するとカメラがAIを使ってイメージを再構築する。夜間撮影では画像にノイズが乗るがAIがこれを補正する (下の写真上段)。シャッターを押すとカメラが自動で複数回 (例えば32回) 露光し、これを重ねてノイズを取り除く。ネット裏からの写真はAIがメッシュを取り除く (下の写真下段)。

| 出典: Google |

カメラの映像を判定

Google Lensはカメラに映ったオブジェクトを判定する機能がある。花の写真を撮影しGoogle Lens機能をオンにすると花の種類 (Milk and Wine Lily) を特定する (下の写真)。また店舗の写真を撮影するとその名称を認識し関連情報を表示する。カメラがイメージ検索の入力装置となる。Google Goggles(グーグルゴーグル)などで提供された機能であるが、AIを使って機能と精度が強化された。

| 出典: Google |

AIが返信メールを作成

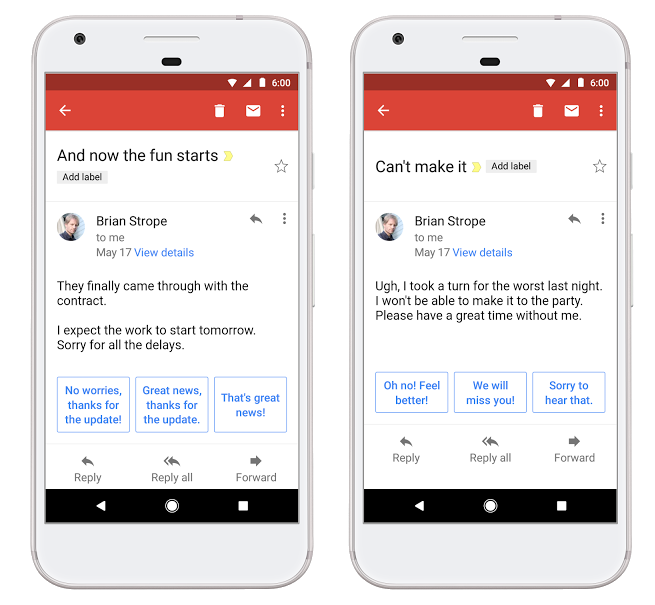

AIはGoogle製品を幅広く支えている。話題の機能が「Smart Reply」でGmailに搭載された。AIが受信したメールの題目と内容を読み最適な返信文を生成する (下の写真)。利用者は提示された三つの返信文から最適なものをクリックするだけで返信できる。Smart Replyが登場して1年以上たつが、今では複雑な内容のメールにも返信文を生成できるようになった。

| 出典: Google |

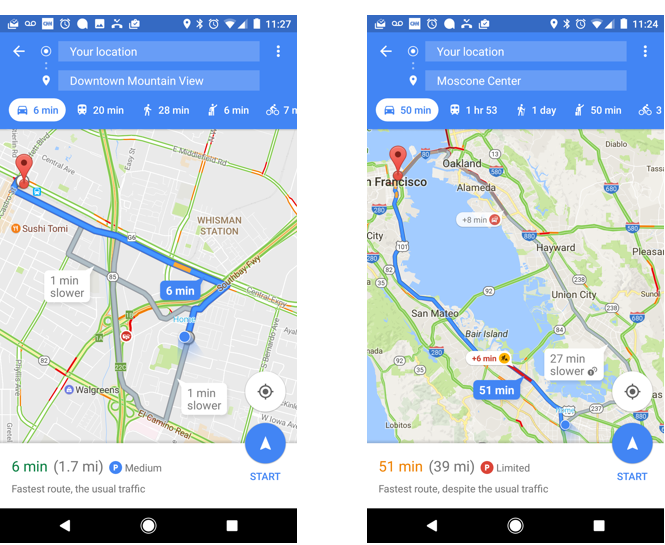

Street ViewとGoogle Mapsを強化

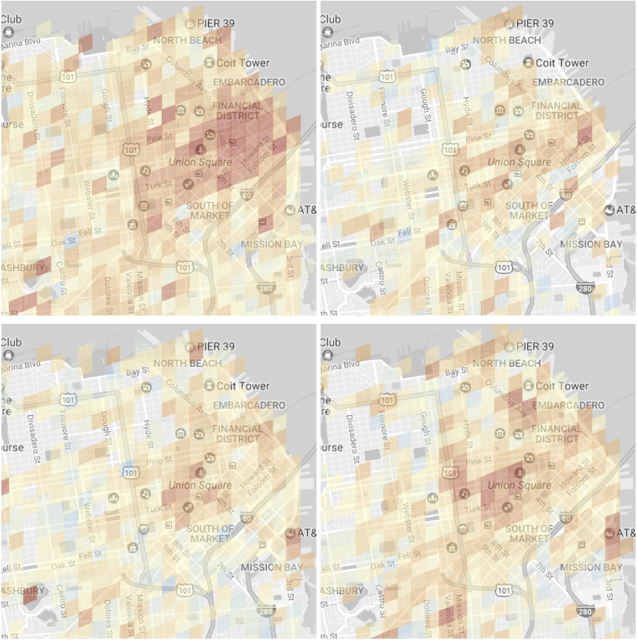

Street ViewやGoogle MapsでもAIが使われている。Street Viewで撮影したイメージから建物に掲示されている数字をAIが読み番地を特定する。今では数字だけでなく通りの名称をAIが読み場所を把握する。表札が鮮明に写っていなくてもサンプルが四つあれば (下の写真) AIが正確に判定する。この技術をStreet Viewで撮影した800億枚のイメージに適用し位置を把握する。これによりGoogle Mapsの精度が大幅に向上した。利用者から見えないところでAIがサービスを支えている。

| 出典: Google |

AIを医療に適用する

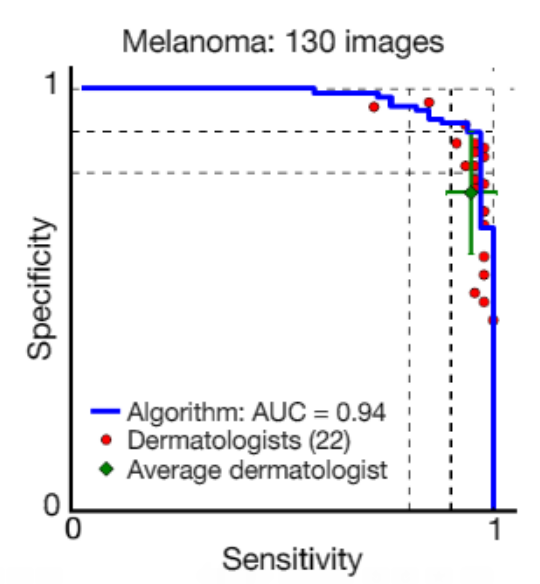

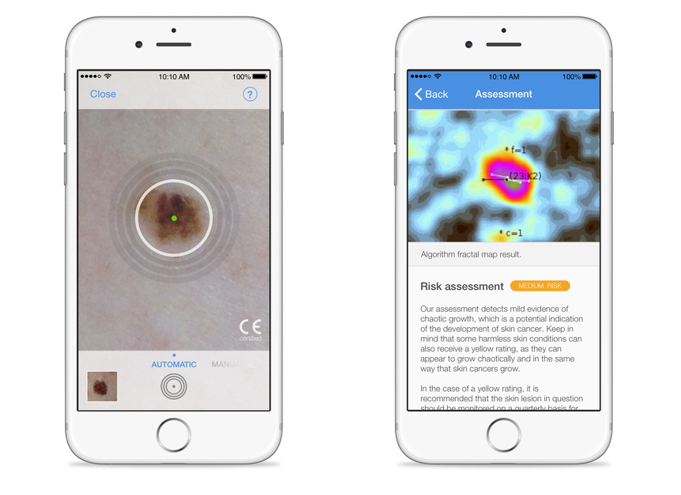

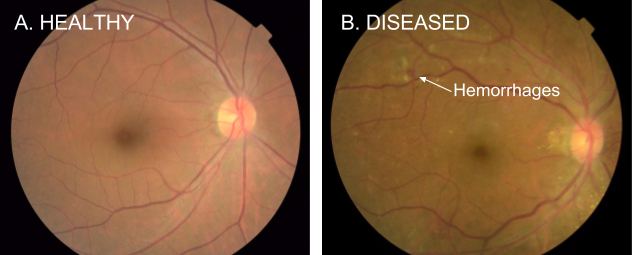

GoogleはAIを医療に適用することを明示した。Googleは既にAIを使ってDiabetic Retinopathy (糖尿病網膜症、下の写真右側、左側は健康な眼底イメージ) を判定するシステムを発表している 。Diabetic Retinopathyとは糖尿病に起因する眼の疾患で失明する可能性が高いとされる。AIが医師より高精度でこの病気を検知することに成功した。AIをメディカルイメージングに活用できることが分かり、GoogleはDeepMindと共に医療分野での研究開発を重点的に進めている。

| 出典: Google |

AIをどう製品に結び付けるのか

Googleはこの他にAIを音声認識に応用している。高度な自然言語処理機能を使いAIスピーカー「Google Home」やAIアシスタント「Google Assistant」を商品化している。Googleは全領域にAIを適用しAI First企業としてその成果をアピールした。ただ、今回の開発者会議では驚くような製品は登場しなかった。世界最高水準のAI技術を持つGoogleであるが、消費者としてはその恩恵を感じにくいのも事実であった。高度なAIをどう製品に結び付けるのかが問われており、これはGoogleだけでなくIT業界が共通に抱えている課題でもある。