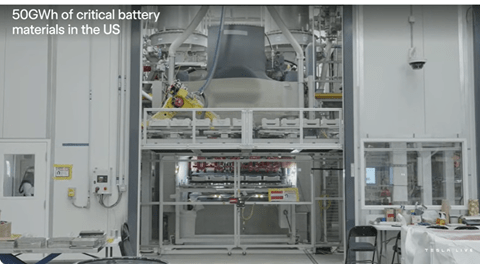

テスラのCEOであるイーロン・マスクはクルマの製品ラインを縮小しヒューマノイド・ロボットを量産することを明らかにした。サンフランシスコ近郊のフリーモント工場でEV「モデルS」と「モデルX」を製造しているがこの生産を中止し、ここでヒューマノイド・ロボット「オプティマス(Optimus)」を量産する。中国EVメーカーの躍進でテスラの販売台数が減少に転じ、事業戦略の見直しを迫られていた。マスクは決算発表で、テスラは自動車メーカーからフィジカルAI企業に転換することを表明し、ヒューマノイド・ロボットと自動運転車を次のコア事業とするとの構想を示した。

| 出典: Generated with Google Gemini 3 Pro Image |

クルマ製品ラインの縮小

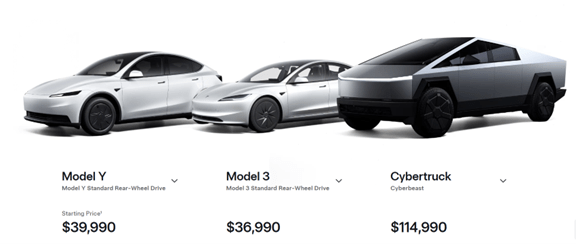

テスラは高級モデルの「モデルS」と「モデルX」のラインの製造を今年第二四半期で打ち切る。これによりテスラは普及モデルの「モデル3」と「モデルY」、及び、「サイバートラック」に絞り込む(下の写真)。マスクによると、高級モデルの販売台数は全体の3%で、リソースを普及モデルに集中し、ロボティックスの開発製造に資源を振り向けるとしている。

| 出典: Tesla |

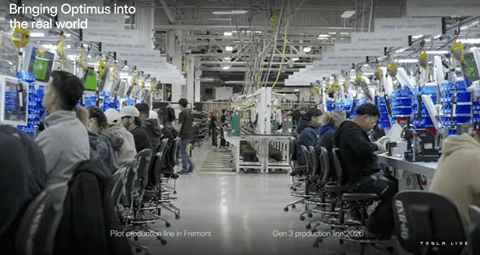

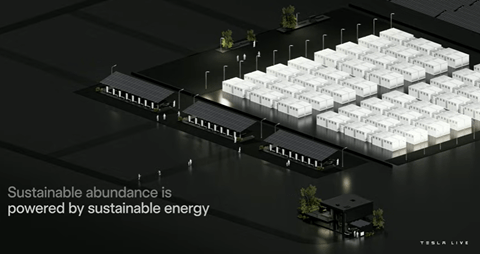

ロボットの製造工場

テスラ「モデルS」と「モデルX」はカリフォルニア州フリーモントの工場で製造されている(下の写真)。この製造施設をヒューマノイド・ロボット「オプティマス」に振り向け、ここで量産体制を確立し、ロボット製造のハブとする。既に、オプティマスはこの工場で生産が開始され、2026年末に出荷を予定し、2027年からは量産体制に入り、年間100万台を製造する。

| 出典: Tesla |

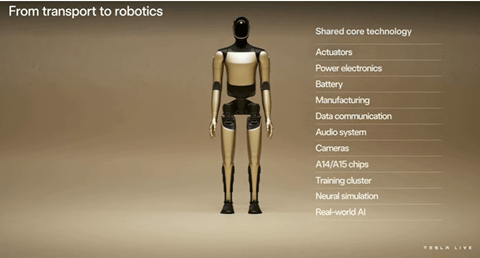

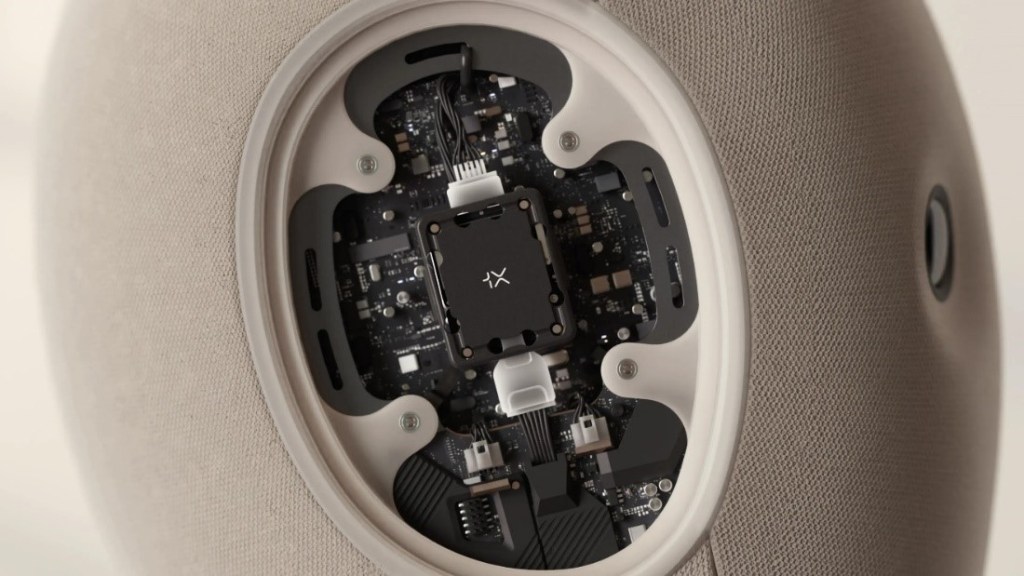

オプティマスとは

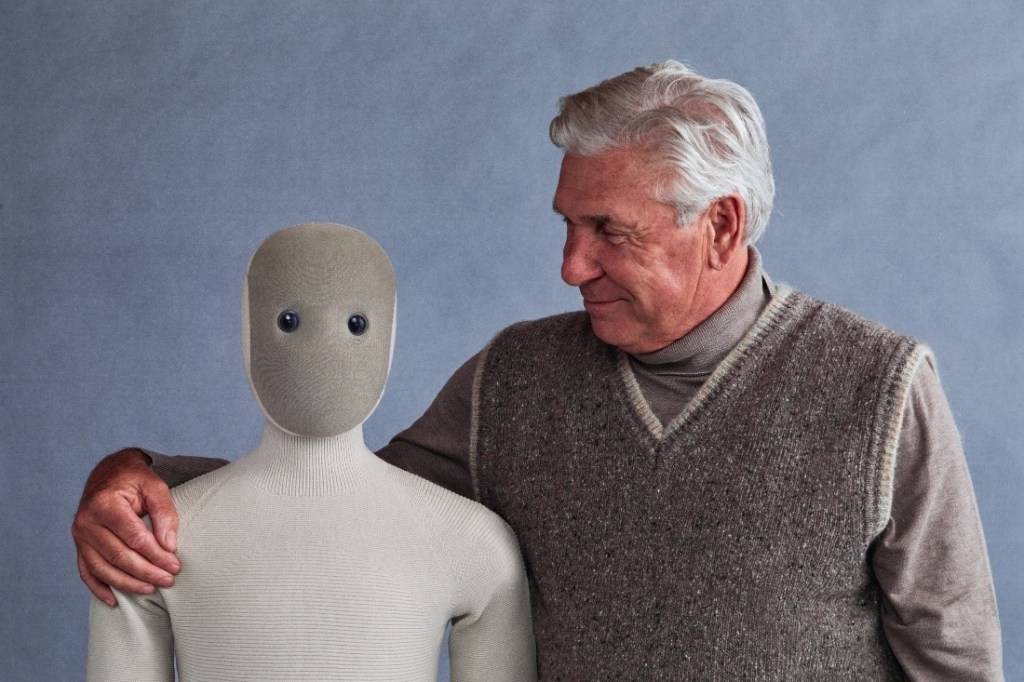

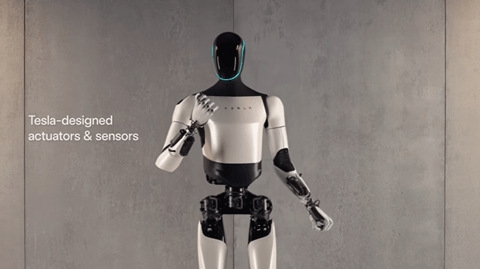

ヒューマノイド・ロボット「オプティマス(Optimus)」は人間の形状をしたロボットで、研究開発の段階から製品化の段階に入った。最新モデルは「Gen 3」(第三世代のロボット、下の写真)で、今年初頭から生産が始まった。第三世代のオプティマスはロボットハンドが大きく改良され、22の自由度(22 degrees of freedom)を持ち、人間レベルの器用さで柔らかいオブジェクトを掴み、ツールを使うことができる。また、歩行技術が格段に進化し、今までは中腰で歩いていたが、これが人間のように自然な歩行(かかとつま先歩行)ができ安定性が進化した。

| 出典: Tesla Optimus |

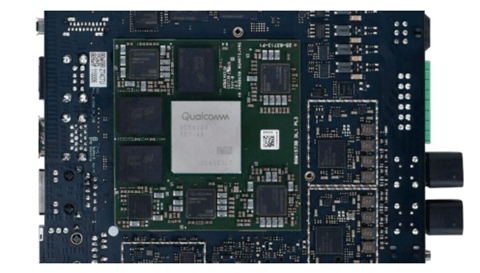

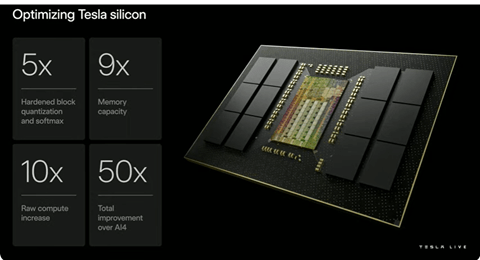

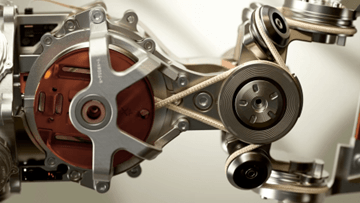

ロボットのブレイン

オプティマス最新モデルは高度なAIモデルを搭載しており、カメラのイメージを解析して自律的に歩行する。このAIモデルはテスラ自動運転技術である「Full-Self Driving (FSD)」の最新モデル「v13」をベースにしている。アルゴリズムは「Vision-Based Neural Networks」と呼ばれ、単一のAIモデルが入力シグナルを解析しデバイスを操作する命令を出力する。従来モデルは、人間が開発したソフトウェアが次のアクションを生成していたが、最新モデルは全てのプロセスをAIモデルが実行する。

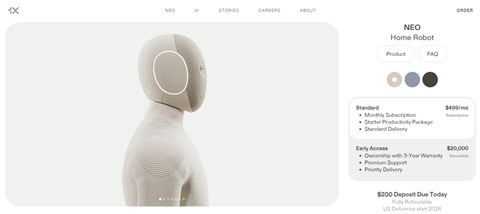

ロボットの適用分野

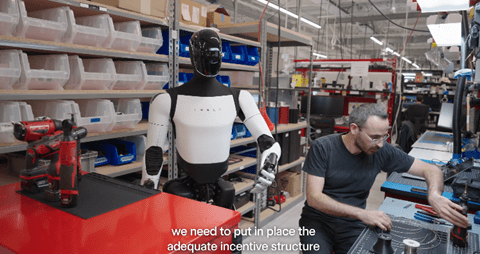

オプティマスはテスラの製造工場「ギガ・テキサス」に導入されクルマの製造を実行している。マスクは自動車の製造ラインで人間に代わりオプティマスを導入し、製造ラインを自動化する構想を示している。また、オプティマスは他の製造企業でも導入され、社員が3-5台のロボットを使って作業すると予測する。また、消費者向けには各家庭が1台のロボットを所有する時代が始まると述べている。マスクはヒューマノイド・ロボットの販売台数はスマートフォンを上回り巨大産業になるとのビジョンを示している。(下の写真、製造工場でオプティマスが作業員をアシストする)

| 出典: Tesla Optimus |

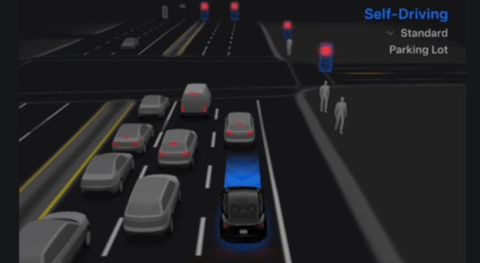

次世代の自動運転車

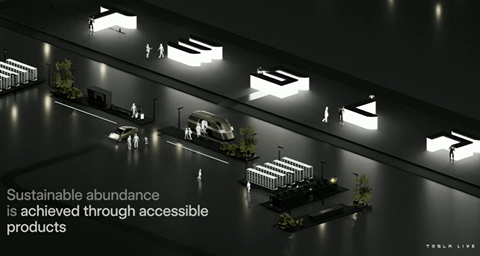

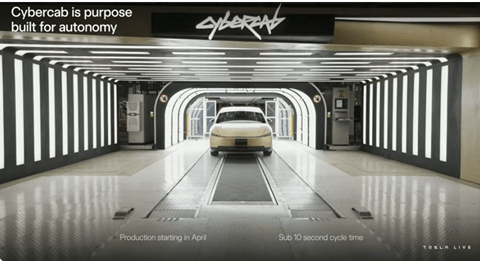

ロボティックスのもう一つの基軸はロボタクシーで、テスラは「サイバーキャブ(Cybercab)」(下の写真)の開発を進めている。サイバーキャブは次世代EVをベースとし、完全自動運転のクルマとなる。クルマはステアリングやペダルは備えてなく、最初から人間の介在を必要としないレベル4の完全自動運転車としてデザインされている。テスラはこれを消費者向けに販売するとともに、タクシーとして運行するネットワークを導入する。サイバーキャブの価格は3万ドルで、製造は2026年4月からギガ・テキサスで開始される。

| 出典: Tesla Optimus |

テスラはフィジカルAI企業

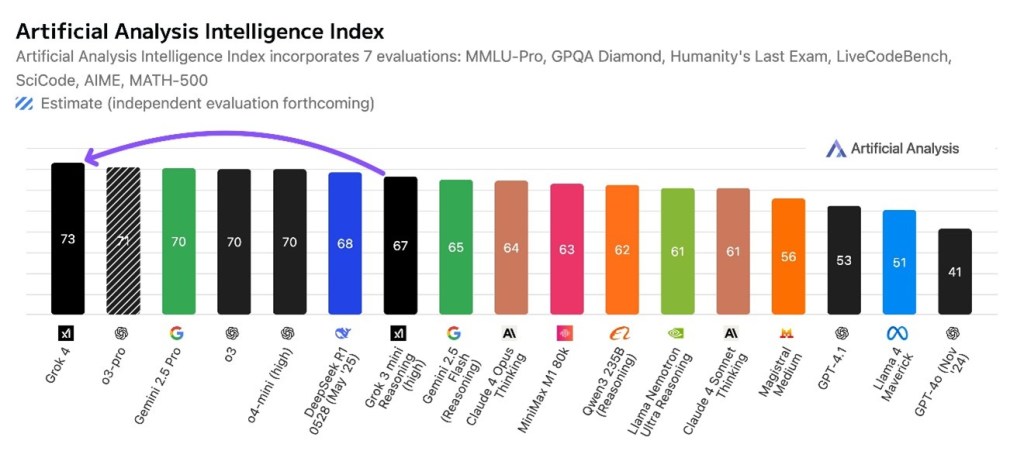

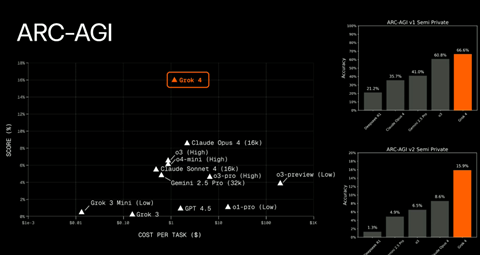

テスラのコア事業はロボティックスでヒューマノイド・ロボットとサイバーキャブが両輪となる。(先頭の写真、テスラのショールームで「オプティマス」と「サイバーキャブ」の販売が始まる) マスクはテスラの企業価値の80%をヒューマノイド・ロボットが生み出すと述べており、自動車産業の次の巨大産業となる。テスラは配下でAI企業xAIを運営しており、最新のAIモデルがヒューマノイド・ロボットとロボタクシーに搭載される。テスラは他のAI企業とは異なり、物理社会でインテリジェンスを生み出すフィジカルAIがコア事業となる。