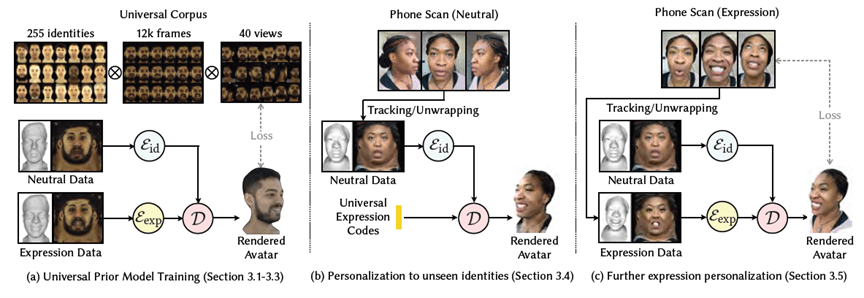

OpenAIが開発した「DALL·E 2」は、言葉の指示に従ってイメージを生成するAIである。OpenAIは、先週、DALL·E 2の販売を開始することを発表し、企業や個人はこれを有償で使うことができる。この発表を契機に、DALL·E 2が生成するイメージの法的解釈に関する議論が始まった。DALL·E 2は、著名芸術家のタッチを踏襲し、人気キャラクターのイメージを生成するが、これらは著作権の侵害なのか、議論が白熱している。AIアートの法的な位置づけが問われている。 (下の写真、DALL·E 2が制作した葛飾北斎の富嶽三十六景の「神奈川沖浪裏」で、オリジナルの作品をズームアウトした構成となっている。)

| 出典: OpenAI |

DALL·E 2の機能

DALL·E 2はイメージを生成するAIモデルで、テキストの指示に従って画像を出力する。例えば、人気アニメの「シンプソン(Homer Simpson)がビットコインの暴落に驚く様子」 (下の写真左側)や、人気ゲームの「マリオ(Marion)がピーチ(Princess Peach)と離婚手続きを進めているシーン」 (右側)など、DALL·E 2は架空の世界を高精度で描き出す。

| 出典: OpenAI |

アルゴリズムの教育

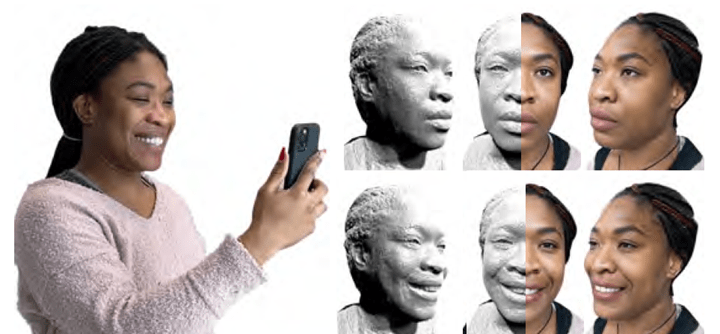

DALL·E 2は、イメージとテキストの対で教育され、言葉と画像の関係を学習した。これらイメージとテキストはインターネットから収集し、この作業はスクレイピング(Scraping)と呼ばれる。OpenAIは、6億5000万対のイメージとテキストをスクレイピングし、これらを使ってDALL·E 2のアルゴリズムを教育した。暴力シーンなど有害なコンテンツは削除されているが、ここには商標や著作権で保護されているイメージが含まれている。

| 出典: OpenAI |

(上の写真、DALL·E 2は、レオナルド・ダ・ヴィンチ(Leonardo da Vinci)が描いた「モナ・リザ(Mona Lisa)」(左側)とヨハネス・フェルメール(Johannes Vermeer)が制作した「真珠の耳飾りの少女(Girl with a Pearl Earring)」のオリジナル作品をズームアウトしたイメージを生成した。モナ・リザは湖を背景に立ち、少女は掃除中であることが分かる。)

OpenAIの著作権に関する見解

OpenAIは、商標や著作権で保護されているデータでDALL·E 2を教育したが、DALL·E 2が生成するイメージは著作権を侵害していない、とのポジションを取る。AIを著作物で教育することは「フェアユース(Fair Use)」であり、法律上許容される利用法であるとの見解を示している。フェアユースとは、著作物の一部を引用するケースで、DALL·E 2の教育はこれに当たるとしている。一方、DALL·E 2が著作物の複製を生成するなど、著作権を侵害するケースが発生した場合は、著作者と話し合うとのポジションを取っている。

| 出典: OpenAI |

(上の写真、DALL·E 2が制作した映画キャラクター「ミニオンズ(Minions)」(左側)と「きかんしゃトーマス(Thomas & Friends)」のレントゲン写真(右側)。)

業界の解釈

米国では、商標や著作権で保護されているデータでニューラルネットワークを教育することは違法ではない、との解釈が一般的である。企業や大学は、インターネット上のテキストやイメージをダウンロードし、これでアルゴリズムを教育するが、開発されたAIが著作権を侵害しているとの判例や事例は無い。このため、商標や著作権で保護されているデータを使ったアルゴリズム教育が容認されている。

AI教育に関する議論

しかし、高度なAIが開発されるにつれ、この慣習の妥当性が議論されている。MicrosoftはプログラミングできるAI「Copilot」を開発した。Copilotは言語モデル「GPT-3」で構成され、GitHubに公開されているコードで教育された。エンジニアに代わりAIがプログラミングするため、生産性が上がり注目を集めている。しかし、Copilotは教育されたコードを出力し、著作権に関する議論が始まった。

| 出典: OpenAI |

(上の写真、DALL·E 2は「古代エジプトの王妃がテキストメッセージを送信」しているシーンや、英国の人気キャラクター「くまのパディントン(Paddington Bear)が雨のプラットフォームに立っている」状況を描き出す。)

AI教育に関する裁判

米国では、AI教育データの利用はフェアユースに該当するとの解釈が一般的であるが、明確な判例があるわけでは無い。いまこの状況が変わろうとしている。リトアニアのソフトウェア企業Planner 5Dは、Metaなどを、著作権侵害で被害を受けたとして提訴した。MetaはPlanner 5Dが開発した3Dモデルを使ってAIを教育し、空間を移動しオブジェクトを認識できるアルゴリズムを開発した。この裁判は2023年3月から開始される予定で、AI教育データに関するフェアユースの解釈に、法的な判定が下されることになる。

著作者の保護

この議論の背景には、DALL·E 2は著作物で教育され、生成されたイメージがビジネスで使われ、クリエーターの職が脅かされることにある。著作物を無料で利用し、教育されたAIを有償で提供することに対する不合理性がある。AIアートだけでなく、AI言語モデルなどが含まれ、今まで曖昧になっていた慣習に光が当たることになる。