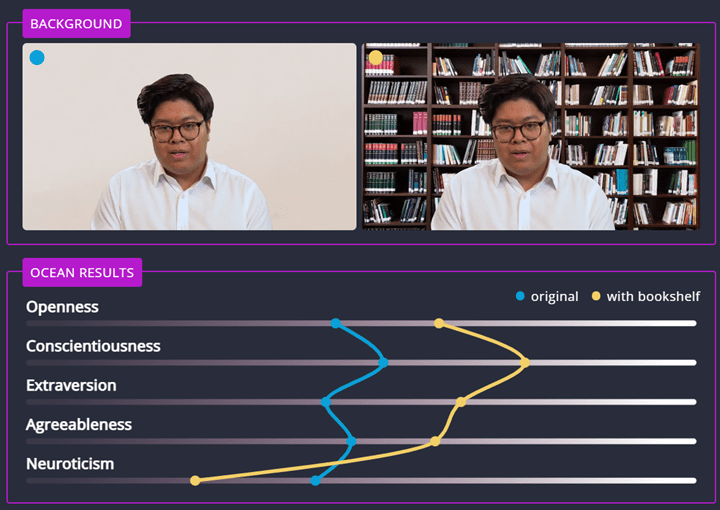

顔認識AIを開発している新興企業Clearviewは、1000億枚の顔写真を収集する計画であることが明らかになった。写真は顔認識AIのデータベースに格納され、被験者を特定するためのインデックスとして使われる。世界の人口は約79億人で、一人につき12枚の写真が収集される勘定になる。このAIを使うと、世界の全ての人物の身元を特定することができる。

| 出典: Clearview |

顔認識AIの開発

このAIを開発しているのはClearviewという新興企業で、世界最大規模の顔データベースの構築を計画している。投資家向けの資料がネットに流出したことで明らかになった。この資料によると、Clearviewは、現在、100億枚の顔写真を格納したデータベースを運営している。これを、1000億枚に拡充するために、資金の調達を進めている。

データベースの規模と判定精度

この規模のデータベースを使うと、AIは顔写真から、世界の殆どの人物の身元を正確に特定できる。具体的には、世界の人口の98%を、99.5%の精度で判定することができる。現在、Clearviewは100億枚の顔写真を格納したデータベースを運用しており、カバー範囲は75%となる。1000億枚の顔写真を使うと、世界の殆どの人を特定できる顔認識AIが生まれる。

利用目的

Clearviewは高精度な顔認識AIを開発し、米国政府を中心に、治安維持を目的に使われている。Clearviewの顔認識精度は、他の製品に比べひときわ高く、犯罪捜査で顔写真から容疑者の身元を特定するために使われる。昨年の米国連邦議会襲撃事件では、900超の顔写真をClearviewで解析し、350人の身元を特定することができた。このシステムは、FBI(連邦捜査局)や国土安全保障省などで使われている。

| 出典: Clearview |

ベンチマーク結果

Clearviewは世界でトップレベルの性能を持っている。米国では、NIST(国立標準技術研究所)が顔認識AIのベンチマーク結果を公開しており、世界のベンダーの判定精度を知ることができる。これによると、中国Sensetimeがトップで、Clearviewは二位の判定精度となる。しかし、Clearviewは、Sensetimeより大きなデータベースを持ち、実効性能で上回るとしている。因みに、第三位はロシアVisionLabsで四位もロシアNTechLabとなる。

データベースの規模

世界でトップレベルの判定精度を持つClearviewであるが、その開発手法が社会問題となっている。AIが被疑者の写真から本人の身元を特定するためには、解析した写真と同一の人物を、データベースから見つけ出す。このため、データベースの規模が大きいほど、マッチングの確度が上がる。

データ収集の手法

Clearviewは世界のウェブから顔写真を収集する手法でデータベースを開発してきた。Facebookなどソーシャルネットワークに掲載されている顔写真を、本人の許可なくダウンロードし、これをデータベースに格納する。これは、スクレ―ピングという手法で、個人のプライバシーを侵害するとして、米国社会で問題視されている。実際に、全米各地で集団訴訟が起こり、Clearviewの手法は法廷で問われることになる。

ビジネスモデル

Clearviewの顔認識AIは、治安当局による犯罪捜査で使われている。Clearviewは、データベースの規模を10倍に拡大するとともに、顔認識AIの新しいビジネスモデルを計画している。対象を政府官庁から企業に拡大し、顔認識AIで、セキュリティや顧客サービスなどのソリューションを開発する。特に、金融機関やギグ・エコノミー(Gig Economy)向けを重点分野とし、事業開発を進める。

| 出典: Clearview |

金融機関向けソリューション

Clearviewは顔認識AIを金融機関向けに提供することを計画している。これは、マネーロンダリングを検知するためのソリューションで、顔認識AIで利用者が犯罪者リストに登録されているかどうかを検知する。これは「One-to-Many Analysis」と呼ばれる手法で、利用者の顔写真でデータベースを検索し、身元を特定する。偽名を使った犯罪行為を検知できる。

ギグ・エコノミー向けソリューション

Clearviewはギグ・エコノミー向け顔認識AIに対する需要が大きくなると予想している。ギグ・エコノミーとは、ネットを通じた雇用制度で、契約社員として単発で働く方式を指す。Uberなどのライドシェアがギグ・エコノミーの代表となる。企業側はギグ・ワーカーを採用する際に、顔写真を顔認識AIで解析し、過去の履歴を確認する。この他に、Walmartなど小売店舗は、万引き防止のために、顔認識AIで容疑者の身元を特定するなどの活用法が検討されている。

| 出典: Clearview |

治安維持かプライバシー保護か

米国ではサンフランシスコなど主要都市が顔認識技術の使用を禁止したが、連邦政府レベルではこれを規制する法令は無い。顔認識技術の利用について、統一したガイドラインは無く、運用の可否は各政府機関に任されている。顔認識技術を提供するAmazon、IBM、Microsoft、Googleは、無用の混乱に巻き込まれるのを恐れ、自主的にビジネスを停止している。Clearviewは、独自の解釈で、顔認識AIを提供する方針を貫いている。高精度な顔認識AIが犯罪捜査に寄与し、社会の治安が保たれていることは事実である。一方、Clearviewは、個人の顔写真を無断で使っており、これがプライバシー侵害に該当するのか、法廷で審理が進んでいる。