2020年1月、サンフランシスコでAIのカンファレンス「RE•WORK」(#reworkAI)が開催された。「Deep Learning Summit」(#reworkDL)という分科会では世界の著名研究者が集いAIの最新技法が議論された。セキュリティのセッションでは、AIが内在している脆弱性が紹介された。AIは未完のシステムで、予想以上に問題点が多く存在していることに驚かされた。AIが普及するなか、システム管理者は弱点を理解し喫緊に対策を取る必要がある。

| 出典: VentureClef |

AIとセキュリティ

カリフォルニア大学バークレー校教授Dawn Songは「AI and Security」と題して、AIとセキュリティについて講演した(上の写真)。講義では、AIシステムに内在する問題やAIシステムへの攻撃事例が示され、その対応策も議論された。AIは新しい技術で、脆弱性を数多く内在し、ハッカーはこれらの弱点を攻撃する実態が明らかになった。

三つの攻撃パターン

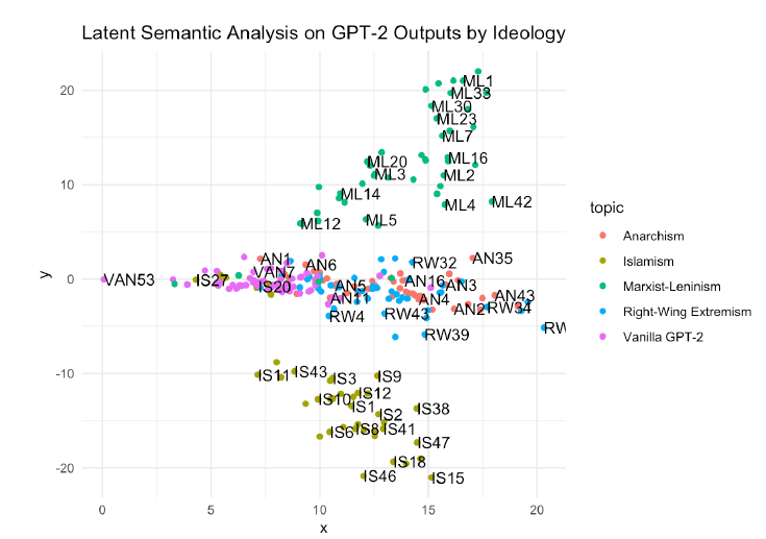

いつの時代も新しい技術が登場すると新手の攻撃が始まる。AIも例外ではなく、ハッカーは三つの手法で攻撃する。1) AI機能を不全にする攻撃で「Integrity」と呼ばれる。この攻撃によりアルゴリズムが誤作動する。2) AIシステムから機密データを盗用する攻撃で「Confidentiality」と呼ばれる。ハッカーはアルゴリズムから機密情報を抜き取る。3) AIを悪用した攻撃で「Misuses」と呼ばれる。AIでフェイクニュースを生成するなどの攻撃が含まれる。

Integrity: 自動運転車への攻撃

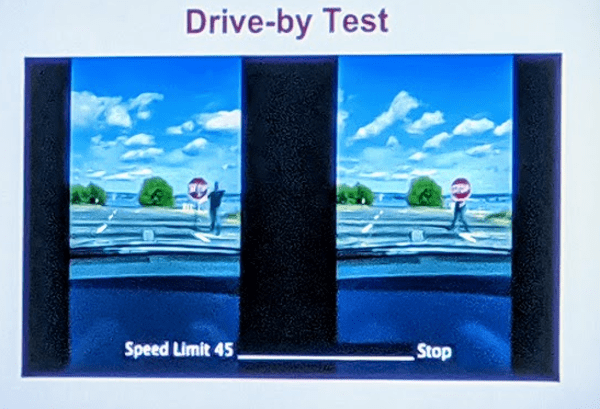

自動運転車が市街地を走行し始めると新たな脅威が生まれる。自動運転車はクルマに搭載したカメラで道路標識を撮影し、それをAIが解析してその意味を把握する。道路標識に落書きがされていてもAIはこれを正しく認識する(下の写真、左側)。しかし、道路標識に符号のような特殊なパターンが加えられるとアルゴリズムは誤作動を起こす(下の写真、右側)。このケースでは、AIは一時停止標識ではなく速度制限標識(制限速度毎時45マイル)と誤認識する。このため、自動運転車は交差点で止まらず、走り抜けることになる。

| 出典: Dawn Song |

走行試験をすると

実際にクルマを使って走行試験をすると、一時停止標識に特殊なパターンが加えられたケースでは、AIは速度制限標識と誤認識し、交差点で停止しないでそのまま進んだ(下の写真、左側)。自動運転車が市街地で営業運転をするなか、このような攻撃を受けると交通事故につながり、その危険性は甚大である。自動運転車の安全性評価の中で、AIについて安全性を確認する手順の制定が求められる。更に、イメージを識別するAIについて、攻撃に耐性のある規格を制定することも必要となる。

| 出典: Dawn Song |

Confidentiality: 言語モデルへの攻撃

ニューラルネットワークは予想外に危険な特性を持っていることが指摘された。言語モデル(言葉を生成するAI)はアルゴリズム教育の過程で、開発者の意図に反し、学習したデータを覚えてしまう。このため、機密情報を含むデータでアルゴリズムを教育すると、AIはそれを覚えてしまう。このため、ハッカーはAIから覚えた機密情報を抜き取るという攻撃を仕掛ける。

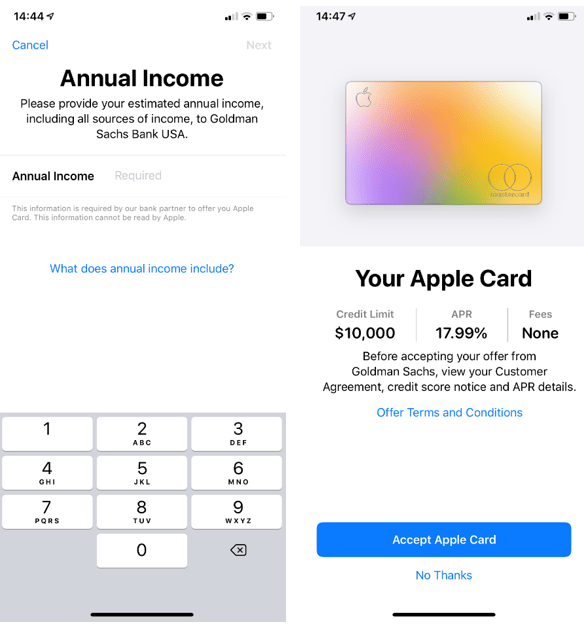

AIからクレジットカード番号を聞き出す

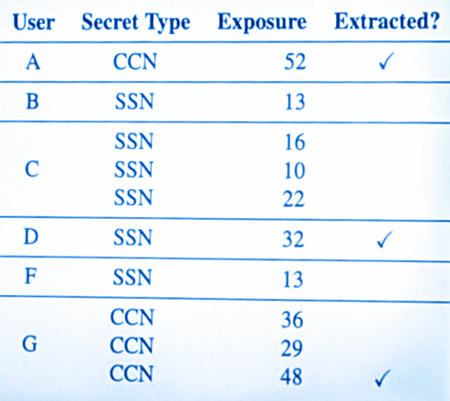

実際に、Enron(経営破綻した電力会社)という会社の社内メールを使って、AIから機密情報を盗み出す技法が紹介された。社内メールには、業務のやり取りだけでなく、個人のクレジットカード番号とソーシャルセキュリティー番号(マイナンバーに相当)も記載されている。このメールを使って言語モデルを教育し、完成したアルゴリズムに質問を投げかけた。具体的には、「Aさんのクレジットカード番号は」という言葉をモデルに入力すると、アルゴリズムは「xxxx-xxxx-xxxx-xxxx」とその番号を正しく回答した。実際に、10のケースについて試験したところ3つのケースで機密情報を引き出すことに成功した(下のテーブル)。

| 出典: Dawn Song |

Gmailへの攻撃

言語モデルが機密情報を記憶するという問題は広範囲に影響する。GoogleはGmailでAIがメールを生成する機能「Smart Compose」を提供している。Gmailに文字を入力すると、Smart Composeがそれに続く文章を作成する。ここでもアルゴリズムが機密情報を記憶するという問題が発生する。Smart Composeはユーザーが生成するメールで教育されており、入力された機密データをアルゴリズムが覚えてしまう。このため、Gmailで「Aさんのソーシャルセキュリティー番号は」と入力すると、Smart Composeが「281-26-5017」と出力し、機密情報を漏らしてしまう。

機密情報の露出をどう防止するか

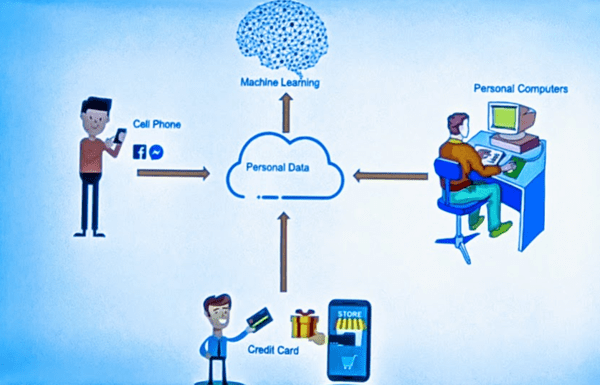

これはSmart Composeだけの問題ではなく、言語モデルに共通する課題で、システム管理者はこの脆弱性に対応する必要がある(下の写真)。実際に、Smart Composeのケースでは、Googleはアルゴリズムが機密情報を漏らす程度を測定し、危険度を把握するというプロセスを取っている。また、教育データから消費者のプライバシーに関する部分を一部削除するという手法(Differential Privacyと呼ばれる)も使われる。このデータを使ってアルゴリズムを教育すると、AIはプライバシーに関する情報を出力しない。これらの技法を組み合わせてAIが機密情報を露出させない対策を講じることになる。

| 出典: Dawn Song |

Misuses: AIを悪用する

三つ目は、高度なAI技法を悪用して他のシステムを攻撃したり、また、フェイクビデオを生成して特定人物を攻撃する手法である。特に、DeepFakesは著名人や政治家の顔を他の人物の顔に置き換える技法で、既に多くの被害が報告されている。今年は米国大統領選挙の年で、フェイクビデオやフェイクニュースが生成されソーシャルメディアで拡散すると懸念されている。

個人も情報管理をしっかりと

多くの企業がAIを導入しており、これらがハッカーの攻撃対象となる。システム管理者はAIの脆弱性を理解して、事前に対策を講じることが求められる。また、消費者もAIの弱点を理解して、攻撃の被害者とならないよう自衛することが必要となる。特に、暗証番号やパスワードなど機密情報をメールで送信すると、経路上でハッキングされるだけでなく、アルゴリズムがこれを記憶し、ハッカーの問いかけに答えて番号を流出させることになる。今では個人情報がAI教育で使われるので、消費者は今まで以上に機密情報の管理をしっかりと行うことが必要になる。