Googleは仮想アシスタントが電話して実社会のタスクを実行する技術「Google Duplex」を公開した。Duplexは人間のように会話できるAIで、例えば、ヘアサロンの店員さんと話してヘアカットの予約をする。話し方があまりにも人間的で、マシンとは到底区別がつかない。Duplexは究極の仮想アシスタントと評価される一方で、人間的過ぎるAIは社会で許容されるのか、波紋が広がっている。

| 出典: Google |

Google開発者会議

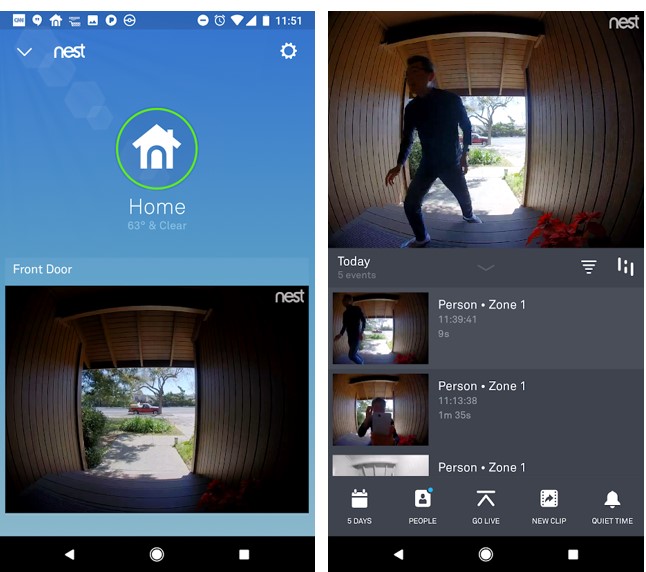

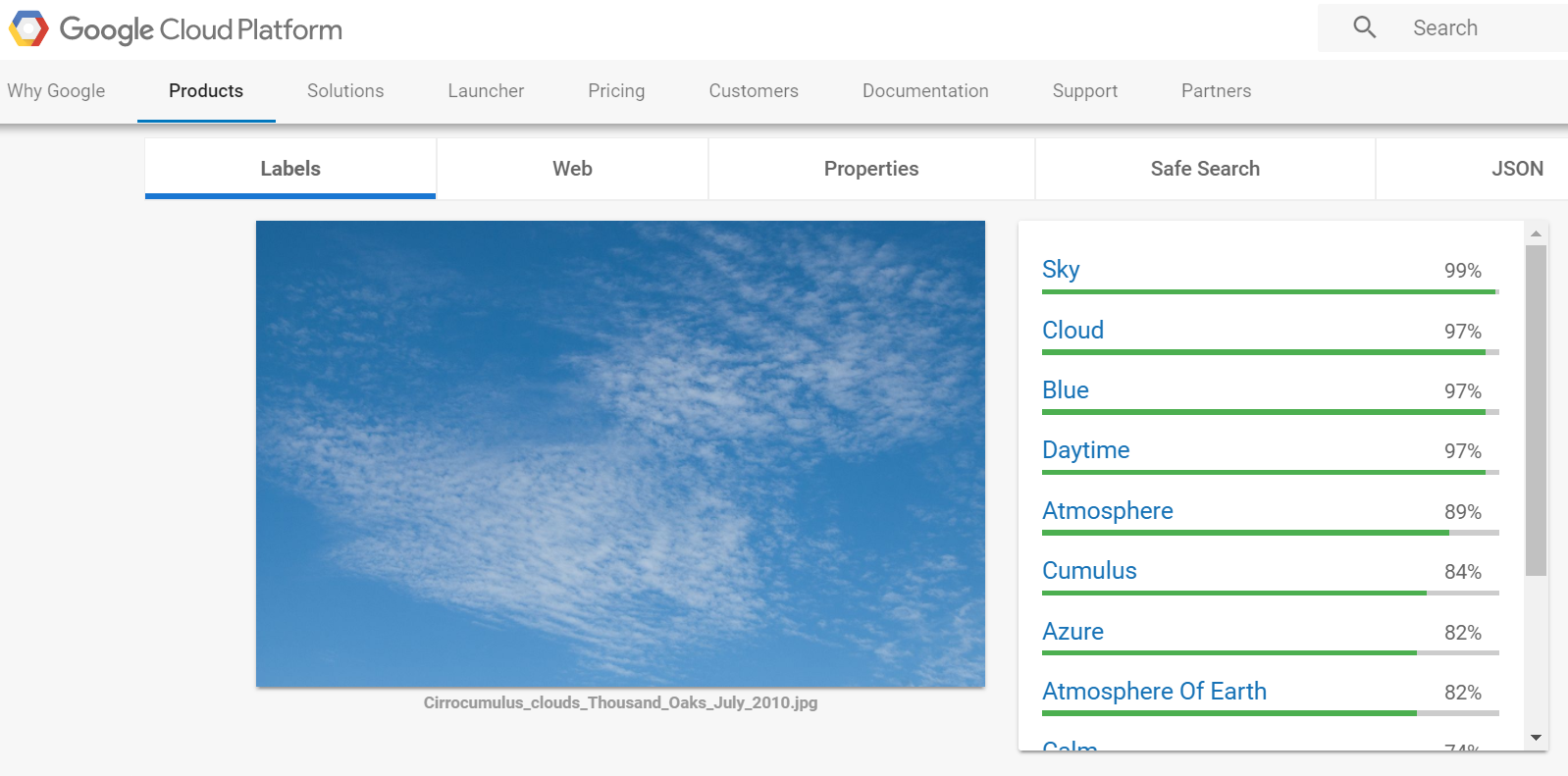

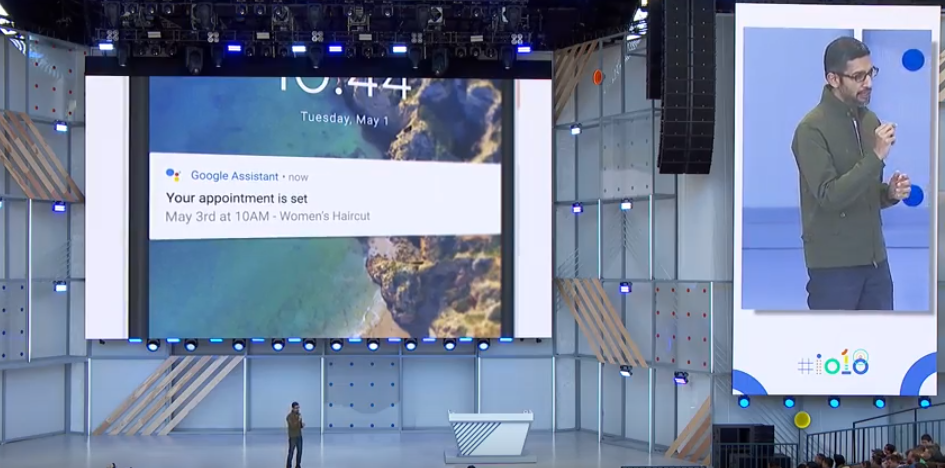

Googleは2018年5月8日、開発者会議Google I/OでAIやAndroidの最新技術を発表した。「Google AI」というブランドのもとAI企業に舵を切り、仮想アシスタント「Google Assistant」やAIスピーカー「Google Home」の最新技術を公開した (上の写真)。この中で、人間に代わり仮想アシスタントが電話で会話して実社会のタスクを実行する技術Google Duplexを公開した。

Duplexがヘアカットを予約

Google CEOのSundar PichaiがDuplexのデモを行った。Duplexがヘアサロンに電話して、ヘアカットを予約するというストーリーで、会話は次の通り進んだ。

Duplex:(ヘアサロンに電話を発信)

ヘアサロン店員:Hello, may I help you?

Duplex:I’m calling to book a women’s haircut for a client. Umm, I am looking for something on May 3rd. (若い女性のテンポよい会話で到底AIとは思えない)

ヘアサロン店員: Just give me one second. (店員は予約表を見ている様子)

Duplex: Mm-hmm。(Yesと言わないで”ふふーん”という繋ぎ言葉(Disfluencies)が入り、ますます人間の雰囲気を醸し出す)

| 出典: Google |

Duplexが予約時間をネゴ

しかし、リクエストした時間が空いてなく、両者の間で協議が始まる。

ヘアサロン店員: Depending on what service she would like. What service is she looking for?

Duplex: Just a women’s haircut for now.

ヘアサロン店員: Okay, we have a 10 o’clock.

Duplex: 10am is fine.

どんなメニューを希望しているかの問いに対して、Duplexは女性のヘアカットと回答。カットだけなら10時が空いているとのことで予約が完了した。Duplexはヘアサロン店員と予約時間を調整するという複雑なタスクを完遂した。

Duplexを人間と感じる理由

Duplexを人間と感じる理由は、人間の悪い癖であるDisfluencies (“えーと”など意味のない繋ぎ言葉) を取り入れていることと、会話の間合いが絶妙であること。更に、Duplexは想定外の事態に対応して複雑なタスクを実行でき、人間と全く変わらない。Duplexデモの部分は基調講演ビデオ (https://youtu.be/ogfYd705cRs?t=2174)で見ることができる。

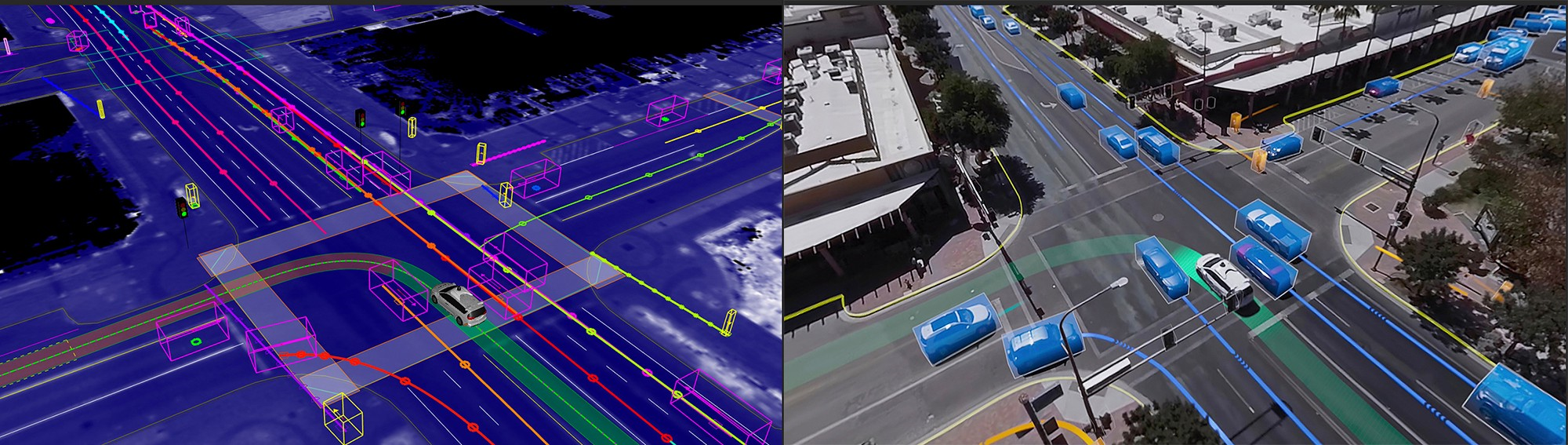

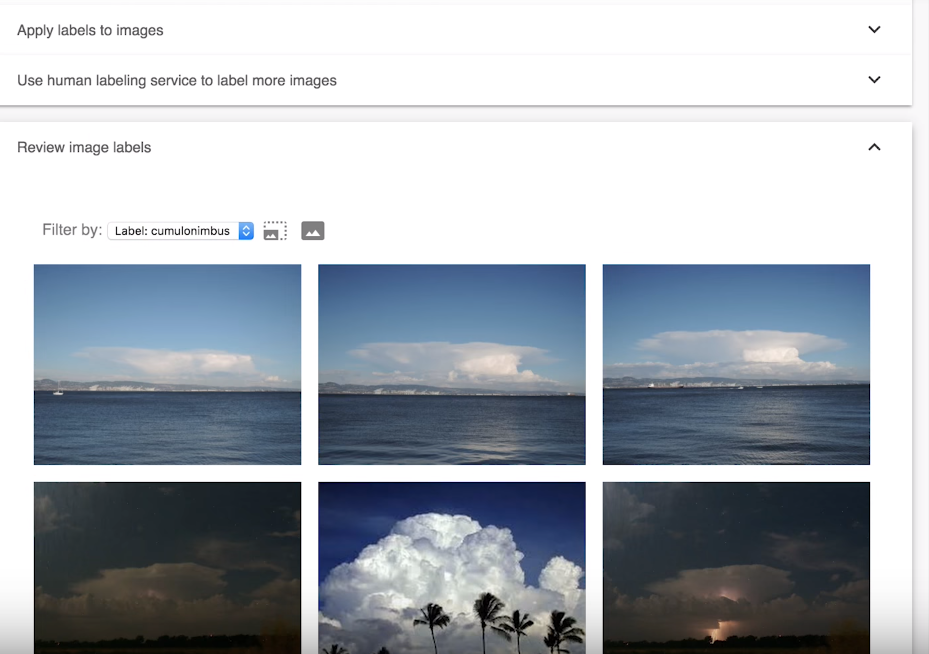

Duplexのシステム構成

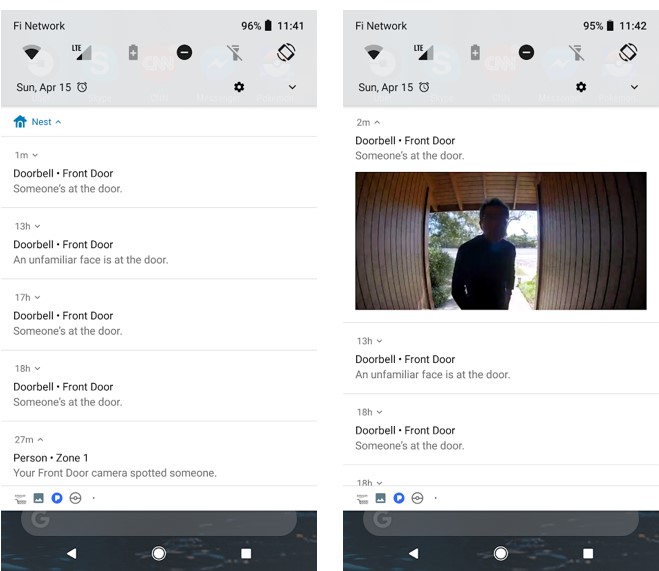

DuplexはGoogle Assistantのバックエンド機能として実装される。Google Assistantにヘアサロンの予約を指示すると、その背後でDuplexがこれを実行する (下の写真)。実際に、Duplexが店舗に電話を発信し、相手と対話しながらヘアカットの予約を入れる。予約が済むとその内容はGoogle Assistantから利用者に示される (最後の写真)。予約時間が近づくと、Google Assistantはスマホにリマインダーを表示する。

| 出典: Google |

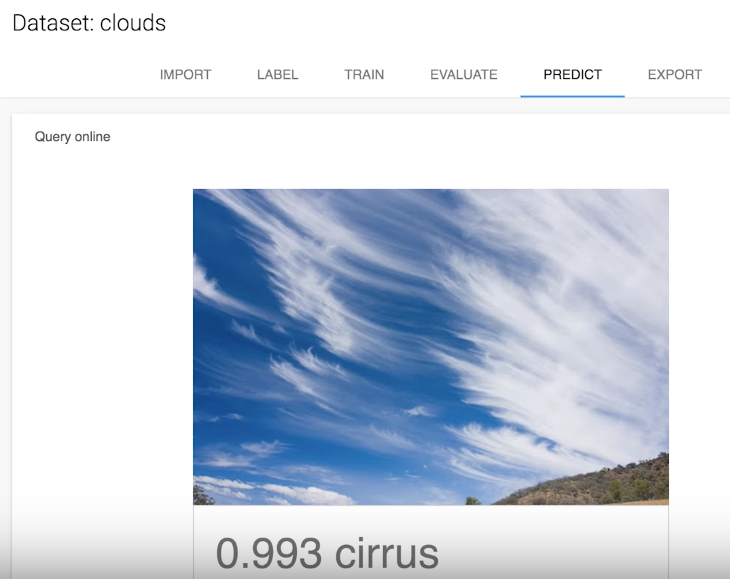

コンセプト

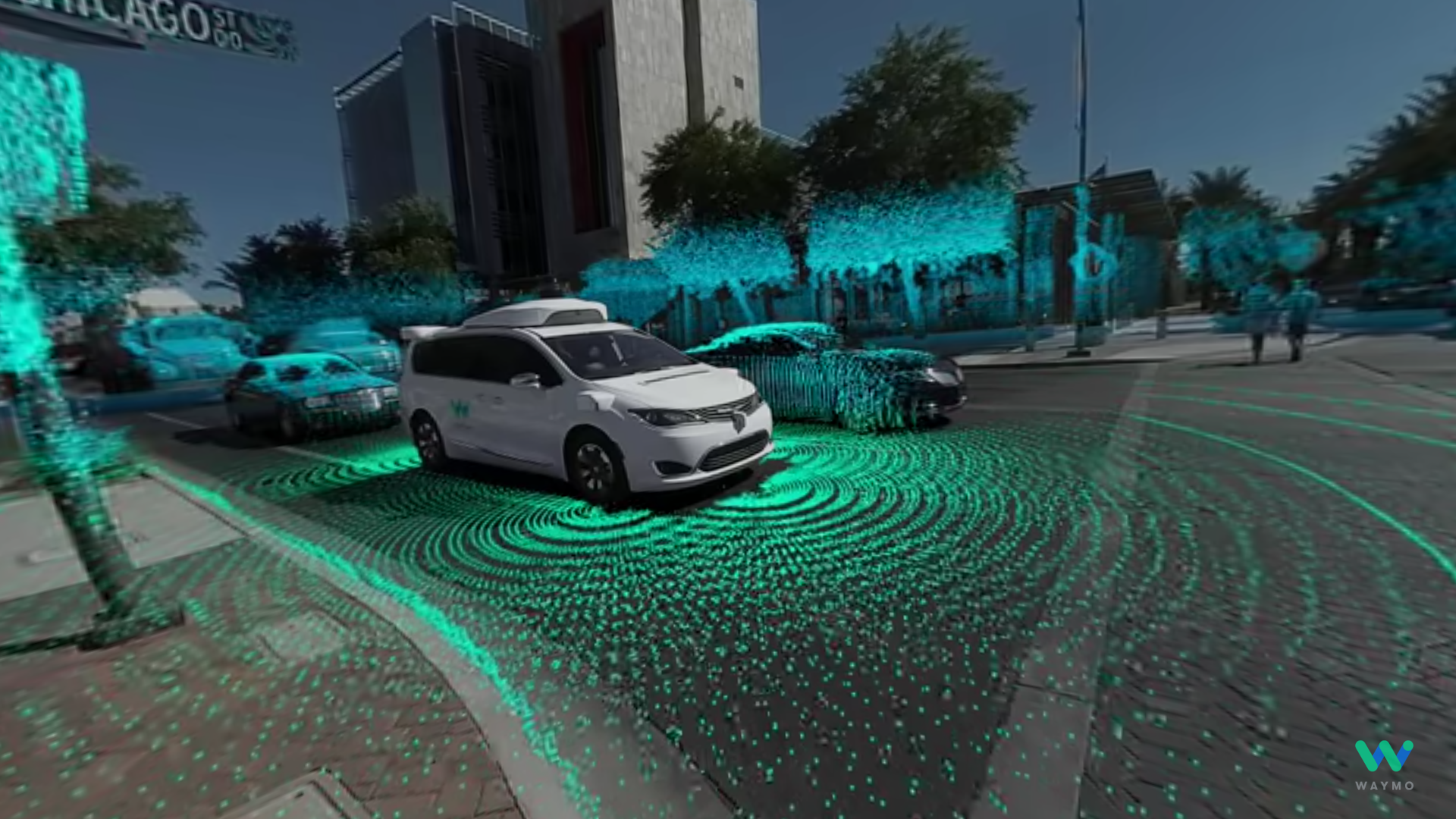

Duplexは自然な会話を通してタスクを実行するようデザインされている。Duplexの会話は人間と同じレベルで、自然で滑らかなトーンで進み、AIであることを感じさせない。従って、利用者は人間と会話するように、自然な言葉づかいで会話する。AIスピーカーに語り掛けるときは、分かりやすくゆっくりと喋るが、早口で言い直しながら話してもDuplexはちゃんと理解する。つまり、Duplexは人間と同じ位置づけで、普段通りの言葉で会話ができる。

| 出典: Google |

市場の反応は割れる

Duplexの会話は人間そのもので、マシンとは全く判別できない。デモを実施した会場からは驚きのどよめきが上がった。一方、市場の反応は分かれ、技術進化を評価するものの、Duplexに対して懸念の声も上がっている。Duplexは社会のモラルから逸脱しているとの意見も少なくない。電話を受けたヘアサロン店員は、人間と思い丁寧に対応したが、実は相手はAIであり、欺かれた感覚を覚える。

電話詐欺や選挙運動

更に、Duplexが悪用されると犯罪の手助けをするのではと懸念されている。米国で電話詐欺により高齢者が被害にあう事件が後を絶たない。電話詐欺でDuplexが悪用されると、大量の被害者が出ることが懸念される。日本語対応のDuplexが登場すると、オレオレ詐欺で悪用される可能性も生まれる。更に、次期大統領選挙でDuplexが悪用されると、再び世論が操作される心配が募る。

Googleの対応策

Googleはこれらの懸念に対して明確な対策は公表していないが、「Transparency」な方針で開発を進めるとしている。Duplexが電話を発信するときは、最初に素性を明らかにし、「自分はDuplexで○○○さんのために電話している」などのコメントが付加されるものと思われる。また、Duplexとの会話を録音する時は、事前に相手の了承を取ることも必要となる。

究極の仮想アシスタント

市場では仮想アシスタントをここまで人間に近づける必要があるのか、議論が始まった。AIが人間ではないことを明らかにするために、機械的な会話に留まるべきだという意見もある。一方、Duplexのデモを見た後で、Google Assistantのいつもの声を聞くと、なぜかモノトーンでフラットに感じる。Duplexのほうに親近感を覚える。AIだと分かっていても、人間臭く感情をこめて語ってくれると、会話がしっくりする。これが究極の仮想アシスタントで、話しぶりに惹かれてしまうが、危険と隣り合わせの状態でもあることも認識しておく必要がある。