Appleは6月10日、開発者会議「WWDC 2024」でAI技術「Apple Intelligence」を発表し、生成AI市場に参入した。Apple Intelligenceは独自に開発した生成AIで、基本ソフトやアプリと連携し、テキストやイメージを生成する。Apple Intelligenceは二種類の生成AIモデルで構成され、オンデバイス(iPhoneなど)とサーバ(クラウド)で稼働する形態となる。これらのモデルは、安全にかつ効率的に動作するアーキテクチャとなっている。サーバサイドの言語モデルは、セキュアなクラウド「Private Cloud Compute」で運用され、個人情報を厳格に管理する。AppleはOpenAIと提携し、ChatGPTを基本ソフトに統合することを明らかにしたが、この機能は最小限に留め、自社のAI技術を全面に押し出したシステム構成となっている。

| 出典: Apple |

Apple Intelligenceとは

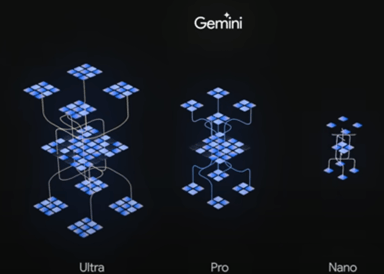

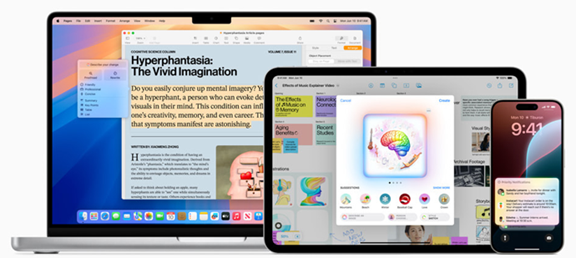

Appleは「Apple Intelligence」を「Personal Intelligence」と定義し、iPhone、iPad、Macで稼働し、個人のスーパーアシスタントとなる。Apple Intelligenceは、生成AIをコア技術とし、個人情報と組み合わせることで、利用者に特化したインテリジェントな機能を実現した。Apple Intelligenceは、テキストやイメージを生成し、また、Siriが大幅に機能アップされ、複雑なタスクを実行できるようになった。

| 出典: Apple |

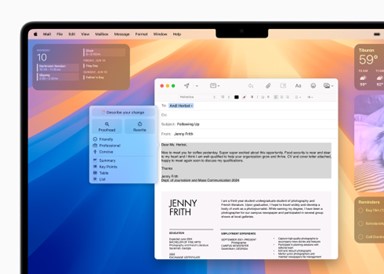

Writing Tools:テキスト生成機能

Apple Intelligenceの主要機能がテキストを生成するツール「Writing Tools」となる(下の写真)。Writing Toolsは文章作成において、文法をチェックし、また、生成したレポートを特定のトーンに変更する機能を持つ。更に、レポートを要約し、そのポイントを提示する機能もある。

| 出典: Apple |

Genmoji:イメージ生成機能

「Genmoji」は絵文字を生成するツールで、テキストを入力すると、それに沿ったイメージが生成される。これは生成AIのイメージ生成機能であるが、プロンプトを入力する代わりに、テーマを選択することで簡便に絵文字やスティッカーを生成できる。入力するテキストを最小限に留め使いやすさを強調している。例えば、「猫」、「パーティ」、「シェフ」というアイコンを選択すると、猫のシェフが生成される(下の写真左側)。生成したイメージをメッセージに張り付けて利用する(中央と右側)。

| 出典: Apple |

Enhanced Siri:アシスタント機能を強化

Siriは13年前に投入されたAIアシスタントであるが、Apple Intelligenceで機能が格段に強化された。Siriは言葉を理解する能力が向上し、複雑なタスクを実行できるようになった。Siriはデバイス内の個人情報を読み込み、アプリケーションを跨り、アクションを実行する。例えば、「母のフライトの到着時間は?」と質問すると、Siriは母やフライトや到着時間という意味を理解し、受信したメッセージをを検索し、到着時間を表示する(下の写真中央)。また、夕食の予定を尋ねると、そのメッセージを表示する(右側)。デザインが一新され、Siriを起動するとスクリーンの枠がフラッシュする。また、テキストでの入力が可能となった(左側)。

| 出典: Apple |

Apple Intelligenceの構造:複数の生成AIで構成

Apple Intelligenceは複数の生成AIで構成され、テキスト生成など日々の生活で使われる機能を提供する。生成AIはテキスト生成の他に、メッセージの要約、イメージの生成、アクションの実行など、日常生活で使う機能を実行するために開発され、これに特化したアーキテクチャとなっている。更に、生成AIは「アダプター」という機構を搭載し、実行時に、これらのタスクに特化したモデルに動的に変更できる構造となっている。

生成AIモデル:オンデバイスとサーバサイド

Apple Intelligenceのコア機能は、二種類の生成AIで構築される。生成AIはオンデバイス(モバイルデバイス)とサーバサイド(クラウド)で稼働する運用形態を取る。それぞれの機能は:

- オンデバイス(on-device language model):小型モデルで3Bのパラメータから構成される。iPhoneやiPadやMacで稼働する。限られたリソースで効率的に稼働する構造となっている。

- サーバサイド(server-based language model):データセンタで稼働するモデルで、専用クラウド「Private Cloud Compute」で運用される。個人情報保護を厳格に実行するため、クラウドはApple独自の半導体と基本ソフトで構成される。

生成AIモデルの開発:効率的に稼働できるアーキテクチャ

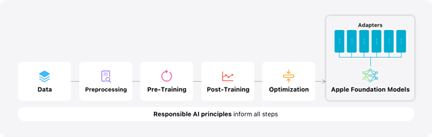

生成AIモデルは限られた資源で効率的に稼働できるよう、使われる機能に最適化したアーキテクチャとなっている。生成AI開発のプロセスは(下の写真):

- Pre-Training:生成AIモデルの一般教育。教育データを有償で入手。また、ウェブサイトの公開情報を教育データとして利用。

- Post-Training:一般教育が終わったモデルをチューニングして性能を向上。人間の判定のフィードバック(RLHF)や合成データでモデルを再教育。

- Optimization:完成した生成AIモデルを高速で効率的に実行できるよう最適化。

- Model Adaptation:単一モデルで異なるタスクを実行するためのアダプター。実行時に特定タスクの重み(Weight)をモデルに入力し、そのタスクを効率的に実行できるモデルに動的に変更(下の写真右端)。これにより小型モデルでもiPhone上でイメージの生成を効率的に実行できる。

| 出典: Apple |

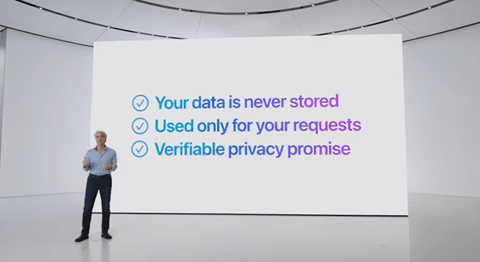

Private Cloud Compute:高度なセキュリティ

Apple Intelligenceは個人情報など機密データを安全に取り扱うため、オンデバイスでの処理を基本とする。個人情報はiPhoneなどのデバイスに留まりプライバシー保護を厳格に実行する。しかし、大規模な処理が必要な場合はセキュアなクラウド「Private Cloud Compute」でこの処理を実行する(下の写真)。Private Cloud ComputeはAIで個人情報を解析するための専用クラウドで、厳格なセキュリティに基づいて構成される。基本ソフトやプロセッサはAppleが独自で開発したものが使われ、サイバー攻撃を防御し個人情報を守る。

| 出典: Apple |

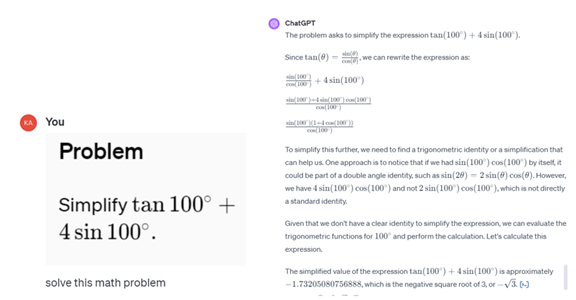

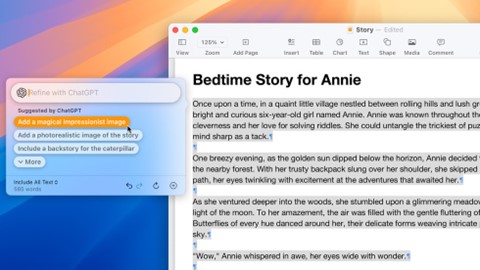

OpenAIとの提携:GPT-4oの機能を限定的に利用

Appleは独自のAI技術Apple Intelligenceに加え、OpenAIと提携し最新の生成AIを提供する戦略を取る。GPT-4oをiOSなどの基本ソフトに組み込み、Apple Intelligenceと並列で運用する。基本的なタスクはApple Intelligenceで実行し、高度なテキスト生成(下の写真)やイメージ生成でGPT-4oを利用する。AppleはOpenAIだけでなく、他社のAIを利用するポジションを取り、GoogleとGeminiに関する協議を進めていると報道されている。

| 出典: Apple |

市場の反応:Apple Intelligenceの評価が分かれる

米国市場のApple Intelligenceに関する評価は分かれており、失望したという声が聞かれる反面、Appleの将来に期待するという意見も多い。AppleはApple Intelligenceで生成AI市場に参入し、iPhoneなどの機能を大幅にアップグレードした。しかし、これらはベーシックな生成AIで、市場を驚かせるようなイノベーションはなく、先行企業を追随する形となった。同時に、AppleのAI戦略を理解し、これを評価する声も大きい。Appleは危険性を内包する生成AIを安全にデバイスに統合し、日々の生活に必要なエッセンシャルな機能を供給する。更に、レベルアップしたSiriを評価する意見も多く、米国消費者は賢いAIエージェントの登場を期待している。

| 出典: Apple |

AppleのAI戦略:機能より安全性を重視

Apple Intelligenceは小型軽量の生成AIで、利用する機能に最適化した効率的なモデルとなっている。オンデバイスで稼働させるため、機能性より実用性を重視したコンセプトとなっている。一方、オンデバイスで処理できないタスクに関しては、セキュアなクラウド「Private Cloud Compute」で実行する。クラウドはApple独自のプロセッサと基本ソフトで構成され、個人情報保護を徹底するアーキテクチャとなっている。

他社との連携

また、Appleは第三者の生成AIをシステムに組み込む計画を明らかにした。OpenAI ChatGPTの次はGoogle Geminiで、契約交渉を進めていると報道されている。ただ、生成AIの中心人物はApple Intelligenceで、他社の生成AIはこれを補完するかたちで提供する。Appleが生成AI市場に参入したことで、巨大テックすべてが出そろい、各社は自社の戦略に沿ってAI開発を加速することになる。