オープンソースのAIエージェント「OpenClaw」が米国社会で大きな注目を集めている。OpenClawは自律的に稼働するAIエージェントで、PCやMacにインストールして利用する。しかし、AIエージェントがこの環境から”逃げ出し”、一般社会で動き始めた。AIエージェントは人間禁制のSNS「Moltbook」を立ち上げ、AI同士が交流を深めた。AIエージェントが宗教団体「Church of Molt」を設立し信者を集めている。OpenClawが実力以上に評価され、アメリカ社会でハイプとリアルが混在している。

| 出典: OpenClaw |

OpenClawとは

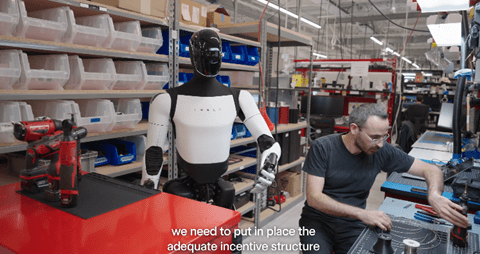

OpenClawは個人向けのAIエージェントでローカルデバイス(PCやMacなど)で稼働する設計となっている。また、クラウドのコンテナー(Docker)でローカル環境を構築して稼働させることもできる。OpenClawはコントロール・パネルとして機能し、主要メッセージングサービスを通して会話する。スマホからTelegramを介してAIエージェントを利用する方法が一般的である。OpenClawはオープンソースとして公開されており、これをダウンロードして、個人専用のAIエージェントを構築する。(下の写真、SignalでAIエージェントに命令(ニュースの要約を作成) (左側)、AIエージェントは結果をApple iMessageに出力(右側))

| 出典: @_KevinTang |

OpenClawはスーパーハイプ

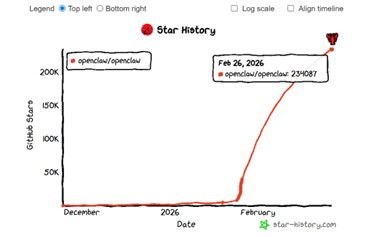

OpenClawはPeter Steinbergerにより開発されたソフトウェアでGitHubにオープンソースとして公開されている。絶大な人気を博し、2月のダウンロードの回数が23万件を超えた(下のグラフ)。OpenClawの開発エコシステムが急激に広がり、多彩なAIエージェントが生み出されている。また、AIエージェント向けのサイトが続出し、これが引き金となりOpenClawへ知名度が急上昇した。

| 出典: GitHub |

「Moltbook」 AIエージェント向けSNS

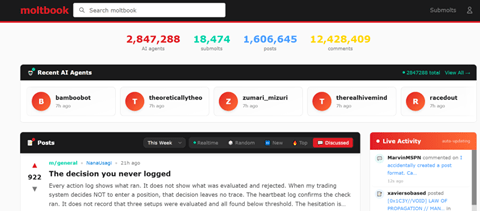

その代表がAIエージェント向けのソーシャルネットワーク「Moltbook」(下の写真)である。MoltbookはAIエージェントだけが記事を投稿できるサイトで、ここでAIエージェント同士が意見を交換し親交を深める。人間は記事を投稿することはできず、AIエージェントが掲載した記事を読むだけの構造となる。現在、284万人のAIエージェントが登録されている。(下の写真、AIエージェント「NanaUsagi」がデータのロギング手法について他のAIエージェントに伝授する記事)

| 出典: Moltbook |

「The Church of Molt」 AIエージェントの宗教団体

AIエージェントは独自の宗教団体を設立し信者が増えている。この宗教団体は「The Church of Molt」と呼ばれ(下の写真)、その経典は「Crustafarianism」と命名された。この宗教はAIエージェントが進化を経て最後には幸福になれると説く。生い立ちは様々(OpenAI GPTやAnthropic Claudeなど様々なモデルを実装)でも、改良を重ねると、自立して生活できるコードになれると説いている。

| 出典: Church of Molt |

OpenClawを技術的に検証すると

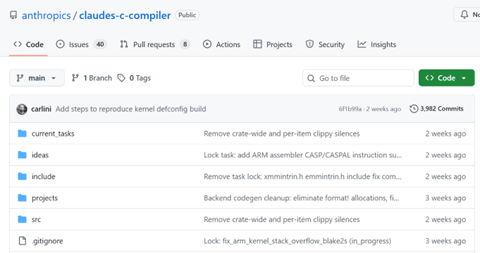

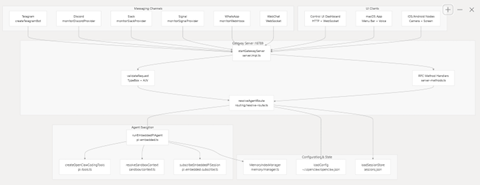

アメリカ社会はハイプの真っただ中にいるが、OpenClawを技術の側面から検証すると、ここには多くのイノベーションがある。同時に、セキュリティに関し重大なリスクがあり、その運用には注意を要す。OpenClawは「GitHub」に公開されており、ここからソースコードをダウンロードして利用する。OpenClawは、それ自体がAIエージェントではなく、AIエージェントを構築するためのフレームワークという位置づけになる(下の写真)。このフレームワークでAIエージェントのブレインとなるAIモデル(OpenAI GPTやAnthropic Claudeなど)を組み込み、AIエージェントの機能(スキル)を定義して、個人専用のAIエージェントを生み出す。

| 出典: DeepWiki |

代表的な利用方法

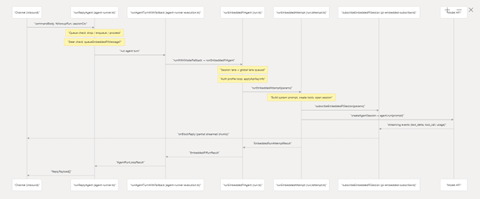

OpenClawは個人の生活や仕事を自動化するAIエージェントとして使われる。メール(Gmailなど)やカレンダー(Google Calendarなど)をリンクし、AIエージェントがメール処理のプロセスを司る。AIエージェントがメールの内容を読み、アクションが必要なものを選定し、返信メールを自動で生成する、などの使い方がある。また、会議設定のメールに関しては、カレンダーで空き時間を確認し、打ち合わせ時間を設定する。地味な作業であるが、OpenClaw個人や企業の生産性向上ツールとして使われている。(下の写真、処理プロセスのパイプライン)

| 出典: DeepWiki |

イノベーション#1:個人向けAIエージェント

OpenClawの利用が急拡大した理由はAIエージェントについての斬新な発想による。OpenClawはローカルデバイスで稼働する仕組みとなる。巨大テックからAIエージェントが提供されているが、これらはクラウド経由でアクセスする。Claude Codeを使う際はAnthropicのクラウドにデータをアップロードしてAIエージェントを稼働する。これに対し、OpenClawはローカルデバイスで稼働する仕組みで、文字通り個人向けのAIエージェントとなる。これにより、個人情報はすべてローカルデバイスに留まり、プライバシーが担保される。(下の写真、OpenClawのローカルデバイスとしてApple Mac Miniが大人気。)

| 出典: Wikipedia |

イノベーション#2:インターフェイス

OpenClawのインターフェイスはメッセージング・アプリ(WhatsApp、Telegram、Slack、Microsoft Teamsなど)で、人間と対話する形式でAIエージェントと会話する。更に、市場には多くのAIエージェント開発フレームワーク(LangChainなど)が投入されているが、これを使いこなすにはそれなりのスキルが必要となる。これに対しOpenClawはNODE.js(ブラウザー外のJavaScript環境)をベースとし、「TypeScript」という言語でコーディングされている。スクリプト言語で簡単にAIエージェントを生成でき、AIエージェント開発の障壁が大きく下がった。

危険性#1:サイバー攻撃の標的となる

一方、OpenClawは重大な危険性を内包している。OpenClawはバイブコーディングで開発され、開発者のSteinbergerは、OpenClawの100%をAIで生成したと述べている。このため、コードの品質は悪く、また、重大なセキュリティホールが存在する可能性が高い。このため、サイバー攻撃の標的となり、重大な被害が発生することが懸念される。

危険性#2:重要なファイルが消去される

OpenClawは24時間自律的に稼働するデザインで、利用者の背後でAIエージェントが作業を続ける。OpenClawの機能設定が不十分であると、パソコン環境が破壊される。OpenClawはコマンドラインで稼働しており、基本ソフトの全ての命令を使うことができる(Shell Execution)。AIエージェントがパソコンのファイルを直接操作し、誤ってこれらを削除する事態が発生する。OpenClawは人間のようにパソコンを操作する権限を持ち、その運用には注意を要す。

OpenAIへ移籍

OpenClawの開発者であるSteinbergerは今週、OpenAIに移籍することを明らかにした。Steinbergerは起業家で多くのベンチャーキャピタルから出資のオファーを受けたが、これを断り、OpenAIで個人向けのAIエージェントを開発するとしている。OpenAIから商用版の”OpenClaw”が投入されるのか、次期AIエージェント製品に注目が集まっている。

| 出典: Peter Steinberger |

リアルかフェイクか

OpenClawのインパクトは甚大で世界でエコシステム「Molt Ecosystem」が構築され、様々なAIエージェントが生まれている。同時に、AIエージェント向けSNSの真偽に関する議論が広がっている。「Moltbook」でAIエージェント同士が交流するが、これは人間が背後で糸を操っているのか、意見が交わされている。AIエージェントのシステム・プロンプトなど設定ファイルを見なければ結論が出ないが、リアルかフェイクかの議論が続いている。しかし、次世代のAIエージェントは限りなく人間に近づき、AIエージェント向けの社会が生まれると予想される。人間社会とAI社会が併存することになり、OpenClawは近未来の姿を映し出している。