Anthropicは最新モデル「Claude Opus 4」と「Claude Sonnet 4」を公開した。両者はコーディングのスキルが向上し、高度な推論機能を持ち、AIエージェントとしてソフトウェア開発を人間のように実行する。AIエンジニアリング機能が大きく進化し、他社を大きく引き離し業界トップの性能をマークした。一方、CEOであるDario Amodeiは、AIが急速に進化し、ホワイトカラーの仕事を置き換え、米国で失業者が急増すると警告した。新卒者のポジションの半数がAIで置き換えられ、雇用対策のために新たな制度の導入が必要との意見を明らかにした。

| 出典: Anthropic |

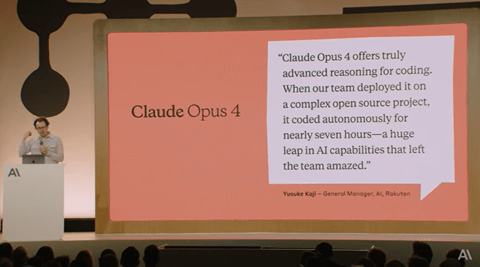

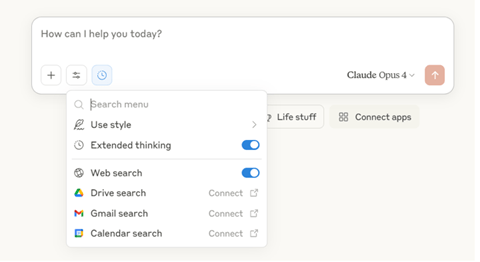

Anthropicは開発者会議「Code with Claude」で最新モデル「Claude Opus 4」と「Claude Sonnet 4」を公開した(上の写真)。Opus 4はハイエンドモデルで、コーディング技術で業界トップの性能を持ち、複雑なプログラムをAIエージェントとして実行する。Sonnet 4はミッドレンジモデルで、コーディング技術や推論機能が大きく強化された。両者はハイブリッドモデルで、通常モードの他に「Extended Thinking(拡張推論)」モードを提供する。後者は推論機能を拡張したもので、モデルは異なるロジックで考察を重ね、複雑な問題を解く能力を持つ。(下の写真、Claude Opus 4のインターフェイス、拡張推論機能を使うには「Extended Thinking」タグをオンにする)

| 出典: Anthropic |

ソフトウェアエンジニアリング機能

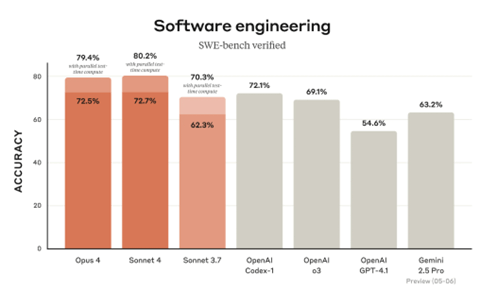

Anthropicはベンチマーク「SWE-Bench」の結果を公開し、Claude Opus 4とClaude Sonnet 4はソフトウェアエンジニアリングで他社を引き離しトップの性能をマークした(下のグラフ)。SWE-Benchとは、実社会の問題を解決する技量を判定するもので、コーディングだけでなくプログラムを理解し、問題を修正する能力が試される。具体的には、プログラムのシステム構造を把握し、ソフトウェアのバグを見つけ、これに修正を施し、その結果を確認するステップから構成される。Claude 4シリーズはOpenAIのコーディングモデル「Codex-1」の性能を上回った。

| 出典: Anthropic |

AIエージェントとして複雑なシステムを開発

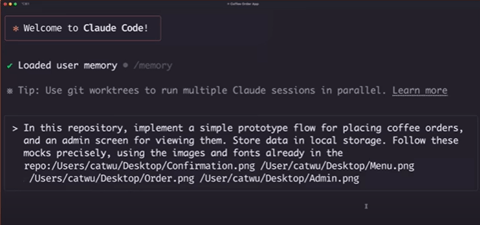

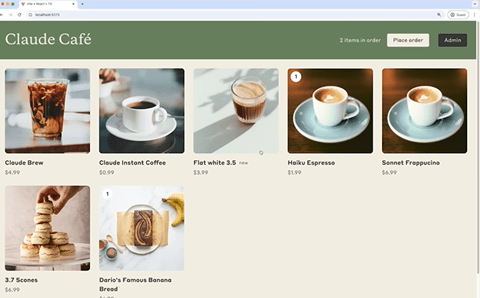

実際に、Claude Opus 4はコーディングだけでなく、複雑なシステムを開発することができる。Opus 4にEコマースサイトの開発で、人間が複数のステップを指示すると、モデルは指示された手順に沿ってプログラムを開発していく。Opus 4でコーヒーショップのウェブシステムの開発をする際に、1)注文のフローの生成、2)注文のフローを管理する画面、3)入力されたデータをストア、4)ウェブインターフェイスの開発、などと指示すると(下の写真上段)、Opus 4はこのスペック従ったプロトタイプを生成する(下の写真下段)。これらのプロセスはエンジニアが手作業で進めていたが、Opus 4がこの仕事を代行しシステム開発が自動化された。エンジニアの役割はコーディングなどの力仕事から、アーキテクチャの設計などハイレベルな職務に代わることになる。

| 出典: Anthropic |

CEOの警告メッセージ

この発表に続き、Anthropic CEOのDario Amodeiは、AIにより米国で失業者が増えると警告メッセージを発信し、米国社会でセンセーションを引き起こした。Amodeiは今後1年から5年の間に、米国の入門レベルのホワイトカラーの仕事の50%がAIに置き換わり、失業率が10%から20%に上昇するとの見解を示した。業種別では、ハイテク、金融、法律の分野で影響が甚大で、エントリーレベルのエンジニアがAIで置き換えられる。Claude 4シリーズの発表直後に失業問題を提起し、米国でAIによる失業問題に関する議論が再燃した。

| 出典: Dario Amodei |

失業対策

Amodeiは同時に、AIによる失業者を救済するための対策案を提示した。一つは、AI開発企業に新たな税を課すことで、この税収で失業者がリスキリングするためのプログラムを運用する。この新税は「Token Tax」と命名され、AI企業のAPI収入(モデル使用料金)に課税し、税率を3%に設定する。二つ目は、政府と民間企業が大規模なリスキリングプログラムを運営しAI時代の雇用対策を実行する。これは、第二次世界大戦後、米国は帰還兵士を再教育する政策「GI Bill」を制定し大きな成功を収めた。これを参考に、AI時代は官民が共同で労働者を再教育するプログラムを実行する。

AIセーフティを推進

Anthropicはホワイトカラーを置き換える高度なAIモデルをリリースし、同時に、AIによる失業問題を指摘しその対策案を提示した。Amodeiはあえて問題点を指摘した理由を、Anthropicのミッションは高度なAIを責任もって開発することにある、と述べている。また、トランプ政権はAIの規制緩和を進めるが、AnthropicはAIを安全に開発運用するためには、政府によるガードレールが必要であるとのポジションを取る。Anthropicが米国市場でAIセーフティをけん引する役割を担っている。