Alphabetの自動運転車開発会社Waymoは独自でLidar (レーザーセンサー) 技術の開発を進め、機能が大幅に向上したと発表した。また、WaymoはUberの子会社OttoがLidar技術を盗用したとして提訴した。自動運転車開発競争の中心はLidarで、Waymoの特許を参考に最新技術をレビューする。

| 出典: Waymo |

Automobili-Dカンファレンス

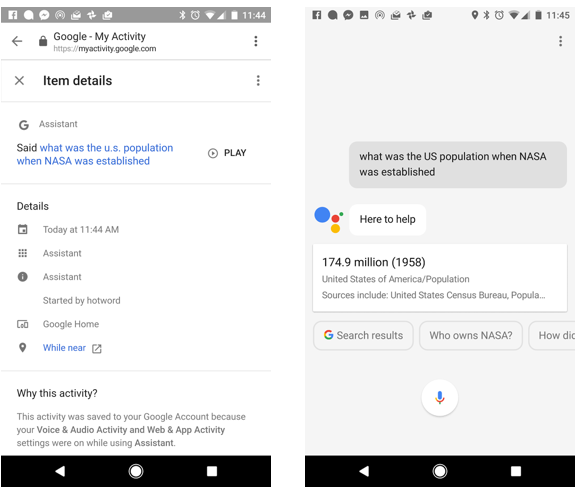

Waymo最高経営責任者John Krafcikは2017年1月、デトロイトで開催されたNAIAS Automobili-D カンファレンスで最新の自動運転技術を発表した。この模様はビデオで公開された。WaymoはChrysler Pacifica Hybridベースの自動運転車 (上の写真) を開発しているが、KrafcikはLidarなどのセンサーを中心に最新技術を説明した。

クライスラーと共同開発

WaymoとFiat Chrysler Automobilesは2016年5月、自動運転車を共同開発することで合意し、100台の自動運転ミニバン「Waymo Self-Driving Pacifica」を製造している。ミニバンはWaymoが開発したハードウェア (Hardware Suit) を搭載し、最高レベルの自動運転車として位置づけられる。

Lidarを自社開発する

初期のGoogle自動運転車は他社製センサーやプロセッサを利用していた。LidarはVelodyne社製のハイエンドモデル「HDL-64E」を採用した (下の写真、屋根の上の円筒状装置)。しかし、この製品は機能的な制約があり、価格は75,000ドルと高価で車両価格を上回った。このため、WaymoはLidarを含むセンサー群を自社で開発することとした。

GoogleのAIとWaymoのセンサーを統合

センサーは自動運転車の頭脳であるAIと密接に統合された。センサーを構成する各コンポーネントがAIにより制御され、単一のモジュールのように機能する。Googleがスマートフォン「Pixel」でAndroid OSだけでなくデバイスも自社開発しているように、Waymoもソフトウェアだけでなくハードウェアも開発する方針とした。Googleが得意とするAIとWaymoの高精度センサーが結びつき自動運転技術が一気に進化した。

| 出典: VentureClef |

センサーの種類と搭載位置

WaymoのセンサーはLidar、Vision System、Radarから構成される (下の写真)。ミニバンの屋根には小型ドームが搭載され、ここにLidar、Vision System、Radarが格納される。クルマの四隅にはRadarが設置される。別のタイプのLidarは前後と前方左右四か所に搭載される。

| 出典: Waymo |

Lidarがクルマの眼となる

センサー群の中で中心となるのがLidarだ。Lidarはレーザースキャナーでクルマ周囲のオブジェクトを3Dで把握する。つまり、Lidarは歩行者と人の写真を区別できる。更に、Lidarは静止しているオブジェクトを把握し、距離を精密に測定する。クルマは複雑な市街地を走行し、様々なオブジェクトを検知する必要がある。WaymoのLidarはブラインドスポットが無く、クルマ周囲の歩行者全員を検知できる。また、解像度が高く、歩行者がどちらを向いているかも判定できる。これにより歩行者の行動予測精度が大幅に向上した。

| 出典: Waymo |

Short Range Lidar

Waymoは三種類のLidarを搭載している。一つは「Short Range Lidar」でクルマの前後左右四か所に設置され、周囲のオブジェクトを認識する (上の写真、後部バンパーと右側前方の円筒状の装置)。クルマのすぐ近くにいる小さな子供などを把握する。解像度は高く、自転車に乗っている人のハンドシグナルを読み取ることができる。

Long Range Lidar

もう一つは「Long Range Lidar」 (上の写真、屋根の上のドームの内部に搭載) で遠方にあるオブジェクトにズームインすることができる。フットボール二面先のヘルメットを識別できる精度となる。これ以上の説明はないがWaymoが申請した特許 (下の写真、資料の一部) を読むとLong Range Lidarはユニークな構造となっている。

特許資料によるLong Range Lidarの構造

Long Range Lidarは通常のLidarと可変式のLidarの二つのモジュールから構成される。通常のLidarは固定式で設定された範囲をスキャンする。可変式のLidarはFOV (視野、レーザービームがスキャンする角度) を変えることができる。ズームレンズで特定部分をクローズアップするように、可変式Lidarは発光するレーザービームを狭い範囲に絞り込み、遠方の小さなオブジェクトも判定できるようにする。ただ、この特許が実際の製品にどのように実装されているかは、Waymoの説明を待つ必要がある。

| 出典: Waymo |

Vision Systemはカメラの集合体

Waymoは独自のVision Systemを開発した (一つ前の写真、屋根の上のドームに搭載される)。Vision Systemとはダイナミックレンジの広いカメラの集合体で、8つのVision Moduleから構成され、クルマの周囲360度をカバーする。信号機や道路標識を読むために使われる。Vision Moduleは複数の高精度センサーから成り、ロードコーンのような小さなオブジェクトを遠方から検知できる。

暗いところから明るいところまで見える

Vision Systemはダイナミックレンジが広く、暗いところから明るいところまでイメージを認識できる。暗がりの駐車場から直射日光を受けるまぶしい場面まで幅広く使える。通常のカメラは人間と同じように光の状態により見えにくい状態が発生する。Vision Systemはこの問題を解決するために開発され、太陽光が直接カメラに入る状態でもオブジェクトを把握できる。

Radarを大幅に改良

Waymoは20年にわたり技術進化がないRadarを大幅に改良した。通常のRadarは前方の狭い範囲をカバーするが、WaymoのRadarはクルマの周囲360度を連続してカバーする (一つ前の写真、前方側面と屋根後部のウイング状のデバイス)。雨や霧や雪の時に、Radarは他のセンサーを補完する。また、通常のRadarは車両の動きを把握するために使われるが、WaymoのRadarは車両以外に歩行者や自転車も検知する。移動速度が遅いオブジェクトについても高精度で検知できる。

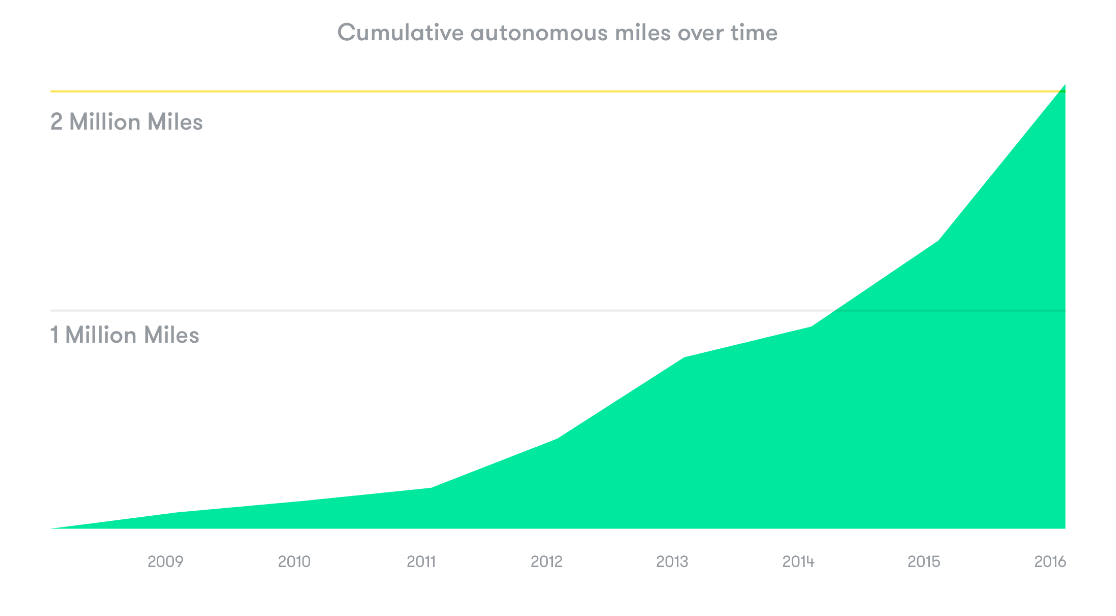

走行距離とVirtual Miles

Waymoの自動運転車は累積で250万マイル走行した。市街地を中心に走行試験を重ねており、今年5月には300万マイルに達する。路上試験に加えWaymoはシミュレータで走行試験を重ね、2016年だけで10億マイルを走行した。シミュレータでは様々な走行状態を再現できる。ここでクルマにとって難しい状態や稀にしか発生しない事態をシミュレータで生成する。シミュレータでの走行がソフトウェアの改良に寄与している。

安全性が格段に向上

自動運転車の性能はどれだけの距離をドライバーの関与なしに自動走行できたかで決まる。試験走行中にドライバーが自動モードを解除することをDisengageと呼ぶ。Disengageの回数が少ないほど安全性が高いという関係になり、1000マイル走行して何回Disengageが発生したかという指標で評価される。2015年は0.80回で2016年は0.20回と大幅に改善しており、安全性が順調に改善されているのが分かる。ただ、2016年の数字は5000マイルごとに問題が発生しているとも解釈でき、製品として出荷するには更なる改良が求められる。

Lidarの価格が劇的に下がる

WaymoはLidarのコストを大幅に下げることに成功したと発表した。前述Velodyne社製のLidarより90%安い価格で提供する。Velodyne製Lidarの価格が75,000ドルであるが、Waymo製Lidarの価格は7,500ドルと大幅に安くなる。これにより自動運転車開発でセンサーの選択肢が大きく変わる。Lidar価格が高いためカメラを代用している企業も少なくない。Lidarの価格破壊で自動運転技術方式が大きく変わる可能性もある。

WaymoがUberを提訴

Waymoは2017年2月、Ottoとその親会社であるUberに対して訴訟を起こした。Waymoは同社が開発したLidar技術をOttoが不正に入手したとしている。Uberは昨年、誕生して間もないOttoを6億8千万ドルで買収し、創設者であるAnthony Levandowskiを自動運転開発部門責任者に任命した。UberがOttoを買収した理由はLidar技術にあるといわれていた。LevandowskiはGoogle自動運転車開発のコアメンバーであった。Uberはこれに対しWaymoの訴訟は開発を遅らせるための手段であると述べ、全面的に対決する姿勢を見せている。自動運転車でカギを握る技術はLidarであり、訴訟の進展が市場形勢に大きな影響を及ぼす。