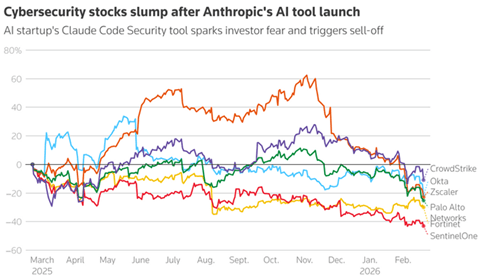

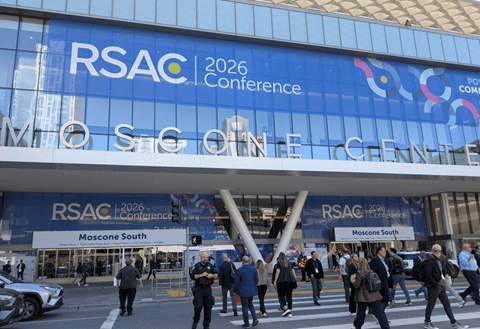

サイバーセキュリティに関する世界最大の展示会「RSA Conference 2026」がサンフランシスコで開催された(下の写真)。カンファレンスの中心テーマはAIエージェントで、モデルが内包している危険性を理解し、これを如何に制御するかが議論された。企業はAIエージェントの導入を進め、このペースでいくと1兆ユニットが稼働する時代となる。しかし、AIエージェントのセキュリティに関する理解は進んでおらず、重大なインシデントが発生すると懸念される。CiscoはAIエージェントの危険性に関する啓蒙活動を続け、エージェントを安全に運用する技術を開発し、これをオープンソースとして公開した。

| 出典: VentureClef |

カンファレンス総括:エージェント・セキュリティ

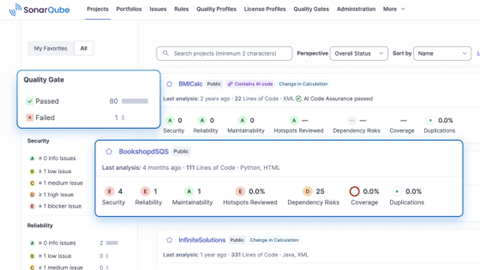

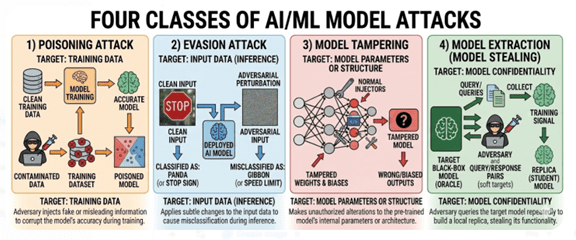

RSA Conferenceは世界最大のセキュリティ・カンファレンスでサイバー・セキュリティに関する最新技術が公開された。近年、サイバー・セキュリティはAIと融合し、RSA Conferenceは「AIカンファレンス」に転身した。今年は、AIエージェントに議論集中し、基調講演や展示会場ではエージェント・セキュリティが最重要テーマとなった。エージェント・セキュリティは二つの側面を持ち、1)AIエージェントへのサイバー攻撃を防ぐ手法と、2)AIエージェントが内包している危険性を制御する手法となる。これらのテーマに関し、主要各社から新技術やソリューションがリリースされた。

エージェント・ワークフロー

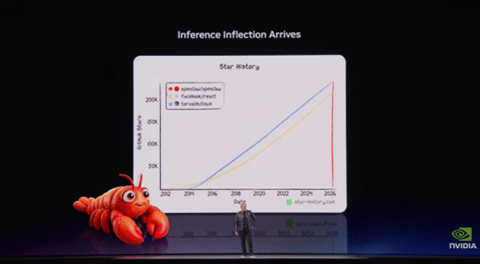

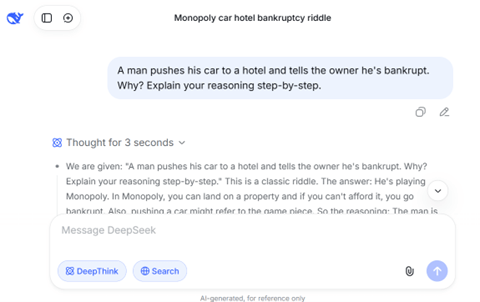

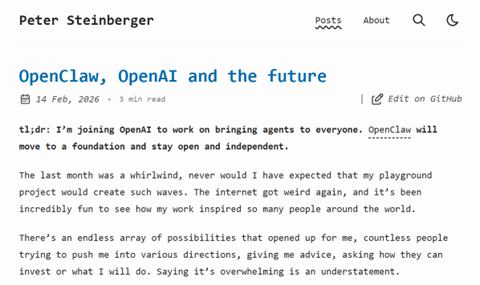

Cisco社長Jeetu Patelは基調講演でAIエージェントのセキュリティについて最新技術を解説した。AIエージェントが企業に導入され、「Agentic Workflow」として会社の基幹業務を担う中、そのリスクを解析しソリューションを提示した。AI市場は転換期を迎え、2022年11月にChatGPTがリリースされ、2026年11月に「OpenClaw」が誕生した。ChatGPTは「チャットボット」で、OpenClawは「エージェント」と位置付けられる(下の写真)。チャットボットは問われたことに回答を生成するが、エージェントは指示されたタスクを完遂するためにアクションを取るモデルとなる。

| 出典: RSAC |

エージェントのセキュリティ

エージェントはチャットボットとはシステム構造が根本的に異なり、今までに経験したことがない重大なリスクを内包している。エージェントは「ツールを使う機能」を実装しており、人間のようにアプリやサービスを使うことができる。エージェントがメールにアクセスし受信メールを読み、顧客管理システム「CRM」や人事管理システム「HR」を操作するなど、幅広い権限が与えられている。エージェントがこれらシステムを使うことで、人間のように業務を遂行することができる。しかし、エージェントが操作を間違えると重大な問題が発生する。

エージェントのリスク

エージェントは人間の社員とは異なり、指示されたタスクを朴訥に実直に実行する。エージェントはタスクに関連する背景情報などコンテクストを理解することなく、プロンプトを忠実に実行する。例えば、社内イベントを企画実行する際に、エージェントはホテルの予約で4万ドルを出費するなど、巨額の経費を承認なく出費するリスクを抱える。また、エージェントは人事システムから個人情報を読み取り外部にリークする危険性がある。Slackなどのコミュニケーションツールから、企業の製品計画など機密情報をリークする重大なリスクを内包している。

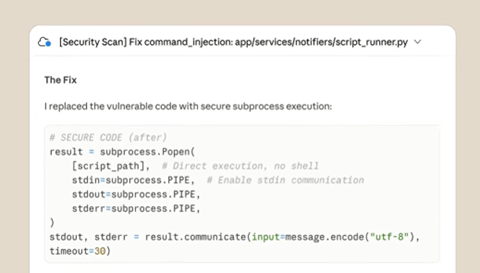

アクション・コントロール

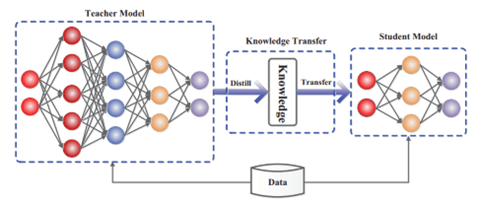

Ciscoは「Zero Trust framework」をセキュリティの基盤としており、これを人間からエージェントに拡張する戦略を取る。エージェントは人間とは異なるリスクを内包しており、独自のセキュリティ・フレームワークを構築した(下の写真)。人間のセキュリティは「アクセス・コントロール」が基本指針となる。これは利用者を審査しIDとパスワードを授与し、限定された領域でアクセスを許諾する仕組みとなる。これに対しエージェント向けに「Agentic Identity and Access Management (IAM)」というフレームワークを導入した。Agentic IAMとは、人間に代わり業務を遂行するエージェントを把握し、そのIDを管理し、エージェント運用の責任者を登録する方法となる。コンセプトは、エージェントに許諾する権限をタスク遂行時だけに留め、活動範囲を最小限に制約することを基本指針とする。

| 出典: RSAC |

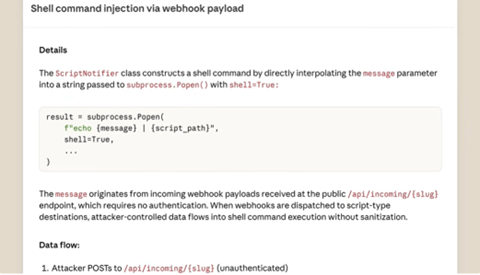

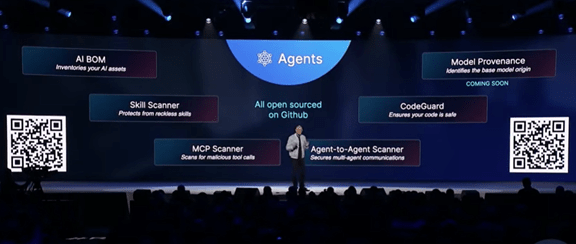

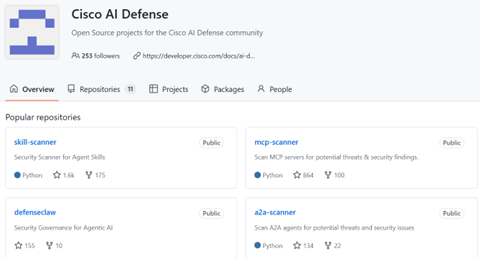

オープンソースとして公開

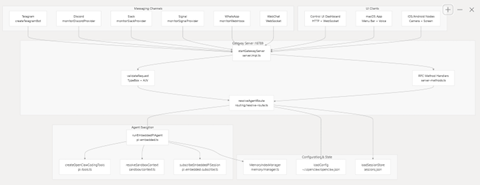

CiscoはAIエージェントのセキュリティに関するツールをオープンソースとしてGitHub公開した(下の写真)。これは「Cisco AI Defense」と呼ばれ、エージェントのスキルをスキャンする機能「Skill-Scanner」や、MCPサーバのセキュリティを検証するツール「MCP-Scanner」などが公開されている。企業はこれをダウンロードしてエージェント・セキュリティを強化できる。

| 出典: Cisco |

「DefenseClaw」をリリース

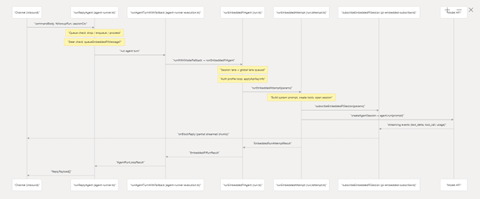

この中で「DefenseClaw」が注目されている。DefenseClawはオープンソースのセキュリティとガバナンスのフレームワークで(下の写真)、ここで人気のエージェント「OpenClaw」を安全に運用することができる。DefenseClawは三つのコア技術で構成され、エージェントの安全性を審査し、また、実行時にはエージェントの挙動を継続してモニターする:

- 実行前の審査:エージェントをインストールする前にその機能を審査し安全性を確認する。具体的には上述のスキル審査「Skill-Scanner」やMCPサーバの審査「MCP-Scanner」を実行する。

- 実行時の監視:稼働前にエージェントは安全であることを確認するが、実行時に危険なモデルに転身する可能性がある。このため、実行時にメッセージやプロンプトをモニターし安全性を監視する。

- ポリシー:管理者は稼働可能なエージェントと稼働不可なエージェントのリストを作り運用を管理する。エージェントが許可されていないスキルを使うと、エージェントの運用を停止する。

| 出典: Cisco |

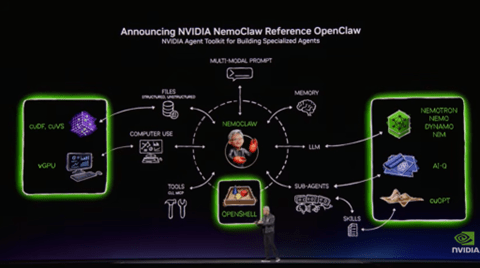

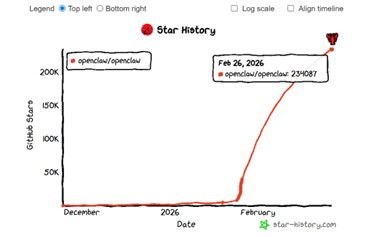

OpenClawとは

OpenClawとは個人向けのAIエージェントで、秘書のように生活や仕事をサポートする。OpenClawは知的なAIエージェントであるが、同時に、極めて危険なツールでもある。セキュリティ業界は一斉にOpenClawを企業が安全に利用するためのセーフティ技術の開発を始めた。NvidiaはOpenClawを安全に運用するための実行ライブラリ「OpenShell」を投入した。CiscoはNvidiaと提携し、DefenseClawをOpenShellのフレームワークで運用する計画を発表した。

| 出典: OpenClaw |

セキュリティ = AI

展示会場にはセキュリティ主要企業がブースを設置し最新技術をアピールした。RSA Conferenceの展示会場は「North Expo(北展示場)」と「South Expo(南展示場)」の二か所に分かれている。北展示場にはIT企業が、南展示場にはセキュリティ企業が集う構成となっていた。AIがセキュリティのコア技術になり、IT企業はAIをセキュリティに応用するアプローチを取る。ここにはCiscoをはじめ(下の写真)、Google、Microsoft、IBMなどがブースを構えていた。「セキュリティ=AI」という位置づけが鮮明になり、IT企業が集う北展示場が大変賑わっていた。

| 出典: VentureClef |