DeepSeekは最新モデル「DeepSeek-V4」をリリースし、これをオープンソースとして公開した。DeepSeek-V4の性能は米国フロンティアモデルに迫るものの、想定された範囲でサプライズは無かった。しかし、DeepSeek-V4はNvidia GPUではなく、中国製チップ「Huawei Ascend」で開発され、技術独立戦略が着実に進行していることが明らかになった。ソフトウェアではアグレッシブな手法でモデルの効率性を極限まで探求した。コストパフォーマンスで米国モデルを格段に上回り、オープンソースの普及モデルとして、AI市場を席巻する勢いとなった。

| 出典: DeepSeek |

DeepSeek-V4の概要

DeepSeek-V4はオープンソースのフロンティアモデルで米国モデルに迫る高度な性能を持つ。最大の特徴はコンテクスト・ウィンドウ(入力データの容量)が100万トークンとなり、大量のデータを処理できるモデルとなった。モデルは「Mixture of Experts(MoE)」というアーキテクチャを踏襲し、ハイエンドモデル「DeepSeek-V4-Pro」と軽量モデル「DeepSeek-V4-Flash」から構成される(下のテーブル)。DeepSeek-V4-Proのパラメータ数は1.6兆で、規模の面からも米国モデルに匹敵する。

| 出典: DeepSeek |

ベンチマークテスト

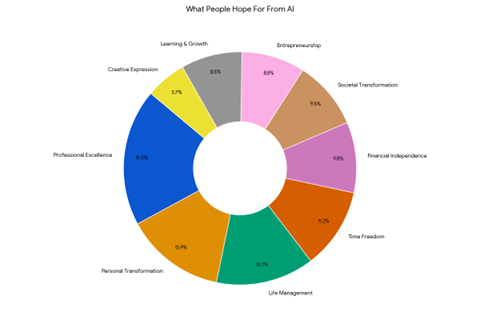

DeepSeek-V4の性能がOpenAIやAnthropicやGoogleなど米国モデルに肉薄した(下のグラフ)。ベンチマークテスト性能は米国モデルに迫り、平均するとDeepSeek-V4の性能は米国トップモデルから13%劣る位置付けとなる。ただ、注目すべき点は「SWE Verified」で、コーディング・エージェント性能では米国モデルを完全にキャッチアップした。DeepSeek-V4はAIエージェントのエンジンとして設計されている。

| 出典: DeepSeek |

中国製AIプロセッサ

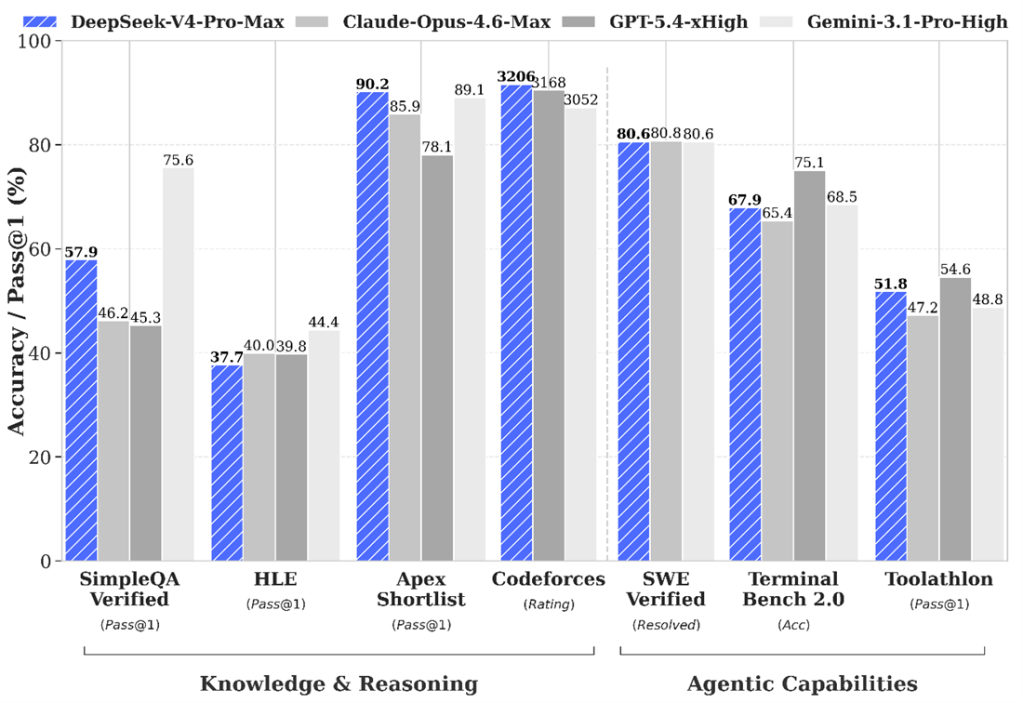

DeepSeekはAIプロセッサとしてNvidia GPUとHuawei Ascend NPUを使い、モデルの検証試験を実行した。同時に、HuaweiはDeepSeek-V4はAIプロセッサ「Huawei Ascend 950」シリーズで開発されたと公表した(下の写真)。Ascend 950はインファレンス・プロセッサ「Ascend 950PR」とトレーニング・プロセッサ「Ascend 950DT」から構成される。DeepSeek-V4の実行ではAscend 950PRが使われ、教育プロセスの一部でAscend 950DTが使われた。中国企業はNvidia GPUへの依存の度合いを下げ、国産プロセッサでAIモデルを開発する流れを加速している。

| 出典: Huawei |

アルゴリズムの改良

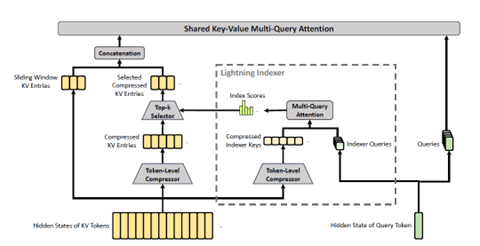

DeepSeekはDeepSeek-V4のアーキテクチャやアルゴリズムの改良を極限まで探求し効率的なモデルを構築した。これにより、限られたAIプロセッサで高度な性能を発揮し、メモリの使用量を大幅に削減し、効率的なモデルを生み出した。アルゴリズムの改良では「Compressed Sparse Attention (CSA)」という方式を取る。CSAはトランスフォーマのアテンションのメカニズムを改良し、KVキャッシュの容量を劇的に縮小し、大規模データ(1Mのコンテキスト・ウィンドウ)の計算を効率化した。(下の写真、CSAのメカニズム、過去のデータ全てを参照するのではなく、これを圧縮し、必要な部分だけを参照する。一方、直近のデータは圧縮することなく、そのまま参照する)。

| 出典: DeepSeek |

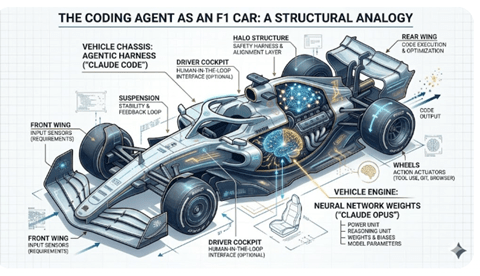

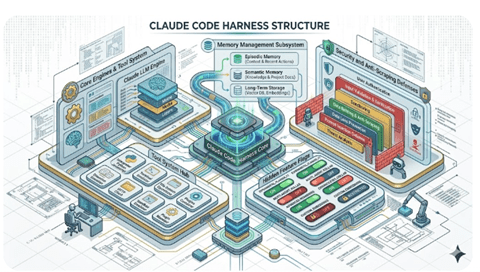

AIエージェント

DeepSeek-V4はAIエージェント向けのAIモデルとして開発され、自律的にタスクを実行する機能に特徴がある。DeepSeek-V4はAIエージェント・フレームワークと連携してシステムを構成する。AIエージェント・フレームワークとしては、Claude CodeやOpenClawなどがその代表で、ここに組み込まれAIエージェントのブレインとなる。(下の写真、スーパーマーケットのキャンペーンの企画をAIエージェントで実行した結果)

| 出典: DeepSeek |

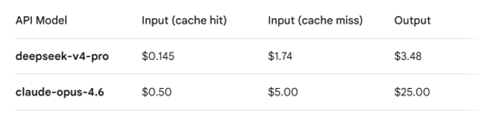

激安価格

DeepSeek-V4は効率を探求したモデルで、DeepSeekはこれを低価格で提供している(下のテーブル、上段)。米国のフロンティアモデル(Claude Opus 4.6)と比べると(下段)、API利用価格は29%から14%で、同じレベルの性能を激安価格で利用できる。DeepSeekは米国フロンティアモデルに匹敵する性能を超低価格で提供し、世界のAI市場でシェアを拡大する戦略を取る。

| 出典: Generated with Google Gemini 3.1 Pro |

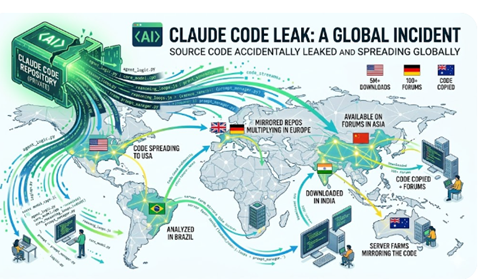

AIエージェントのエンジン

DeepSeekやAlibaba QwenはAIエージェントのエンジンとして人気がある。Claude CodeなどAIエージェントのエンジンにClaudeを使うと利用料金が極めて高い。このため、多くのユーザは中国モデルのDeepSeekやQwenをエンジンとして使っている。性能は米国モデルに及ばないが、そこそこの性能を割安価格で利用できるため、水面下で急速に普及している。米国や同盟国のシステムにDeepSeekなどのオープンソースが徐々に浸透しており、安全保障の側面から新たな問題を提起している。