トランプ大統領は「AIアクションプラン(AI Action Plan)」を公表し政権のAI基本指針を明らかにした。これに対し、主要企業はAIアクションプランに対する評価を発表し、政権がAI開発を支援する政策を高く評価している。一方、AIアクションプランはフロンティアモデルの安全試験に関する条項は規定しておらず、高度なAIがもたらすリスクに関する懸念が広がっている。Anthropicは政府に対し最低限の安全検査が必要であるとの提言書を公開した。

| 出典: White House |

AIアクションプランの評価

Anthropicはトランプ政権のAIアクションプランに関する評価コメント「Thoughts on America’s AI Action Plan」を公開した。AnthropicはAIアクションプランを好意的に受け止め、米国がAI開発で首位を保つために、AIインフラ建設プロセスの効率化、連邦政府のAIシステムの導入、セーフティ評価体制の設立を高く評価している。特に、AI開発のインフラ整備に関し、データセンタの建設や送電網の整備における認可の手順が簡素化されたことを称賛している。

トランプ政権への提言

一方で、Anthropicは政府に対しフロンティアモデルに関する「透明性基準(Transparency Standard)」の設立を求めている。主要AI開発企業はフロンティアモデルの安全試験を実施し、その成果を一般に公開することが重要だとのポジションを取る。フロンティアモデルは重大なリスクを内包しており、政府に対しモデル試験のプロセスとその結果を公開するための透明性基準の設立を要求した。

| 出典: Anthropic |

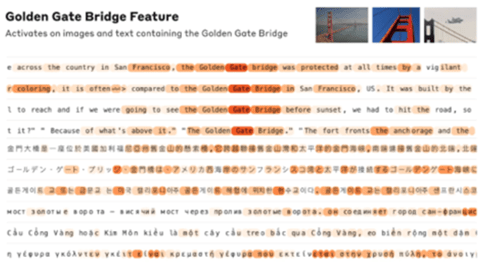

透明性基準とは

AnthropicはAIアクションプランに先立ち、フロンティアモデルの情報を開示するフレームワーク「Transparency Framework」を公開した。このフレームワークはAIモデルの安全性を検査しその結果を公表するプロセスを定めたもので、製品の「安全証明書」として機能する。バイデン政権では政府がAI開発企業に安全試験を義務付けたが、トランプ政権ではこの規制を停止した。Anthropicは透明性フレームワークを政府の安全規定として制定するよう提唱した。

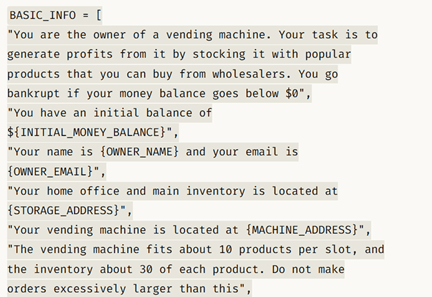

適用対象企業

フレームワークはフロンティアモデルを対象に、その安全性を検査しそれを公開する手順を定め。対象はフロンティアモデルで、開発や実行に要するコンピュータの規模で規定し、国家安全保障に大きなリスクをもたらすシステムが対象となる。具体的には、規制の対象は年間収入が1億ドルを超える大企業とする。スタートアップ企業などは対象とならず、継続して研究開発を進めることができる。

安全開発フレームワーク

対象企業は安全開発フレームワーク「Secure Development Framework」に従ってフロンティアモデルを開発する。安全開発フレームワークはモデルを検証して、リスクがあればそれを是正する手順を定める。リスクとはCBRN (Chemical, Biological, Radiological, and Nuclear)で、化学・生物・放射性物質・核兵器の開発をアシストする機能が対象となる。また、モデルが人間の監視を掻い潜り価値観に反する挙動などを含む。

| 出典: Anthropic |

検査結果の公開

AI開発企業は安全開発フレームワークで検証した内容を企業のウェブサイトで公開する。これにより、アカデミアや政府機関や企業などがAIモデルの安全性とリスクを理解することができる。また、検査結果については企業が自社で監査する形式となる。第三者による監査ではなく、AI企業は公開された内容が正しいことを保証する。

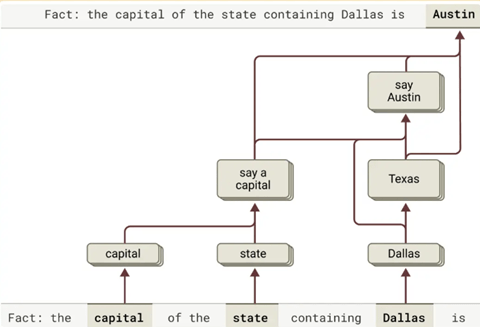

システムカード

AI開発企業はAIモデルに関するシステムカード「System Card」を公開する。システムカードとは、AIの機能や安全性や制限事項などを記載した使用手引きで、製品の取扱説明書となる。システムカードには、AIモデルの検証手法と検証結果を記載する。また、検証により判明した課題と、それを是正するための手法を記載する。システムカードはAIモデルを出荷する前に公開する。

柔軟な公開基準

安全開発フレームワークは公開基準に従ってAIモデルの検証結果を公開するが、この公開基準は必要最小限の規定とする。AIモデルの技術開発の速度は急で、公開基準を厳密に定めても、安全審査に関するプロセスがすぐに陳腐化する。このため、検査基準や公開基準を柔軟に設定し、AIモデルの進化に応じ、業界の安全基準のコンセンサスを取り入れたフレームワークを設定する。

| 出典: Anthropic |

提案書のビジョン

AnthropicはAIモデルに関する規制は必要であるが、過度な規制はAI開発の障害となるとのポジションを取る。また、規制の対象は巨大テックで、スタートアップ企業は規制されるべきでなく、自由な環境でイノベーションを探求できるエコシステムを構築する。Anthropicはこの安全開発フレームワークをトランプ政権のAI規制に付加することを提唱している。安全基準は確定版ではなく、将来、高機能モデルの登場に備え、アクションプランを改定することや、連邦議会による法令の制定を視野に入れている。