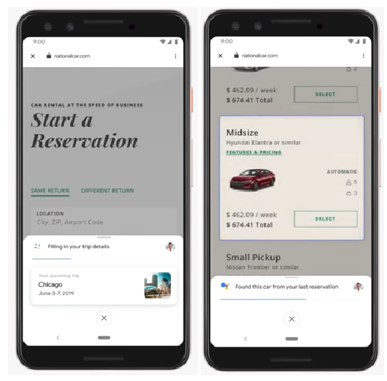

Googleは2019年5月、企業向けスマートグラス最新モデル「Glass Enterprise Edition 2 (Glass EE2)」(下の写真) を発表した。Glass EE2はプロセッサが強化され、AI(コンピュータビジョンと機械学習)が組み込まれた。AR・VRカンファレンス「Augmented World Expo」でGlass EE2とそのアプリが紹介された。実際に使ってみると、Glass EE2は操作に対しレスポンスが速く、アプリがサクサク動き、性能アップを肌で感じた。

| 出典: VentureClef |

スマートグラス開発経緯

Googleのスマートグラスは開発方針が二転三転したが、企業向け製品とすることで方向が定まった。Googleは、2013年、スマートグラスのプロトタイプ「Glass Explorer」を投入し、次世代のウェアラブルの姿を示した。センセーショナルにデビューし市場の注目を集めたが、カメラによるプライバシー問題から、2015年、GoogleはGlassの販売を中止した。

企業向けスマートグラスに方針変更

Glass Explorerは消費者向け製品として位置付けられたが、Googleはそれを企業向けスマートグラスに仕立て直し、秘密裏に開発を続けていた。Googleは2017年、企業向けスマートグラスとして「Glass Enterprise Edition」を発表した。AR機能を使った業務用スマートグラスが登場し、製造、運輸、医療分野でトライアルが始まった。

Glass Enterprise Edition 2の概要

市場の反応は良好で、Googleは2019年5月、企業向け最新モデル「Glass Enterprise Edition 2」をリリースした(下の写真)。このモデルはプロトタイプの段階を卒業し、Googleの製品として位置付けられている。Glass EE2はプロセッサに「Qualcomm Snapdragon XR1」を採用し、演算性能が大幅に向上した。カメラ性能も強化され、インターフェイスとしてUSB-Cがサポートされた。更に、バッテリー容量が増え、一回の充電で使える時間が大幅に伸びた。(Glass EE2の形状は先頭の写真の通り、下の写真はこれにSmith Optics社製のフレームを装着したもの。)

| 出典: Google |

プロセッサ

Glass EE2が搭載しているQualcomm Snapdragon XR1はARとVRのヘッドセット向けに開発されたプロセッサで複数の演算機構から構成される。プロセッサはCPU(Kryo)、GPU (Adreno)、DSP(Hexagon Vector Processor)から成り、イメージ処理だけでなく、これらがAIエンジンとして機能しニューラルネットを高速で処理する。これにより画像認識(Object Classification)、ポーズ認識(Pose Prediction)、音声認識(Language Understanding)機能が大幅に向上した。

Glass EE2は「Android Oreo」を搭載し、基本ソフトが一新され、システム開発が容易になった。例えば、ライブラリやAPIを使いGlass EE2を既存システムと連携できる。また、デバイス管理機能「Android Enterprise Mobile Device Management」をサポートしており、利用企業は多数のGlass EE2を一括管理でき、業務での展開が容易になる。

パートナー企業経由で販売

Glass EE2はGoogleではなく、パートナー企業が販売する形態を取る。パートナー企業はスマートグラス向けに業務アプリを開発し、デバイスとともに販売する。既に多くのアプリが提供されており、主要企業で使われている。Glass EE2の価格は999ドルで2019年5月から販売が始まった。

製造業向けソリューション

既に、Glass EE2向けに業務ソリューションが登場している。UpskillはVienna(バージニア州)に拠点を置くベンチャー企業で、スマートグラス向けの製造ソリューションを開発している。これは「Skylight」と呼ばれ、ARを部品組み立てのプロセスに適用する。Boeingで採用され、航空機のワイアリング手順をスマートグラスに表示する(下の写真、右上のウインドウ)。作業者は視線を移すことなく、この手順(ワイヤを接続するスロットを表示)に従って作業を続けることができ、作業効率が大きく向上したと報告している。

| 出典: Upskill |

アプリのデモを体験

シリコンバレーで開催されたカンファレンス「Augmented World Expo」でUpskillはスマートグラス向けのアプリSkylightを出展し、AR製造ソリューションの利便性をアピールした。(下の写真、右側)。実際にこのアプリをGlass EE2で使ってみた。このアプリは機器製造で配線手順をARで表示するもので、操作手順に沿って作業をしてみた。Glass EE2のディスプレイにケーブル番号とスロット番号が示され、これに従って配線した(下の写真、左側、デモシステムと使用したGlass EE2)。操作マニュアルに視線を移す必要はなく、ハンズフリーで作業ができ、これは確かに便利なソリューションだと感じた。

| 出典: VentureClef |

Glass EE2の進化

Glass EE2を操作するとGlass Explorerから大きく進化しているのを感じた。Glass EE2はディスプレイの輝度と解像度が増し、文字や図形が鮮明に表示される。Glass EE2にタッチすると、アプリは機敏に反応し、操作が軽く感じる。Upskillによると、BoeingはGlass EE2が軽量で一回の充電で長時間使える点を評価しているとのこと。Glass EE2はもはやプロトタイプではなく、企業で使えるレベルまで完成度が向上した。

AI+ARアプリが登場か

Glass EE2はAIアプリをデバイス上で稼働させることができる構造となっている。このため、AIを活用した高度な業務ソリューションを開発できる。AIとARを組み合わせると、どんなアプリとなるのかが気になる。Glass EE2向けにオブジェクト認識機能や音声認識機能を組み込んだアプリが候補となる。再び、スマートグラス市場が動き出し、今度はAIと組み合わせた形でイノベーションが起こりそうだ。