Nvidiaは2021年4月、開発者会議「GPU Technology Conference(GTC)」で、プロセッサとAIの最新技術を公開した。CEOのJensen Huangは基調講演で自動運転車向けのプロセッサと開発環境を解説した。Googleなどは独自技術で自動運転車を開発するが、Nvidiaはプロセッサやリファレンスモデルを提供し、一般企業がこれを使い短期間で自動運転車を開発する。パソコンがIntel x86で組み立てられるように、自動運転車はNvidiaの標準プロセッサで開発される。

| 出典: Nvidia |

Ndiviaの自動運転技術

Nvidiaは世界最高速の車載AIプロセッサ「Atlan」を発表した。また、自動運転車のリファレンスモデル「Hyperion」を公開し、企業はこのテンプレートを使って自動運転車を開発する。更に、高精度のシミュレータ「Drive Sim」を発表した。これはデジタルツインを生成する技術「Omniverse」で構成され、現実社会に忠実な仮想社会が生成され、ここで自動運転車の試験や検証を実行する。

AIプロセッサ:Atlan

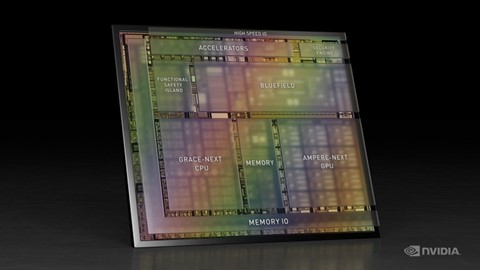

Nvidiaは自動運転車向けの車載AIプロセッサを開発してきたが、その第四世代となる「Atlan」を発表した(下の写真)。Atlanは世界最高速の車載AIプロセッサで、Nvidiaはこれを「クルマに搭載されたデータセンター」と呼んでいる。Atlanは三つのモジュールで構成され、AI演算を司るGPU「Ampere」、汎用プロセッサCPU「Grace」、データ処理プロセッサDPU「BlueField」から成る。GraceとはNvidiaが開発したCPUで、ARMベースのアーキテクチャとなる。また、BlueFieldは、セキュリティ機構や通信処理機能を備えた専用プロセッサで、車載プロセッサに組み込むのは今回が初となる。

| 出典: Nvidia |

AIアルゴリズムを高速で処理

Atlanは自動運転AIを実行するプロセッサで、クルマに搭載されたカメラやLidarのデータを解析し、進行経路を算出する。また、Atlanはクルマと運転者のインターフェイスとなるAIを実行する。クルマは搭乗者と音声で会話し、また、運転者の身体状況をモニターする。Atlanの性能は1,000 TOPS(毎秒1,000兆回の演算)能力を持ち、現行モデル「Orin」の4倍の性能となる。Orinは2022年から生産が開始され、Atlanは2023年からサンプリングが始まり、2025年のモデルに搭載される。

VolvoはOrinで自動運転車開発

GTCでVolvoはNvidiaと自動運転車の共同開発を進め、Orinを搭載した自動運転車を2022年に出荷することを明らかにした。Volvoの高級SUV「XC90」にOrinが搭載され、レベル4の自動運転車となる(下の写真)。Volvoの次世代車両は自動運転に対応したアーキテクチャとなり、必要なハードウェアを実装し、ソフトウェアのアップデートで自動運転車となる。また、クルマは位置情報と気象情報を把握し、自動運転できる条件を自動で判断する。自動運転技術はVolvoの子会社Zenseactで開発され、Volvoはインテリジェントなモビリティ企業に変身している。

| 出典: Volvo / Nvidia |

自動運転リファレンスモデル:Hyperion

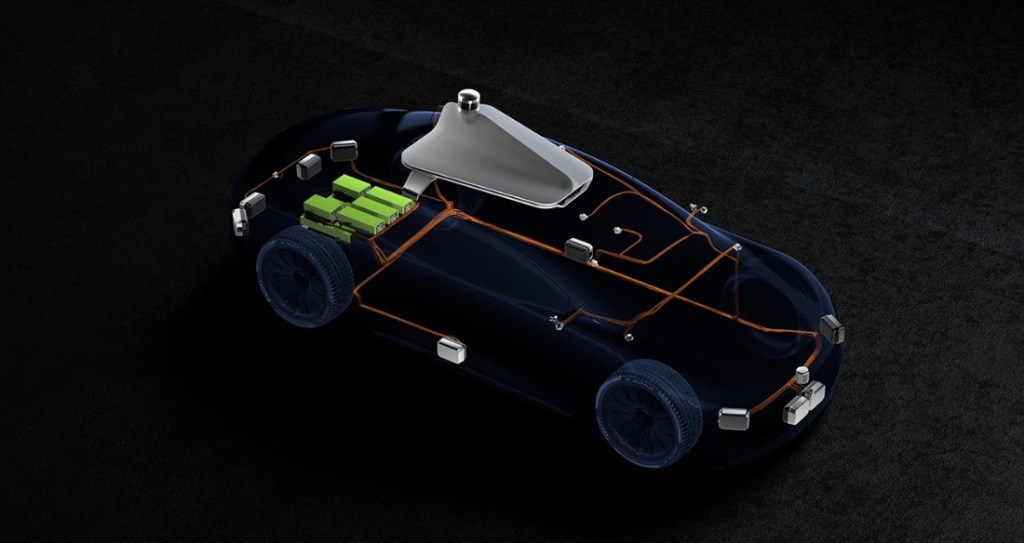

Nvidiaは自動運転車のリファレンスモデル「Hyperion」の最新版を発表した(下の写真)。これは自動運転車の開発キットで、ハードウェアとソフトウェアで構成される。企業や大学はこのモデルを使って短時間で自動運転車を開発できる。ハードウェアは、プロセッサとしてOrin(2セット)、センサーはカメラ(外部搭載が12台で車内搭載が3台)、レーダー(9台)、Lidar(2台)で構成される。ソフトウェアは評価ツールで、Nvidiaの自動運転ソフトウェアを使って開発したシステムをここで検証する。

| 出典: Nvidia |

自動運転ソフトウェア

Nvidiaは自動運転ソフトウェアをオープンソースとして公開しており、これを利用して自動運転車を開発する。これは「Drive Software」と呼ばれ、基本ソフトウェア「Drive OS」、開発環境「DriveWorks」、自動運転機能「Drive AV」、運転者監視機能「Drive IX」から構成される。これらのソフトウェアをHyperionと組み合わせレベル4の自動運転車を短期間で開発できる。実際に、バージニア工科大学はHyperionで自動運転車を開発し、自動運転技術の研究で活用している。

自動運転シミュレータ:Drive Sim

Nvidiaは自動運転車ソフトウェアを開発するシミュレータを発表した。これは「Drive Sim」と呼ばれ、実社会を忠実に再現した高精度なシミュレータとなっている。シミュレータで自動運転AIのコア技術であるコンピュータビジョンのアルゴリズムを教育する。また、完成した自動運転ソフトウェアを試験する環境として使う。(下の写真、シミュレータが描写するシーンであるが、現実社会と見分けがつかないだけでなく、物理現象が正確に再現されている。)

| 出典: Nvidia |

デジタルツイン開発技術:Omniverse

シミュレータはデジタルツインを生成する技術基盤「Omniverse」をベースに開発された。シミュレータはクルマに搭載されたセンサーが収集するデータを忠実に再現することが求められる。また、クルマは異なる環境で走行し、外部の光の状態を正確に描き出すことが必須要件となる。従来はゲームエンジンで生成されていたが、上記の要件を満たすためOmniverseが開発された。これにより、シミュレータは物理現象を正確に反映し、アルゴリズムの教育や検証で効果をあげることが期待される。

自動運転プロセッサの国際標準

Nvidiaの自動運転プロセッサはVolvoの他に、GM CruiseやAmazon Zooxなど先進企業が採用している。また、NvidiaはMercedes-Benzとソフトウェアで定義されたクルマ「Software-Defined-Vehicles」を開発している。Mercedes-BenzにOrinを搭載し、レベル4の自動運転車として製品化する(先頭の写真)。多くの自動運転車ベンダーがOrinの採用を始め、Nvidiaはクルマの国際標準プロセッサとなる勢いをみせている。